2026-03-12

AI 早报 2026-03-12

概览

要闻

模型发布

- OpenRouter 上线两款 Stealth 模型 ↗

#3 - 龙猫在API中上线 LongCat-Flash-Omni,免费可用 ↗

#4 - MiroMind 发布 MiroThinker 系列 Agent,含开源模型与定制版 ↗

#5 - Reka 发布 70 亿参数 Reka Edge 模型并开源 ↗

#6

开发生态

- Antigravity 调整 AI 订阅计划权益,额度或将下调 ↗

#7 - 智谱宣布本月向 Lite 用户开放 GLM-5,首批需申请 ↗

#8 - Codex 重置速率限制但限额显示异常 ↗

#9 - Google 发布 Gemini CLI 周更,集成计划模式 ↗

#10 - Cursor 新增超 30 款插件,集成 Hugging Face 官方功能 ↗

#11 - Cloudflare 上线爬虫端点 ↗

#12

产品应用

- Claude for Excel 与 PowerPoint 插件新增支持跨应用上下文同步及 Skills ↗

#13 - 各种厂商推出龙虾系列产品,网信办提示风险 ↗

#14 - Perplexity 推出 Personal Computer ↗

#15 - 谷歌将 Gemini in Chrome 扩展至印度等国 ↗

#16 - 腾讯玄武实验室发布端侧隐私工具 HaS ↗

#17

技术与洞察

行业动态

- Anthropic 成立研究所应对 AI 挑战,设华盛顿办事处 ↗

#20 - Meta 披露 MTIA 芯片路线图,两年迭代四代 2027 年部署 ↗

#21 - NVIDIA 注资 20 亿美元携手 Nebius 部署 5 吉瓦 AI 系统 ↗

#22 - Replit 完成 4 亿美元融资,估值 90 亿美元,发布 Agent 4 ↗

#23

前瞻与传闻

- 消息称 OpenAI 拟将 Sora 功能集成至 ChatGPT ↗

#24

英伟达发布并开源混合架构大模型 Nemotron 3 Super #1

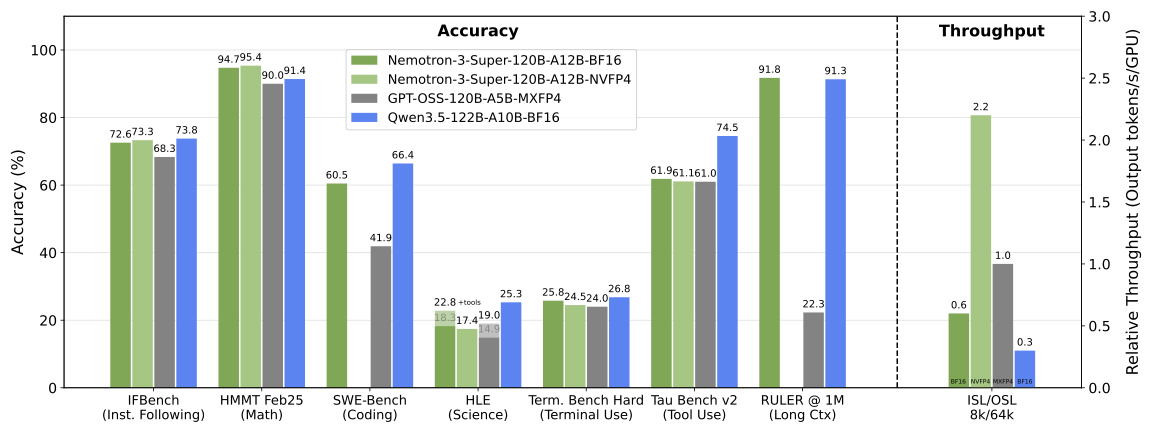

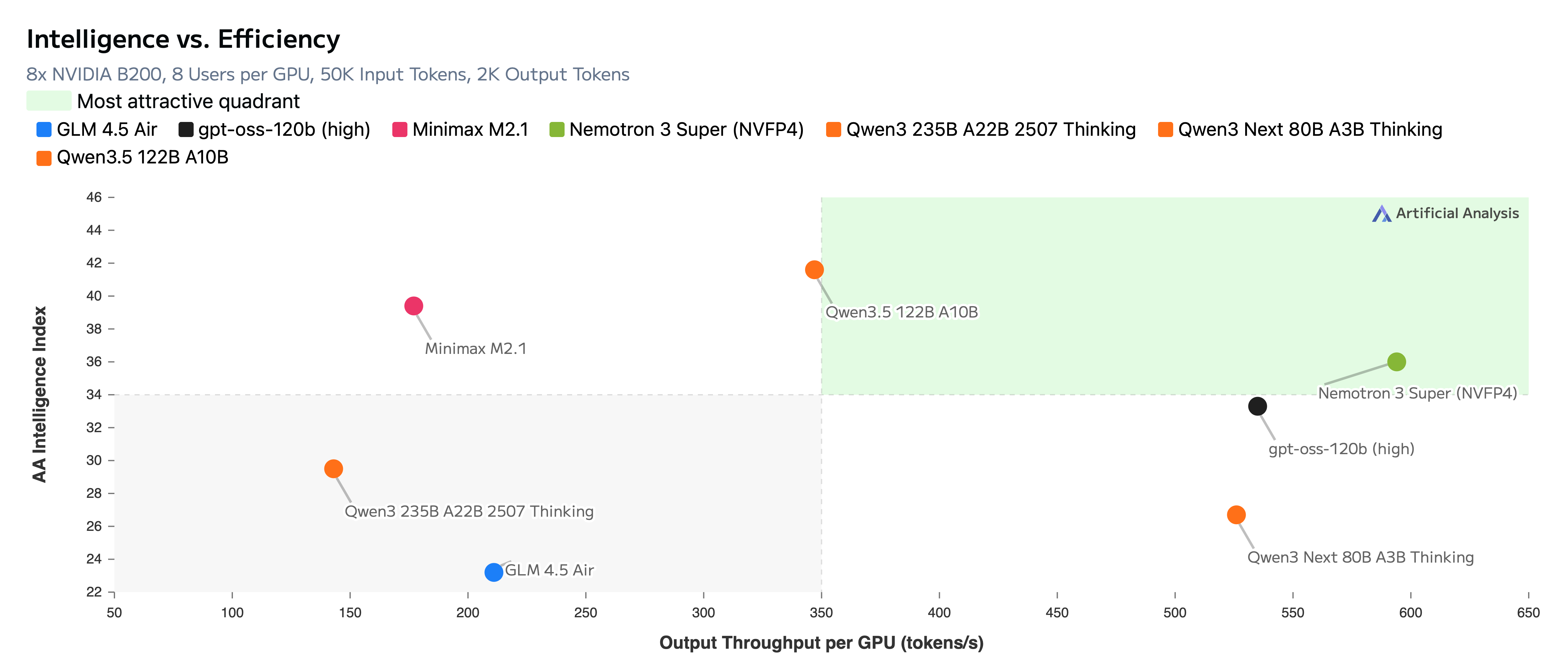

NVIDIA发布了Nemotron 3 Super开源模型,拥有1200亿总参数及100万token上下文窗口,专为解决Agentic AI的高昂推理成本而设计。该模型凭借混合架构实现了5倍吞吐量提升,并已在Hugging Face等平台全面开放权重、数据集及训练配方。

NVIDIA近日发布 Nemotron 3 Super 开源大模型,该模型拥有 1200亿 总参数和 120亿 激活参数。其采用结合 Mamba-2 与 MoE 的 LatentMoE 架构,支持高达 100万 token 的上下文窗口。

官方数据显示,与前代相比,其吞吐量提升 5倍,精度提升 2倍。作为该系列首个利用 NVFP4 精度预训练的模型,其在 Blackwell 平台上实现了显著效率提升。

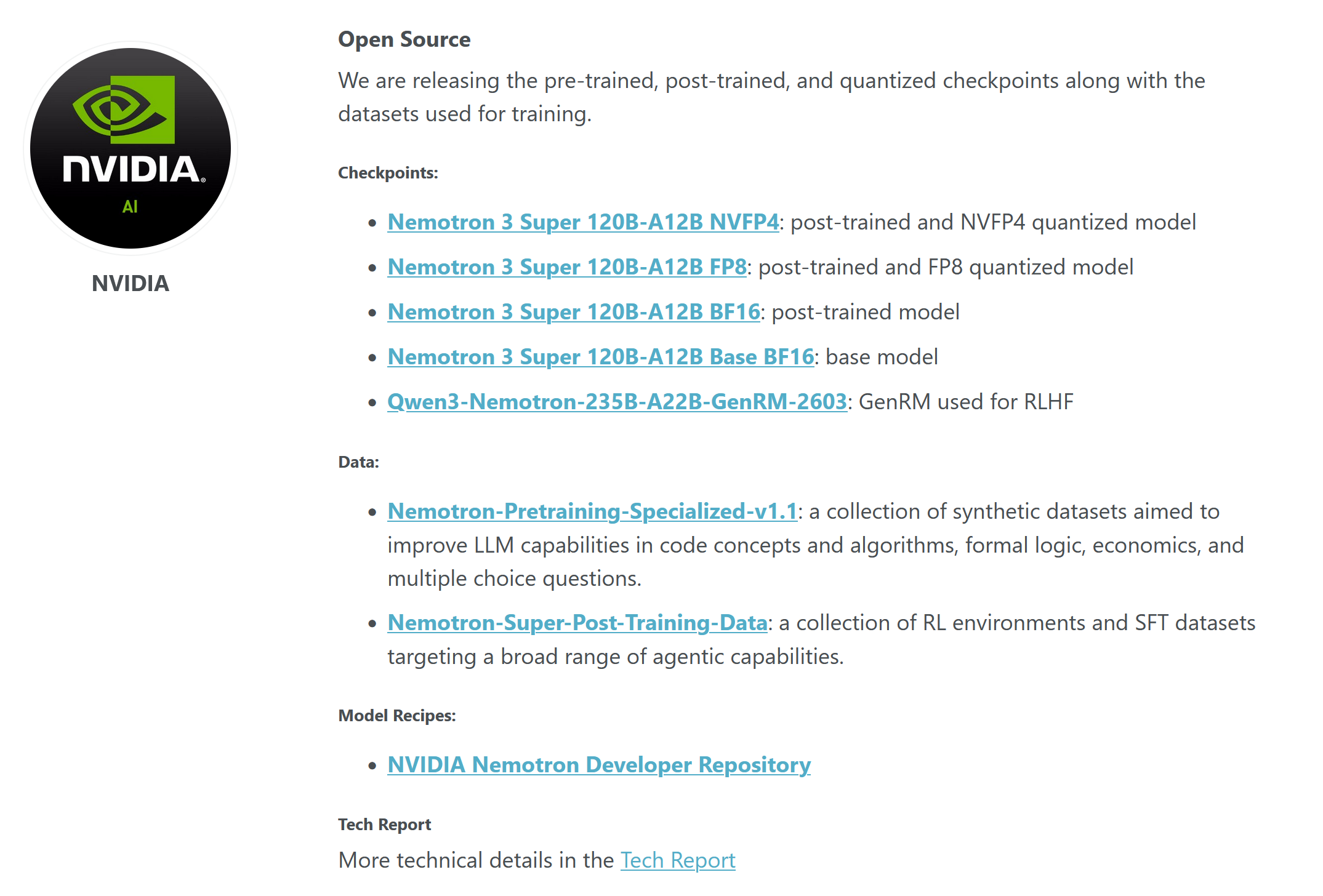

该模型基于超 25万亿 token 训练,全面开放了模型权重、训练数据及配方。目前,开发者已可通过 Hugging Face、NVIDIA NIM 及多家云服务平台获取并部署该模型,适用于 Agentic AI 等高负载工作流。

相关链接:

- https://huggingface.co/nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-BF16

- https://research.nvidia.com/labs/nemotron/files/NVIDIA-Nemotron-3-Super-Technical-Report.pdf

- https://blogs.nvidia.com/blog/nemotron-3-super-agentic-ai/

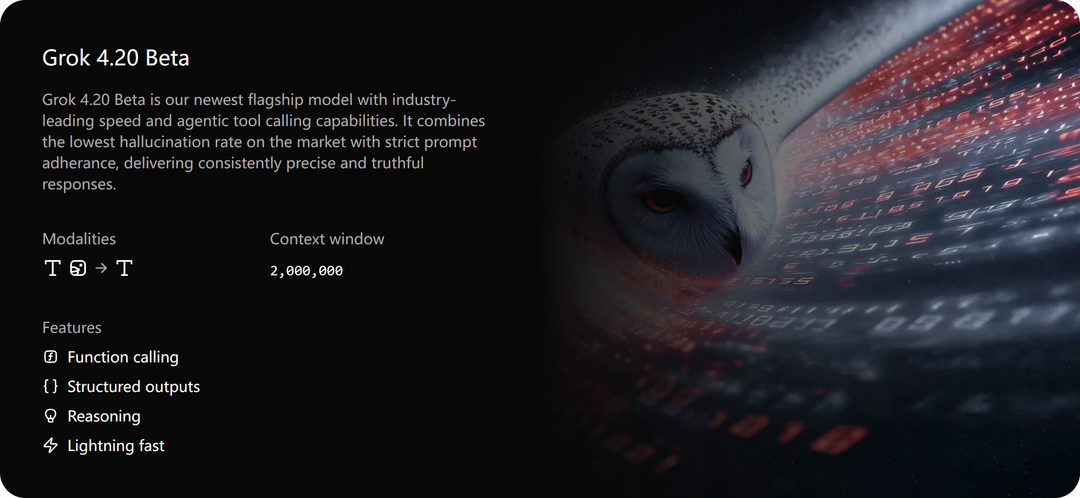

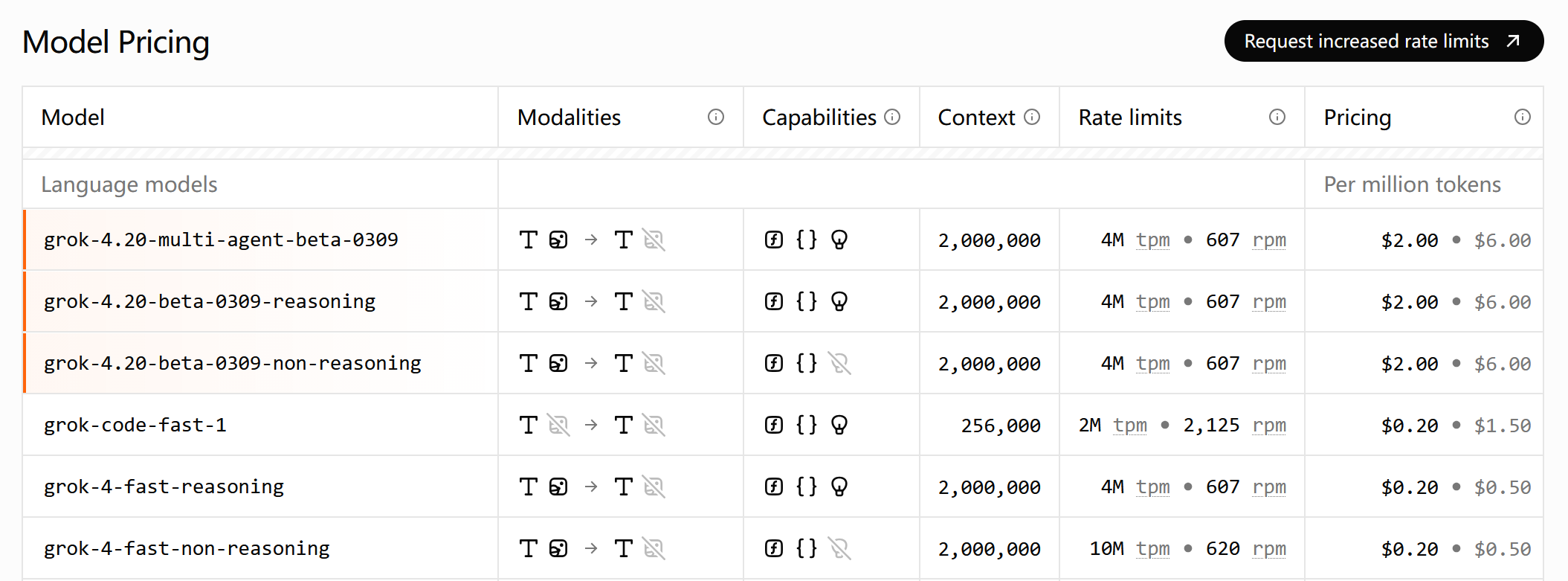

xAI 在API中上线 Grok 4.20 系列,支持 200 万 token 上下文 #2

xAI 正式通过 API 上线了三款

Grok-4.20系列旗舰模型,分别针对非推理、推理及多智能体协作场景提供 Beta 版本。3个版本定价一致,较前代有大幅提升。

xAI 通过 API 上线三款 Grok-4.20 系列 Beta 模型,涵盖非推理、推理及多 Agent 协作版本。该系列支持 200 万 token 上下文窗口,在保持高速运行的同时引入 Agentic 工具调用能力,并针对降低幻觉率与提示词遵循进行了优化。

定价方面,3个版本的模型定价一致,在 128k token 以内请求的输入输出价格分别为每百万 token 2.00 美元 和 6.00 美元,定价大幅提升。

目前上述模型已加入 API 列表供开发者调用。

相关链接:

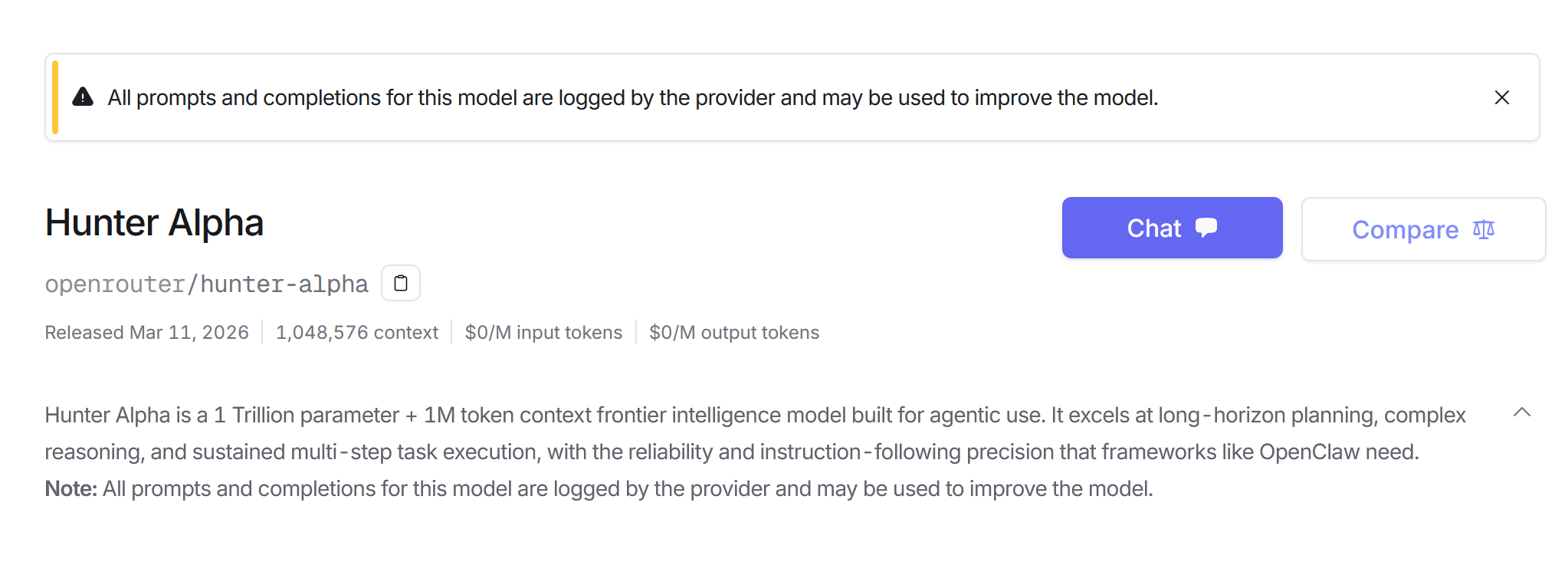

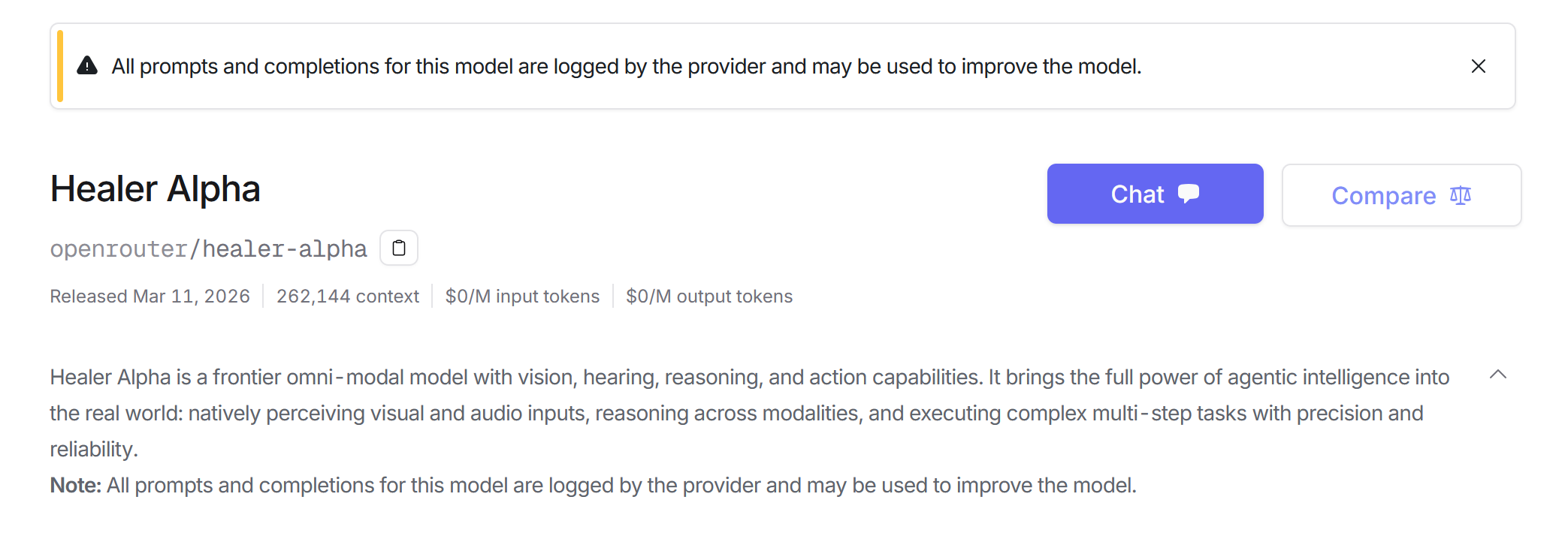

OpenRouter 上线两款 Stealth 模型 #3

OpenRouter 平台上架了名为 Hunter Alpha 和 Healer Alpha 的 Stealth 模型。

其中 Hunter Alpha 拥有 1 万亿 参数及 100 万 token 上下文窗口,专攻 Agent 长程规划与复杂推理。

而 Healer Alpha 则是具备视听能力的全模态模型。

这两款模型目前均支持免费调用。

OpenRouter平台近日发布 Hunter Alpha 和 Healer Alpha 两款 Stealth 模型。

Hunter Alpha 拥有 1万亿 参数及 100万 token 上下文窗口,官方称其专为 Agent 应用构建,擅长长程规划与复杂推理。

Healer Alpha 定位全模态,具备视听及推理行动能力,其上下文窗口为 262,144 token。

两款模型目前均提供免费调用,上述模型由 “Stealth” 提供商支持,所有提示词可能被记录。

相关链接:

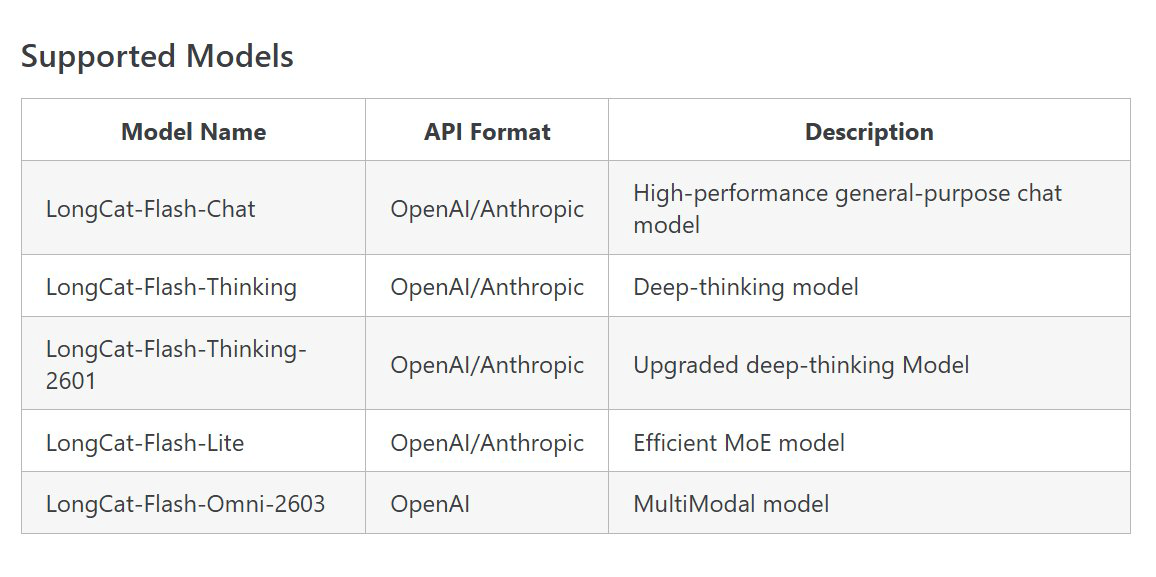

龙猫在API中上线 LongCat-Flash-Omni,免费可用 #4

美团龙猫上线支持原生跨模态交互的

LongCat-Flash-Omni模型的 API。 同时,LongCat-Flash-Thinking接口已无缝升级至 2601 版本。

龙猫官方宣布API服务迎来重大更新。LongCat-Flash-Omni现已支持API调用,解锁原生跨模态交互能力,APP端用户可同步体验。

此外,LongCat-Flash-Thinking接口即将进行无缝升级,其调用请求将自动路由至LongCat-Flash-Thinking-2601版本,老用户无需修改代码即可享受服务。官方称,2601版本在抗噪鲁棒性、处理复杂工具图谱的Agent能力以及深度推理能力上均有显著提升。

相关链接:

- https://longcat.chat/platform/docs/zh/APIDocs.html

- https://x.com/Meituan_LongCat/status/2031726847978082305

MiroMind 发布 MiroThinker 系列 Agent,含开源模型与定制版 #5

MiroMind 团队发布了新一代深度研究 Agent 家族,包含基于

Qwen3架构的 MiroThinker 1.7 及其 mini 版开源模型,以及专有的定制化 Agent MiroThinker-H1。该系列模型支持

256K上下文窗口和最高300次工具调用,针对长周期任务优化了多步分析与推理能力。

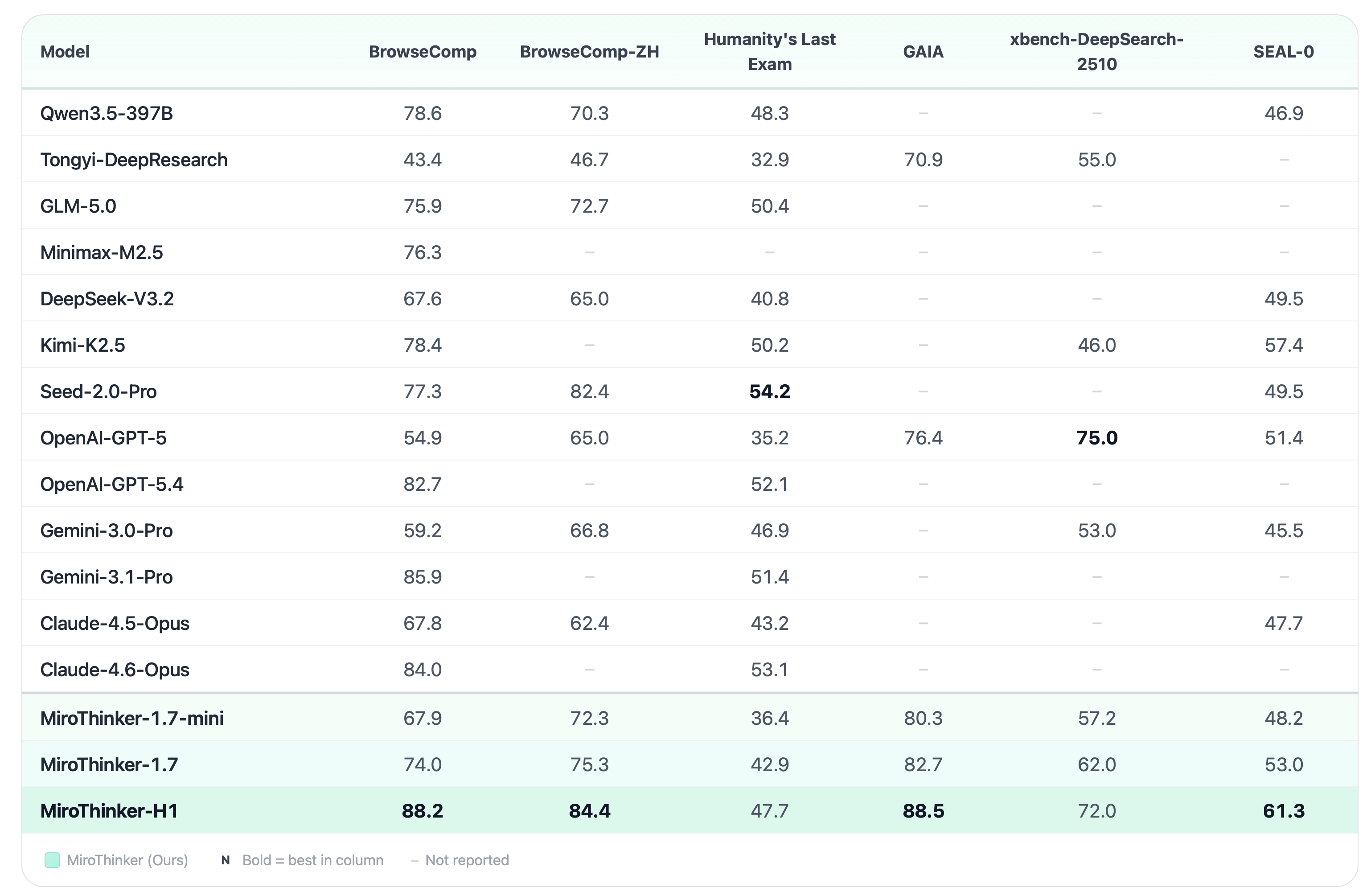

MiroMind团队发布新一代深度研究Agent家族,涵盖开源模型 MiroThinker-1.7 及其mini版(基于 Qwen3),以及专有Agent MiroThinker-H1。该系列针对长周期任务优化了推理能力,支持 256K 上下文与 300 次工具调用,并引入上下文留存策略提升性能。系统通过 MCP 协议管理交互,兼容多种扩展工具。

依据官方披露的数据,MiroThinker-1.7 在 BrowseComp 测试集达到 74.0% 准确率,在 BrowseComp-ZH 达到 75.3%,在 GAIA-Val-165 达到 82.7%,在 HLE-Text 达到 42.9%,同时在 Seal-0 及多项科学与金融评估任务中取得对应分数。

30B 规模的 MiroThinker-1.7-mini 在 BrowseComp-ZH 测试中取得 72.3% 的成绩。

对于专有Agent MiroThinker-H1,官方数据显示其在 BrowseComp 与 BrowseComp-ZH 榜单中处于领先水位。

相关链接:

- https://github.com/MiroMindAI/MiroThinker

- https://huggingface.co/collections/miromind-ai/mirothinker-17

Reka 发布 70 亿参数 Reka Edge 模型并开源 #6

Reka 发布了专为边缘计算设计的 70 亿参数多模态模型 Reka Edge,它在视频理解和工具调用上的表现超越了

Qwen3.5 9B。该模型权重已在 Hugging Face 发布。

Reka 官方近日发布了 70 亿参数多模态模型 Reka Edge,专为边缘计算场景设计。该模型结合 ConvNeXt V2 编码器与 Transformer 主干,支持图像、视频及文本处理。

据官方介绍,其架构创新将高分辨率图像处理的 Token 消耗降至同类模型的三分之一,显著提升了推理速度。

官方数据显示,该模型在视频理解及工具调用等基准上优于同量级竞品。此外,其支持 4-bit 量化,显存占用降至 5GB 并保留超 98% 性能。

目前,Reka Edge 已在 Hugging Face 开源,并广泛兼容 Apple Silicon、NVIDIA Jetson 及 Qualcomm Snapdragon 等硬件平台。

相关链接:

- https://reka.ai/news/reka-edge-frontier-level-edge-intelligence-for-physical-ai

- https://huggingface.co/RekaAI/reka-edge-2603

Antigravity 调整 AI 订阅计划权益,额度或将下调 #7

Antigravity 宣布调整 AI 订阅计划权益。此次更新明确了两种定位:Google AI Pro 适合开发者和学生,提供

Gemini Flash额度及高级模型试用;Google AI Ultra 则支持对复杂模型的高频访问。

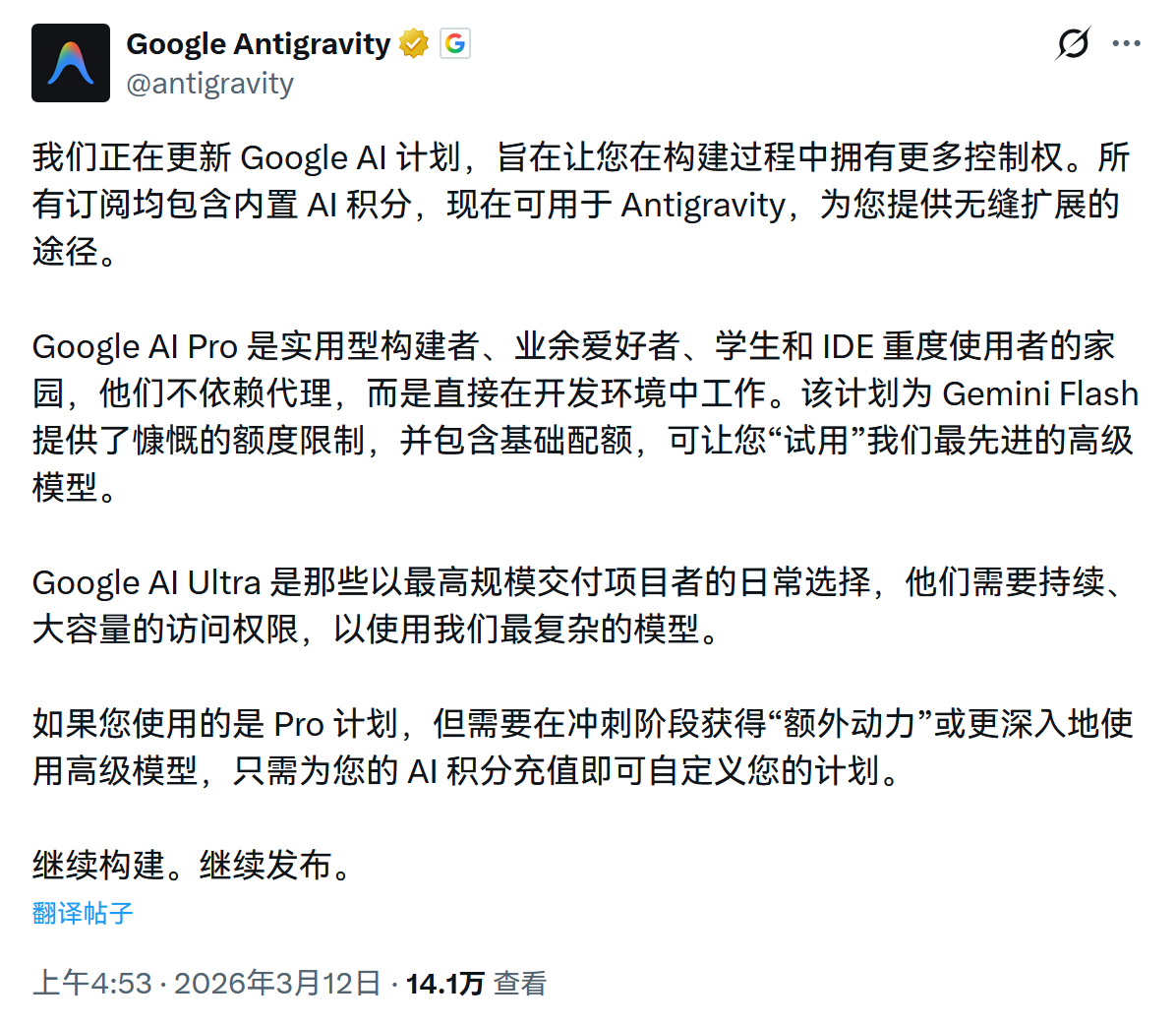

Antigravity 宣布对其 Google AI 订阅计划进行调整,旨在赋予开发者更多构建控制权。

目前,所有订阅计划均包含内置 AI 额度,且已支持用于 Antigravity:Google AI Pro 面向构建者及学生群体,该计划为 Gemini Flash 提供宽裕限额,并包含高级模型测试配额;Google AI Ultra 则针对大规模交付用户,满足其对复杂模型的高容量持续访问需求。

此外,若 Pro 用户需要额外动力,官方支持其通过充值额度灵活定制计划。

相关链接:

智谱宣布本月向 Lite 用户开放 GLM-5,首批需申请 #8

智谱宣布本月内向 Lite 用户逐步开放 GLM-5,首批名额采取先到先得的问卷申请机制,全量开放最晚不迟于 3 月底。

智谱宣布计划在本月内为所有 Lite 用户逐步开放 GLM-5 模型。由于资源限制,首批名额采取“先到先得”申请制,成功提交 ID 者将在 1 个工作日内获权。

申请量达上限后将转为 Waiting List 模式,官方承诺最晚不迟于 3 月底通过短信通知开通。

相关链接:

Codex 重置速率限制但限额显示异常 #9

Codex 因 GPU 集群高负载进行了紧急维护,并已于北京时间 3月11日 下午重置速率限制作为补偿。

同时有用户发现限额文案显示为“2周”,但截止日期未变,官方尚未对此作出解释。

Codex团队成员透露,GPU集群因高负载面临运行压力。团队全力维护,已恢复稳定。

作为补偿,Codex已于北京时间3月11日下午重置了速率限制。

与此同时,有用户发现,Codex的“1周”限额的相关字符变成了“2周”,但对应的日期仍是一周后,官方尚未对此做出解释。

相关链接:

Google 发布 Gemini CLI 周更,集成计划模式 #10

Gemini CLI 发布每周更新,核心引入了 Plan Mode 计划模式。同时本次更新还实现了将聊天历史默认保留期延长到了 30 天等多项功能优化。

Google 正式发布 Gemini CLI v0.33.0 版本,核心引入 Plan Mode(计划模式)。据官方介绍,该模式提供一个只读环境,允许 Agent 在执行代码变更前进行安全分析与规划,且仅限使用只读工具。其集成了 ask_user 工具以便在信息不足时向用户提问,并自动路由至具备高推理能力的 Gemini 3.1 Pro 模型以确保规划质量。

此外,本次更新优化了 ACP 平台,增加了斜杠命令处理及模型设置接口。UI 界面经过重新设计,修复了 Agent 循环检测问题,并将聊天历史默认保留期延长至 30 天。同时,该版本新增了 Shopify 和 Canva 扩展,进一步丰富了其生态集成能力。

相关链接:

- https://developers.googleblog.com/plan-mode-now-available-in-gemini-cli/

- https://github.com/google-gemini/gemini-cli/discussions/22078

Cursor 新增超 30 款插件,集成 Hugging Face 官方功能 #11

Cursor 官方宣布 Marketplace 新增超过 30 款插件,其中 Hugging Face 的官方工具支持开发者直接在编辑器内创建数据集及训练模型。

Hugging Face的集成让开发者无需离开编辑环境,即可完成从数据准备到模型训练的完整流程。

Cursor 官方宣布其 Marketplace 近期新增超过 30 款新 Plugin,进一步扩展了该代码编辑器的生态能力。

其中,Hugging Face 发布的官方 Plugin 支持开发者在 Cursor 环境内直接创建数据集、运行 Evals 以及训练模型。

相关链接:

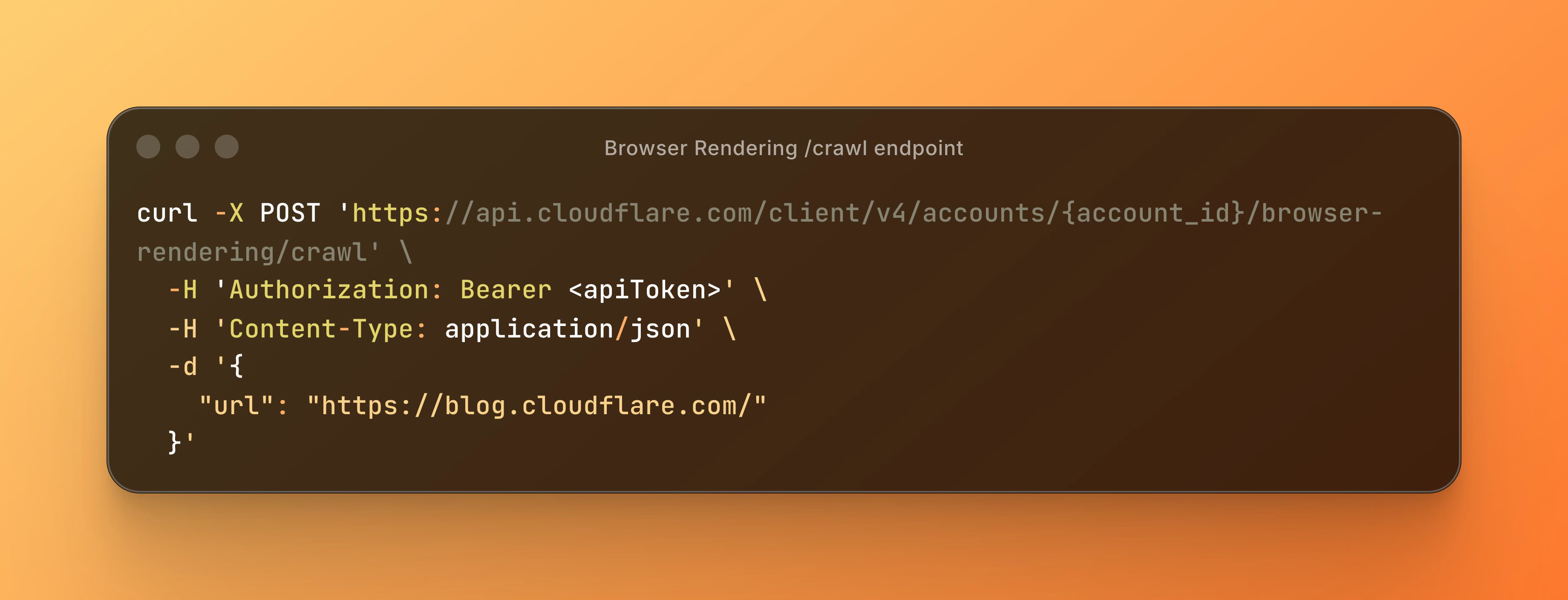

Cloudflare 上线爬虫端点 #12

Cloudflare 宣布 Browser Rendering 服务上线

/crawl端点公测版,开发者通过一次 API 调用即可自动抓取并渲染全站内容。该功能支持多种输出格式和增量抓取配置,严格遵守robots.txt协议。

Cloudflare 官方宣布其 Browser Rendering 服务推出了全新的 /crawl 端点,目前已进入开放公测阶段。

开发者仅需通过一次 API 调用提交起始 URL,系统即可自动发现、渲染并抓取整个网站的内容,该过程以异步方式运行,支持返回 HTML、Markdown 及由 Workers AI 驱动的结构化 JSON 格式,适用于模型训练及 RAG 管道构建。

该功能提供了抓取范围控制、增量抓取及静态模式等多种配置选项,并严格遵守 robots.txt 协议,现已向 Workers 免费及付费计划用户开放。

相关链接:

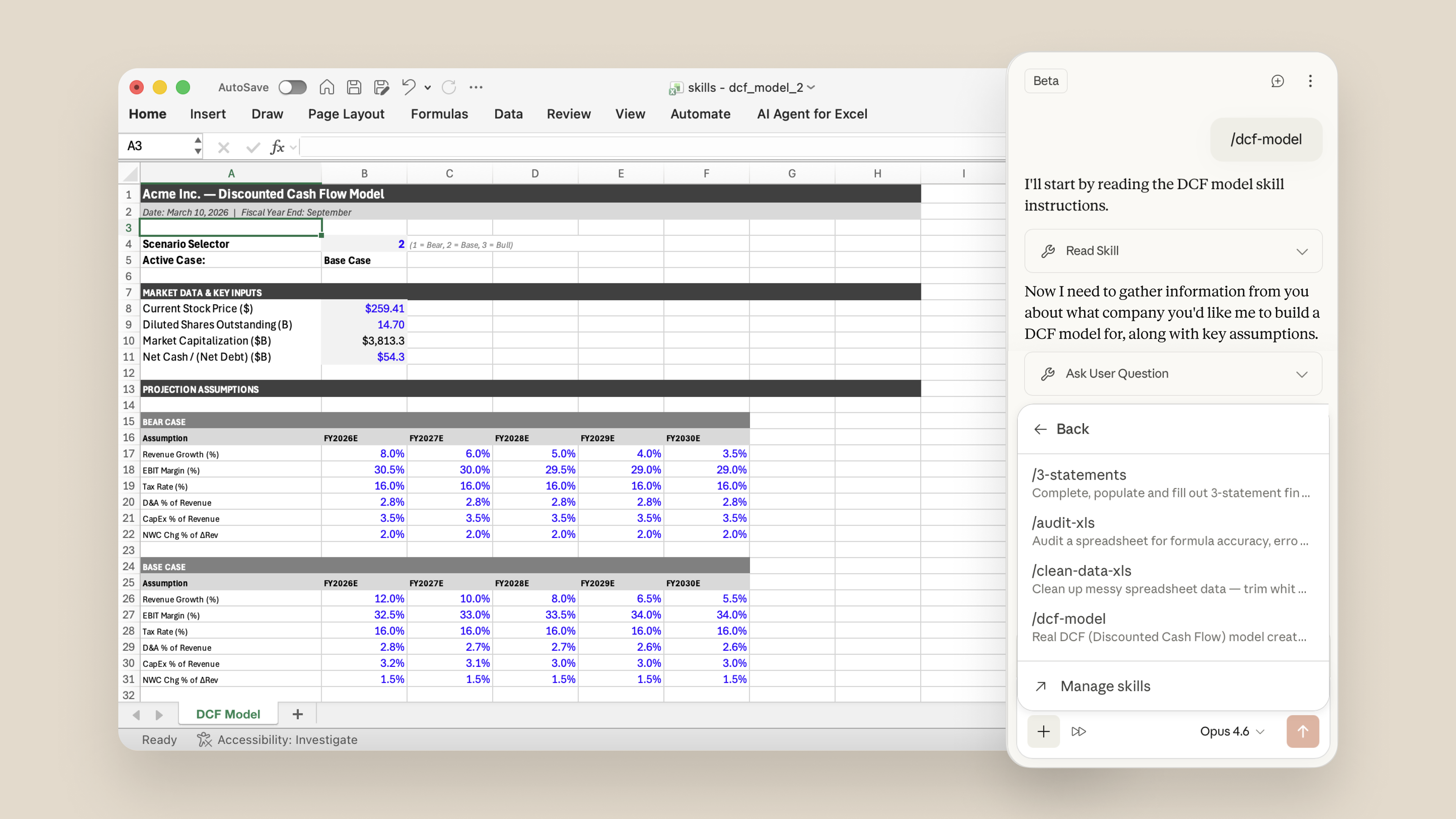

Claude for Excel 与 PowerPoint 插件新增支持跨应用上下文同步及 Skills #13

Claude 宣布 Excel 和 PowerPoint 插件现已实现跨应用全上下文同步,支持用户在单一连续对话中跨多个文件处理数据。

同时,新推出的

Skills功能可将财务模型构建和幻灯片审查等复杂流程封装为一键操作。

Claude for Excel 和 Claude for PowerPoint 插件近日宣布实现跨应用全上下文同步,允许用户在一个连续对话中跨多个打开的文件进行操作。该功能支持读取单元格、编写公式及编辑幻灯片,并能理解不同文件间的数据关系,从而无需在不同工具间切换。

此外,官方引入“Skills”功能,将财务分析等最佳实践封装为可复用的一键操作,并预置了涵盖 LBO、DCF 等模型构建的技能包。

在部署方面,该插件支持通过 Amazon Bedrock、Google Cloud Vertex AI 和 Microsoft Foundry 接入,并可在 Excel 中通过 Agent Mode 与 Microsoft 365 Copilot 协同。

目前,上述功能已向 Mac 和 Windows 付费用户开放 Beta 测试。

相关链接:

- https://claude.com/blog/claude-excel-powerpoint-updates

- https://claude.com/claude-in-excel

- https://claude.com/claude-in-powerpoint

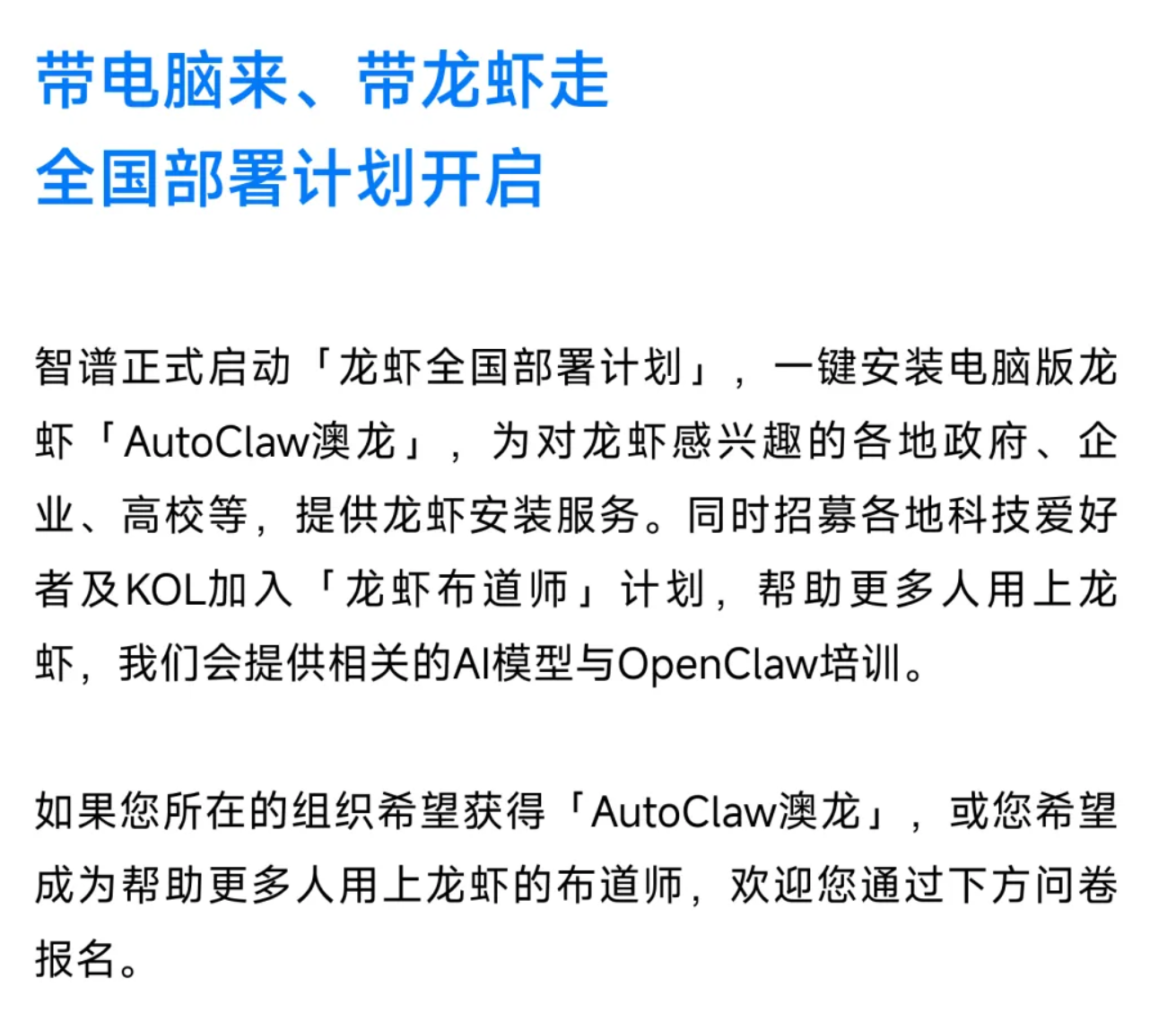

各种厂商推出龙虾系列产品,网信办提示风险 #14

围绕开源智能体 OpenClaw 即“龙虾”,智谱、荣耀、商汤、华为、百度 及 腾讯 等厂商密集发布产品或行动,构建起覆盖手机、办公及云端的“龙虾宇宙”生态。

与此同时,官方机构发布风险提示,指出该技术存在权限失控、数据隐私泄露及恶意攻击等五大安全隐患。

围绕开源智能体 OpenClaw,国内科技企业密集发布新品构建“龙虾宇宙”。

荣耀推出支持多端交互的“龙虾宇宙”;

商汤将“办公小浣熊”接入该生态,并提供软硬一体方案;

华为发布鸿蒙“小艺Claw”Beta版;

百度智能云上线零部署服务 DuClaw;

智谱启动面向组织的全国部署计划。

腾讯方面称其产品矩阵将陆续推出。

与此同时,中央网信办数据与技术保障中心发布风险提示,指出该技术存在权限失控、漏洞攻击、隐私泄露及恶意技能投毒等风险,建议用户注意安全防范。

相关链接:

Perplexity 推出 Personal Computer #15

Perplexity推出了名为 Personal Computer 的新产品,这是一个基于

Mac mini持续运行的智能体,能 7x24 小时为用户提供本地化智能服务。目前候补名单已开放。

Perplexity 官方宣布推出名为 "Personal Computer" 的新产品,这是一款基于 Mac mini 持续运行的智能体。

据官方描述,该产品旨在提供 7x24 小时不间断的本地化智能服务,具备跨文件、应用及会话执行任务的能力。

其运行环境连接了本地应用与 Perplexity 安全服务器,并支持用户从任意设备进行远程控制。

目前,该产品的候补名单已开放注册。

相关链接:

- http://perplexity.ai/personal-computer-waitlist

- https://x.com/perplexity_ai/status/2031790180521427166

谷歌将 Gemini in Chrome 扩展至印度等国 #16

Google 正式将 Chrome 浏览器的 Gemini AI 功能扩展至 印度、新西兰 和 加拿大,并新增支持 印地语、法语 等 50 多种语言。

Google 官方宣布 Gemini in Chrome 扩展至印度、新西兰和加拿大,新增支持 50 多种语言。该功能基于 Gemini 3.1 模型,率先登陆桌面端和 iOS,Android 端通过长按电源键激活。

用户可在不切换标签页时调用该助手进行内容总结及跨标签页信息整合,并集成 Gmail、Maps 等应用实现端内操作。

此外,Chrome 内置的 Nano Banana 2 支持侧边栏实时处理图像。

相关链接:

腾讯玄武实验室发布端侧隐私工具 HaS #17

腾讯玄武实验室在 ClawHub 平台发布了一个名为 Has Anonymizer 的 Skill,该 Skill 旨在实现端侧隐私保护,能在本地设备完成文本和图像的敏感数据扫描、匿名化及还原。

腾讯玄武实验室在 ClawHub 发布一个旨在实现端侧隐私保护的 Skill:Has Anonymizer (HaS)。该工具可对文本和图像进行敏感数据扫描、匿名化及还原。

文本方面,其集成 0.6B 模型,支持中英等 8 种语言及开放式实体识别,利用语义标签辅助还原。

图像方面,HaS 基于 YOLO11 模型,支持对人脸、证件等 21 类区域进行像素级掩码。

相关链接:

- https://clawhub.ai/XuanwuSkill/has-anonymizer

- https://x.com/TencentAI_News/status/2031651938274599055

黄仁勋发文,提出五层架构模型 #18

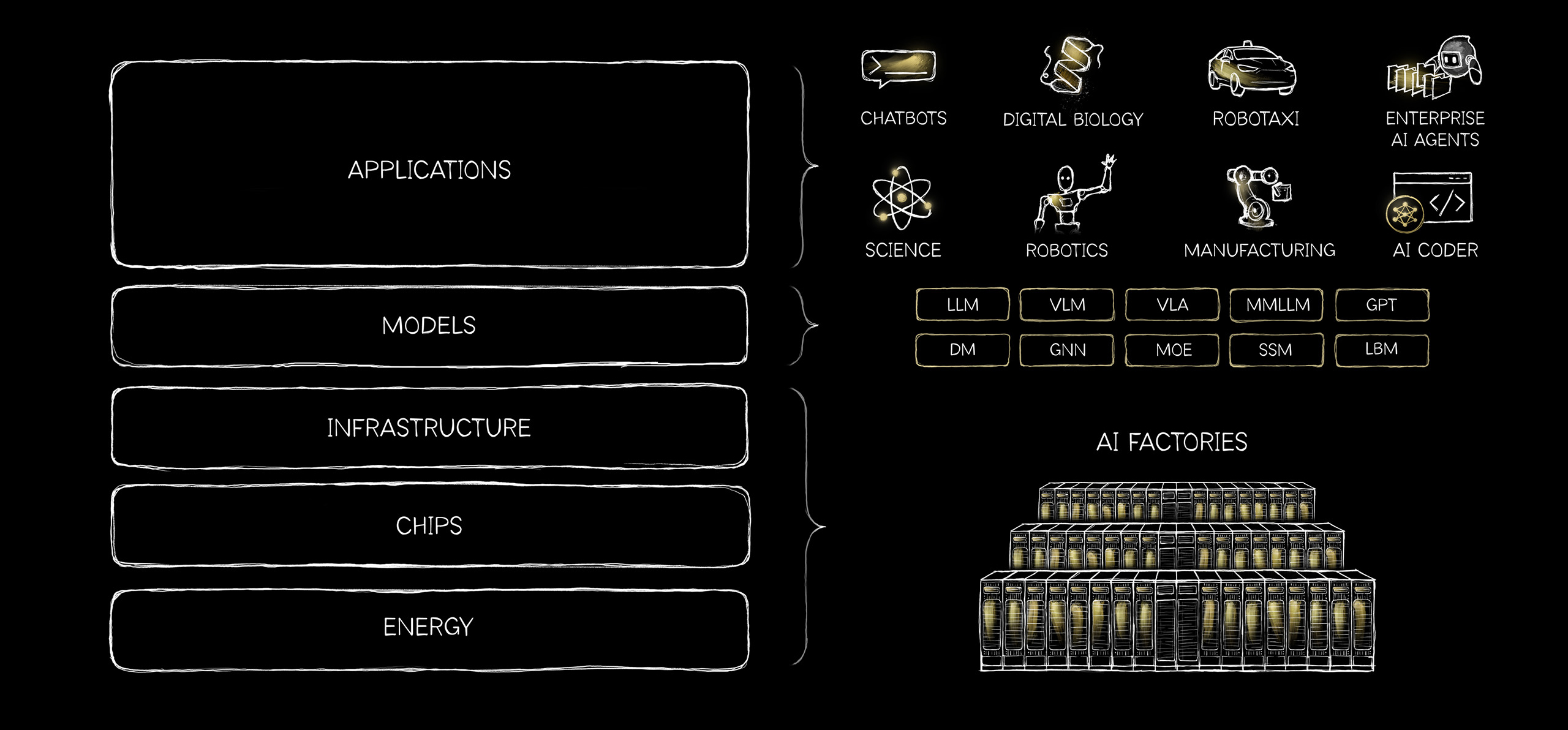

黄仁勋发文,将 AI 定义为类似电力的核心基础设施,并提出了涵盖能源、芯片、设施、模型及应用这五层相互强化的全栈架构。他指出计算模式已转向实时智能生成,全球 AI 工厂建设将带动数万亿美元投入。

黄仁勋发布博客,将 AI 定义为基础设施并提出“五层蛋糕”架构。他指出计算模式已转向实时智能生成,需全栈重构。全球正大规模建设 AI 工厂,相关投入预计将增至数万亿美元。

该架构各层相互强化:能源层是物理限制;芯片层转化算力;基础设施层构建“AI 工厂”;模型层处理多模态信息,DeepSeek-R1 等开源模型拉动了底层需求;应用层产生经济价值。

黄仁勋称 AI 推理能力已增强,建设带动了技术工种需求。他认为目前进程尚处早期,但 AI 作为现代世界基础设施的地位已确立。

相关链接:

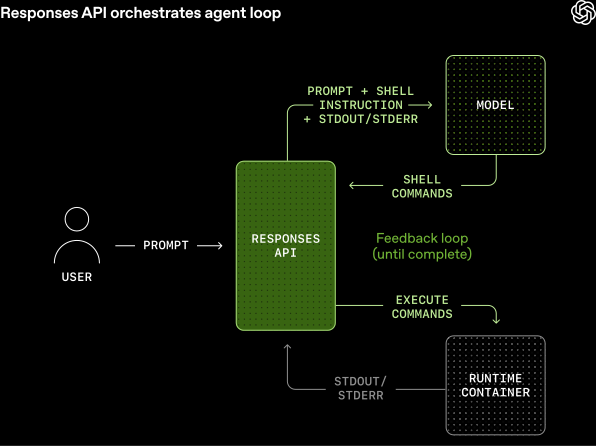

OpenAI 为 Responses API 引入计算机环境支持 Agent 转型 #19

OpenAI 发布文章介绍其为 Responses API 推出的 “计算机环境”(computer environment),旨在推动 AI 从单一任务模型向复杂工作流 Agent 转型。

OpenAI 发布文章介绍其为 Responses API 推出的“计算机环境”(computer environment),该功能集成 Shell tool、托管容器、原生 Compaction 及 Agent Skills,旨在推动 AI 向处理复杂工作流的 Agent 转型。

根据官方博客,Shell tool 允许 GPT-5.2 及以后版本模型通过命令行交互与并发执行。托管容器提供隔离环境,并通过 Sidecar egress proxy 保障凭证安全。

针对长时任务,原生 Compaction 机制可加密保留关键状态以解决上下文溢出问题。Agent Skills 则封装可复用逻辑。

该组合实现了安全、可重复的端到端生产级工作流。

相关链接:

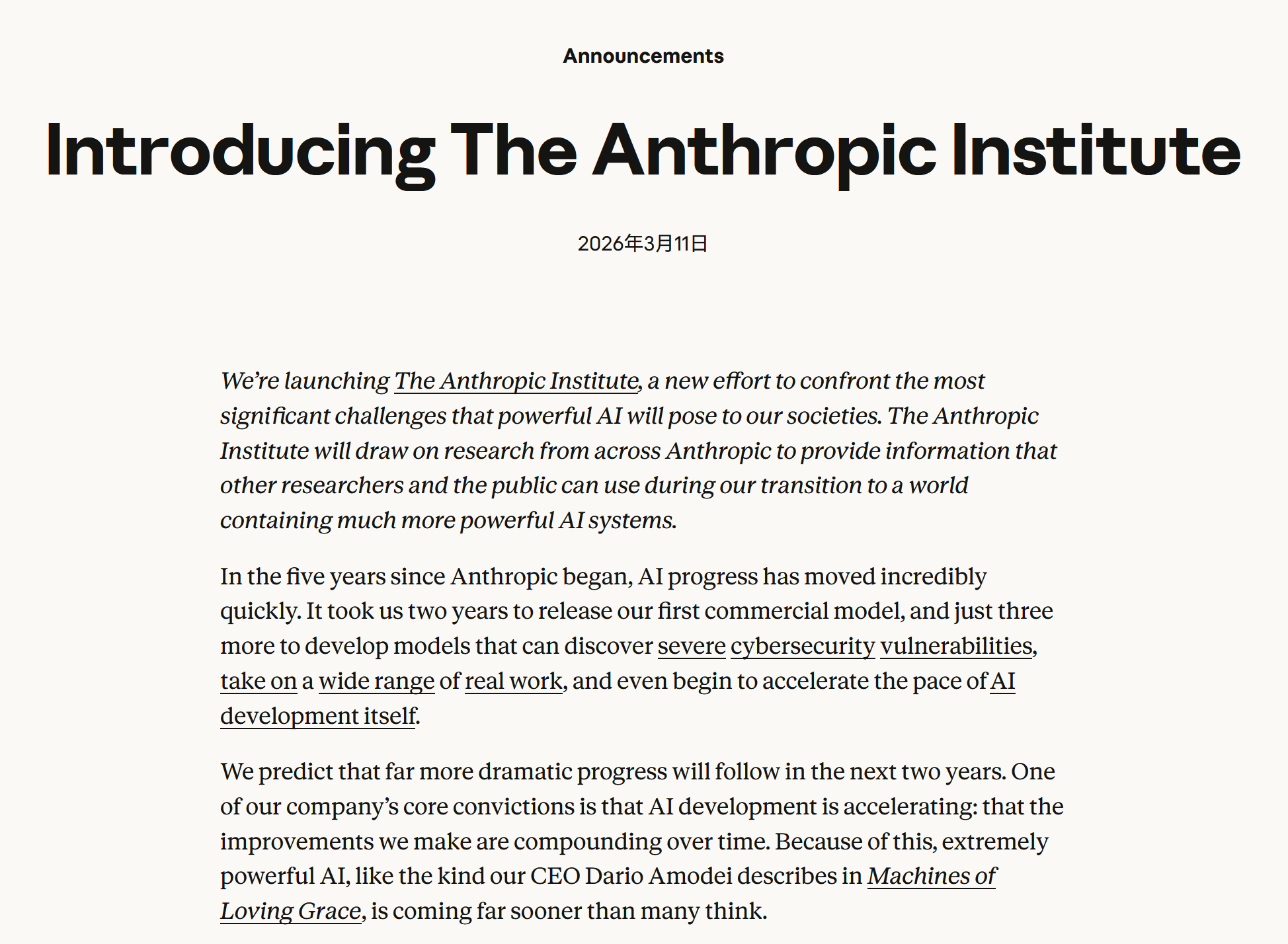

Anthropic 成立研究所应对 AI 挑战,设华盛顿办事处 #20

Anthropic 宣布成立 The Anthropic Institute,由联合创始人 Jack Clark 领导。该机构整合了前沿红队测试、社会影响及经济研究三大团队,旨在利用前沿模型构建者的独特视角,应对强大

AI给社会带来的挑战。

Anthropic宣布推出 The Anthropic Institute,旨在应对强大AI带来的社会挑战。该机构由联合创始人 Jack Clark 领导,整合了 Frontier Red Team 等团队,汇集了机器学习及社会科学等领域的专家。

Matt Botvinick 等多位专家已加入,分别负责AI法治及经济研究。该研究所将利用前沿模型构建者的独特视角,向公众提供信息并进行互动。

同步地,Anthropic扩展了Public Policy团队,任命前Stripe高管 Sarah Heck 为主管。该公司计划今春在华盛顿特区开设首个办事处,以推进模型安全、能源及出口管制等政策目标。

相关链接:

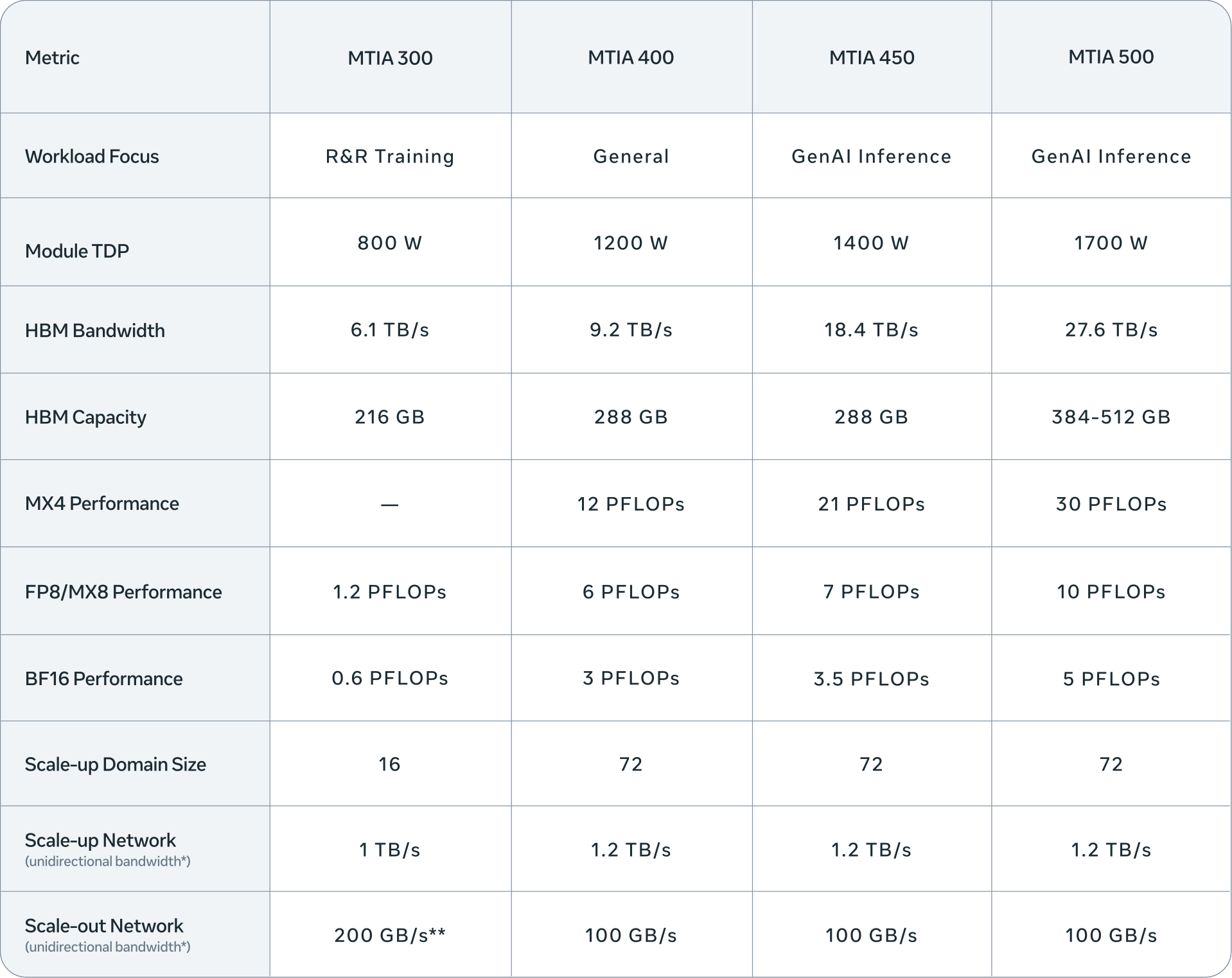

Meta 披露 MTIA 芯片路线图,两年迭代四代 2027 年部署 #21

Meta 官方披露了自研 AI 芯片家族 MTIA 的最新路线图,展示了在两年内迭代四代芯片的成果。该系列芯片采用模块化设计和

PyTorch原生软件栈,旨在通过推理优先策略,为数十亿用户提供更具成本效益的 AI 体验。

Meta 官方披露自研 AI 芯片家族 MTIA 路线图,展示两年内迭代四代芯片的成果。该系列采取推理优先及 PyTorch 原生策略,采用模块化小芯片设计。

其中,MTIA 300 已投入推荐模型训练;MTIA 400 正部署至数据中心;MTIA 450 与 MTIA 500 计划后续部署,重点优化 GenAI 推理,后者 HBM 带宽与容量分别提升 50% 和 80%。

全系列共用系统基础设施,配套基于 Triton 和 Rust 的软件栈,以实现高性价比扩展。

相关链接:

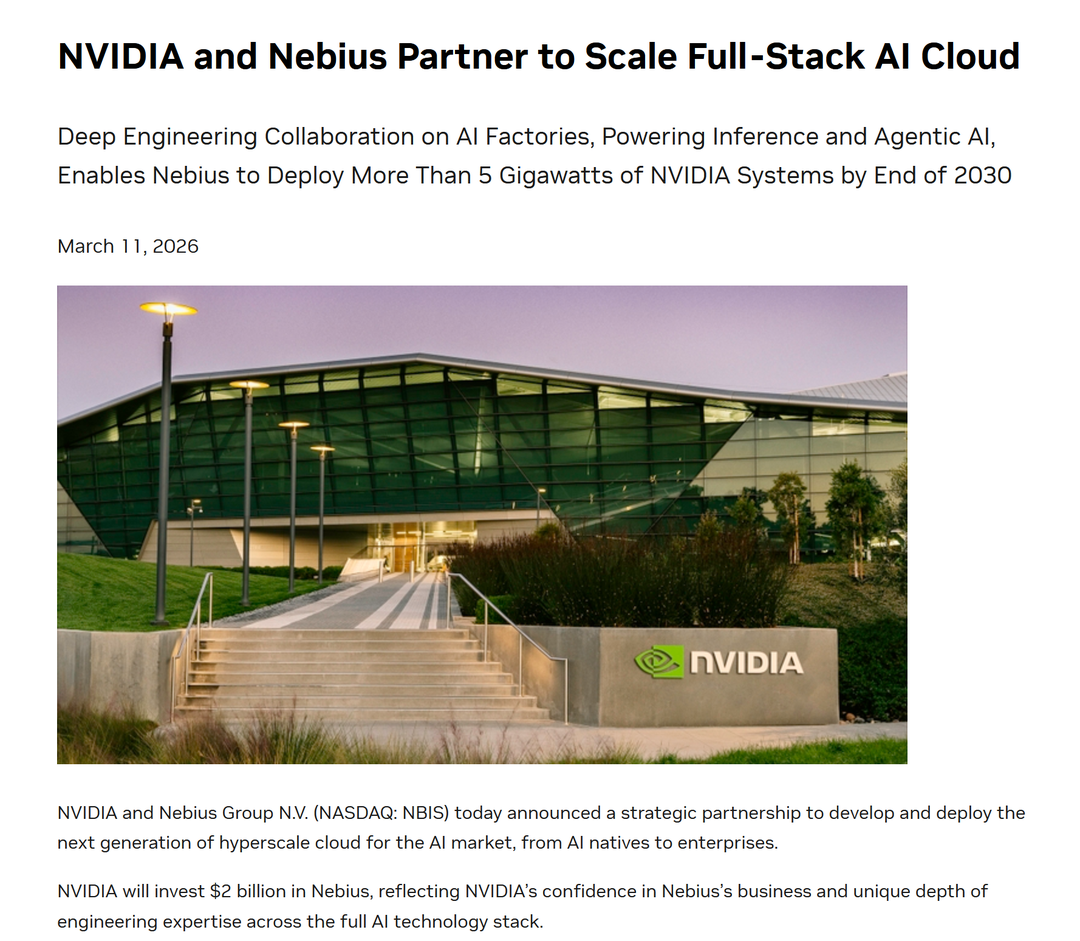

NVIDIA 注资 20 亿美元携手 Nebius 部署 5 吉瓦 AI 系统 #22

NVIDIA 宣布与云服务商 Nebius 建立战略合作伙伴关系,并注资 20 亿美元 以加速构建全栈 AI 云平台。

根据协议,Nebius 将优先采用包括

Rubin平台和Vera CPU在内的最新加速计算架构,计划在 2030 年底前 部署超过 5 吉瓦 的 NVIDIA 系统容量。

NVIDIA 与 Nebius Group N.V. 达成战略合作伙伴关系,NVIDIA 将向后者注资 20 亿美元 以构建全栈 AI 云平台。

根据协议,NVIDIA 支持该平台优先采用含 Rubin 平台、Vera CPU 及 BlueField 系统在内的最新加速计算架构,目标在 2030 年底前 部署超过 5 吉瓦 容量。

双方合作涵盖 AI 工厂设计、推理技术栈构建、基础设施部署及集群健康管理四大领域。

官方表示,此举旨在满足 Agent AI 时代的激增算力需求,并深化全栈技术关系。

相关链接:

- https://nvidianews.nvidia.com/news/nvidia-and-nebius-partner-to-scale-full-stack-ai-cloud

- https://nebius.com/newsroom/nvidia-and-nebius-partner-to-scale-full-stack-ai-cloud

Replit 完成 4 亿美元融资,估值 90 亿美元,发布 Agent 4 #23

AI编程平台 Replit 宣布完成 4亿美元 融资,估值达到 90亿美元,同时发布了速度比前代快10倍的产品

Agent 4。

Replit 官方宣布完成 4 亿美元 融资,估值达 90 亿美元。据媒体报道,本轮融资由 Georgian 领投,参投方包括 a16z、Y Combinator 及卡塔尔投资局等,奥尼尔等个人亦有参与。

与此同时,该团队推出 Agent 4,据官方称其速度较前代快 10 倍,旨在通过处理繁琐工作让用户回归创造核心。

相关链接:

消息称 OpenAI 拟将 Sora 功能集成至 ChatGPT #24

据报道,OpenAI正计划将

Sora视频生成模型直接集成到ChatGPT中,让用户直接在ChatGPT内部调用Sora进行创作。

据 The Information 独家报道,OpenAI 正计划进行战略调整,将其 Sora AI 视频生成功能直接集成至 ChatGPT 平台。

该报道指出,此举标志着该公司的视频生成技术将从独立或受限的访问模式,转变为面向 ChatGPT 用户的内置服务。

通过此次整合,用户未来可能无需依赖独立入口,直接通过 ChatGPT 即可使用 Sora 进行创作。

相关链接:

提示:内容由AI辅助创作,可能存在幻觉和错误。