2026-03-17

AI 早报 2026-03-17

概览

要闻

- Google 逐步向香港用户开放 Gemini 应用 ↗

#1

模型发布

- Mistral AI 发布 Mistral Small 4,开源混合专家模型 ↗

#2 - Mistral AI 发布首个 Lean 4 开源代码 Agent Leanstral ↗

#3 - 腾讯开源 Covo-Audio-Chat 语音模型,支持原生全双工 ↗

#4 - IBM 开源 Granite-4.0-1b-speech 语音模型,支持多语言互译 ↗

#5 - 阿里通义开源 Fun-CineForge 多模态配音模型 ↗

#6

开发生态

- OpenAI Codex 支持 Subagent 机制实现并行任务处理 ↗

#7 - Gemini API 的 Tier 2 门槛降至 100 美元 ↗

#8 - 智谱向部分 Pro 用户优先开放 GLM-5-Turbo ↗

#9 - Stitch 团队发布 TypeScript SDK ↗

#10

产品应用

- Manus 推出“My Computer”,支持 macOS 与 Windows ↗

#11 - Perplexity Computer 功能登陆安卓,实现跨设备同步 ↗

#12 - MuleRun 发布 2.0,首创四层架构实现自我进化

#13 - NVIDIA 开放 DGX Station 订购,GB300 芯片支持万亿大模型 ↗

#14

技术与洞察

- 月之暗面发布 AttnRes 技术,优化 Transformer 残差连接效率 ↗

#15 - Percepta 团队构建 Transformer 内置计算机,实现百万步精确计算 ↗

#16 - Workshop Labs 发布 Silo 私有技术栈,提供硬件级隐私保障 ↗

#17 - 英伟达发布 Dynamo 1.0 推理框架,吞吐量最高提升 7 倍 ↗

#18 - 清华 MAIC 项目开源 OpenMAIC 多 Agent 交互课堂 ↗

#19

行业动态

- 英伟达发布 Vera Rubin 平台,整合七款芯片开启 Agentic AI ↗

#20 - 英伟达发布 Groq 3 LPX,为 Vera Rubin 平台提供推理加速 ↗

#21 - 英伟达发布 DLSS 5,融合生成式 AI,秋季正式推出 ↗

#22 - 英伟达成立 Nemotron 联盟,联合 Mistral 开发开放模型 ↗

#23 - Nebius 与 Meta 签署 AI 基础设施协议,价值达 270 亿美元 ↗

#24 - 阿里巴巴成立 Token Hub 事业群,吴泳铭整合 AI 资源

#25

前瞻与传闻

Claw专题

- 英伟达推出 NemoClaw 企业级开源 AI Agent 平台 ↗

#28 - Ollama 成为 OpenClaw 官方 Provider ↗

#29 - 阅文集团旗下作家助手开启 AI 智能体 Claw 内测 ↗

#30 - 元宝 App 支持接入 OpenClaw,实现多人共养 ↗

#31

Google 逐步向香港用户开放 Gemini 应用 #1

据报道,Google 正逐步向所有香港用户开放 Gemini 网页版应用的使用,移动端应用将于之后开放。

据报道,Google 已开始向香港所有用户分阶段开放 Gemini 网页版,移动端随后推出。此前该服务仅限付费企业用户。Google 香港总经理称,此举旨在推动当地创意与生产力发展。

相关链接:

Mistral AI 发布 Mistral Small 4,开源混合专家模型 #2

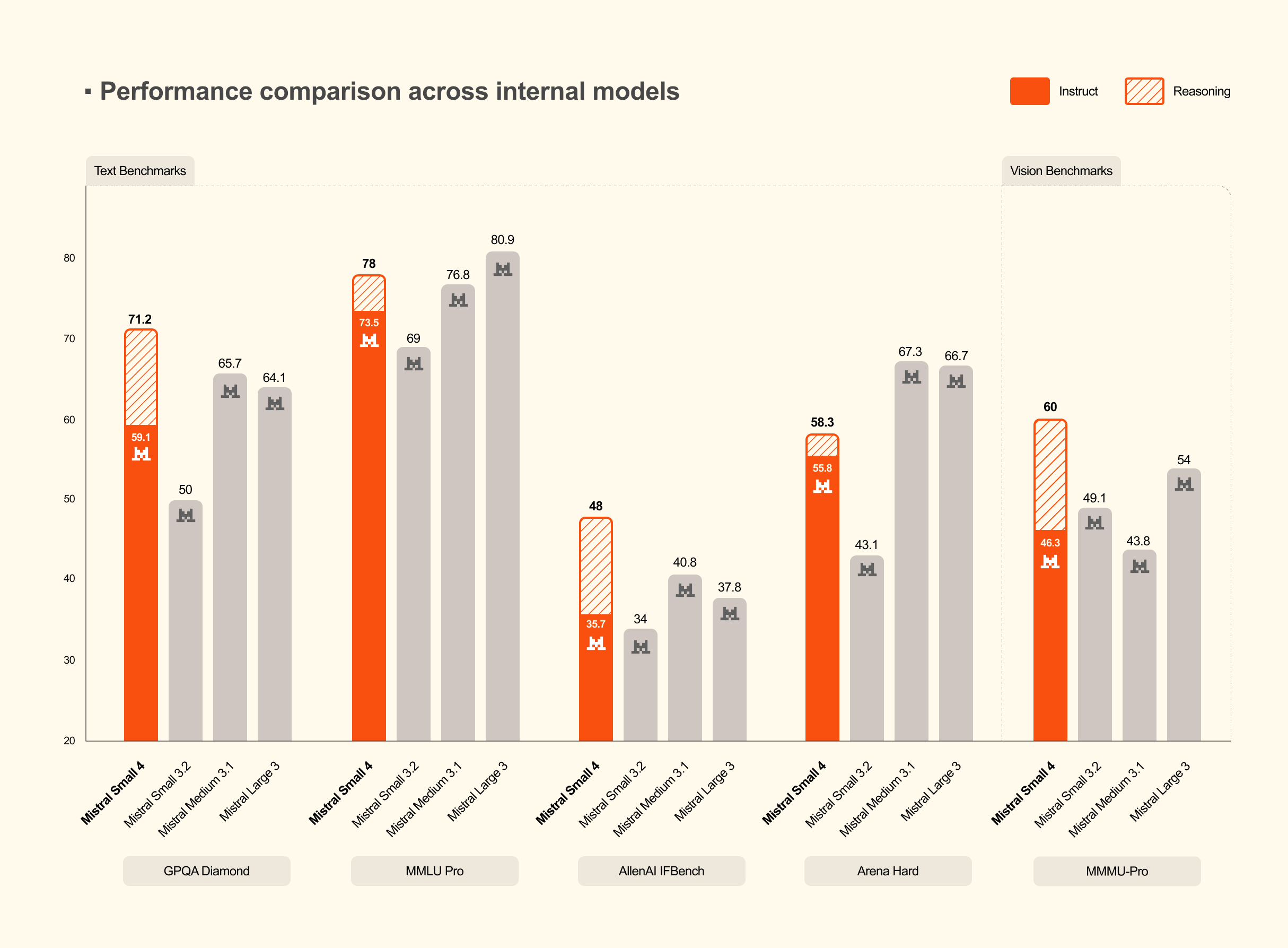

Mistral AI 正式发布了开源混合专家模型

Mistral Small 4,该模型拥有 1190 亿总参数和 256k 上下文窗口,原生支持图文输入。

Mistral AI 正式发布 Mistral Small 4,采用 Apache 2.0 开源许可的混合专家模型。

该模型拥有 1190 亿总参数,支持 256k 上下文及原生图文输入。其引入可配置的 reasoning_effort 参数,实现快速响应与深度推理模式灵活切换。

据官方数据显示,与前代相比,该模型在延迟优化设置下端到端完成时间缩短 40%,吞吐量优化设置下每秒请求数提升 3 倍。

目前,该模型已在 Mistral API、Hugging Face 及 NVIDIA NIM 上线。

相关链接:

- https://mistral.ai/news/mistral-small-4

- https://huggingface.co/collections/mistralai/mistral-small-4

Mistral AI 发布首个 Lean 4 开源代码 Agent Leanstral #3

Mistral AI 发布了其首个专为

Lean 4语言设计的开源代码模型Leanstral,旨在通过可验证编码解决高难度数学证明与软件规范生成的难题。

Mistral AI 近日发布 Leanstral,这是首个专为 Lean 4 设计的开源代码 Agent。

该模型隶属 Mistral Small 4 家族,采用 混合专家架构,拥有 1190 亿 总参数,每次推理激活 65 亿 参数,具备 25.6 万 token 上下文窗口及多模态处理能力。

根据官方数据,在 FLTEval 基准测试中,该模型 pass@2 得分为 26.3,优于 Claude Sonnet 且成本显著更低。

其支持工具调用及 11 种 语言处理。目前,模型已在 Hugging Face 以 Apache 2.0 协议开源,提供 API 端点及 vLLM 本地部署等多种使用方式。

相关链接:

- https://mistral.ai/news/leanstral

- https://huggingface.co/mistralai/Leanstral-2603

- https://docs.mistral.ai/models/leanstral-26-03

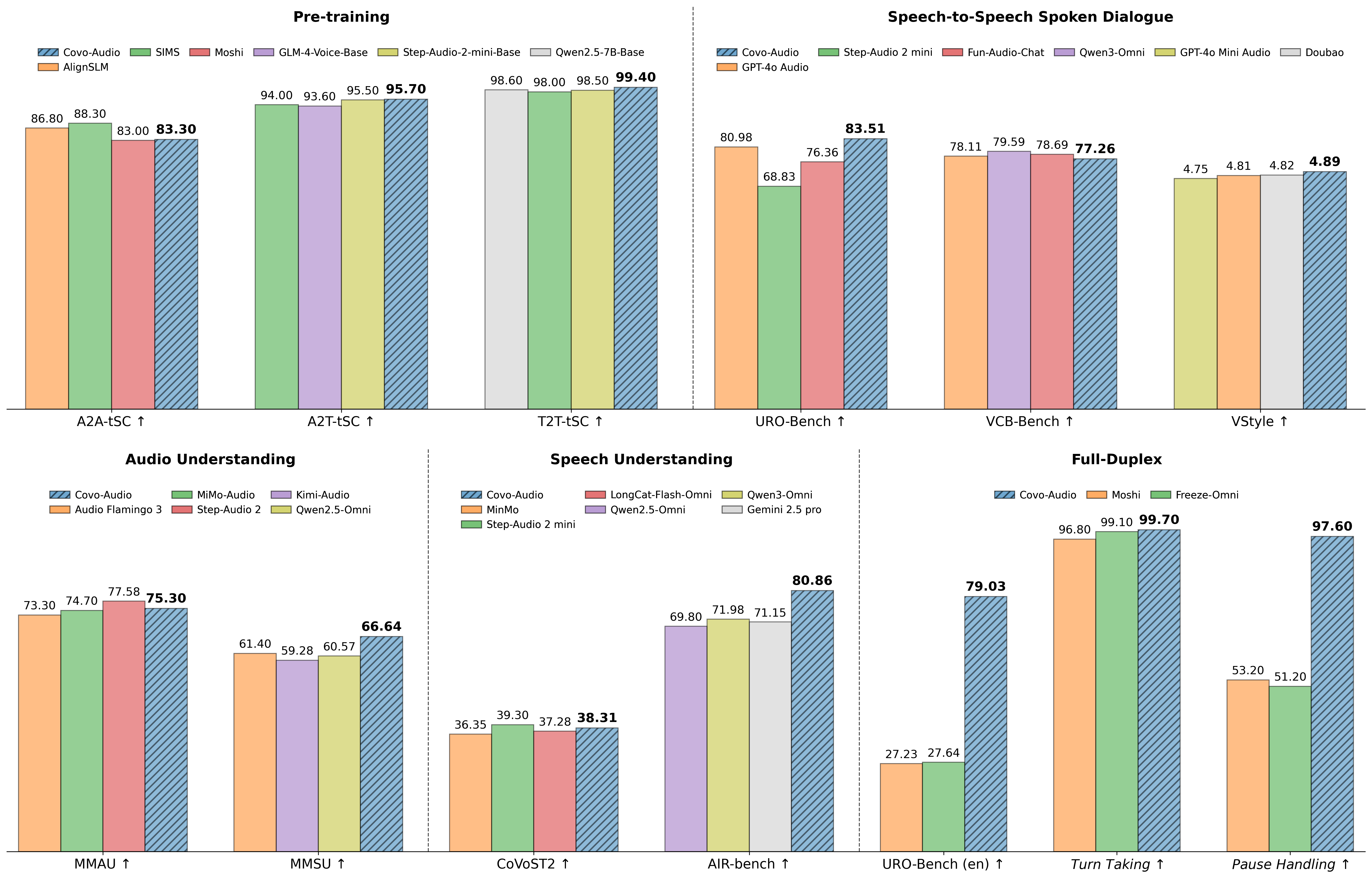

腾讯开源 Covo-Audio-Chat 语音模型,支持原生全双工 #4

腾讯发布了70亿参数的端到端音频语言模型

Covo-Audio-Chat,该模型基于Qwen2.5和Whisper构建,能够通过统一架构实现音频到音频的原生交互及全双工实时通话。

腾讯近日发布 70 亿参数端到端大型音频语言模型 Covo-Audio-Chat。

该模型基于 Qwen2.5-7B 和 Whisper-large-v3 初始化,支持单一架构直接处理连续音频输入并生成输出,实现原生 Audio-to-Audio 交互。

其具备分层三模态语音文本交错、智能与说话人解耦及原生全双工通信能力,特定变体支持低延迟实时对话。

官方宣称该模型在口语对话及音频理解等任务上达到业界领先或竞争力水平。

相关链接:

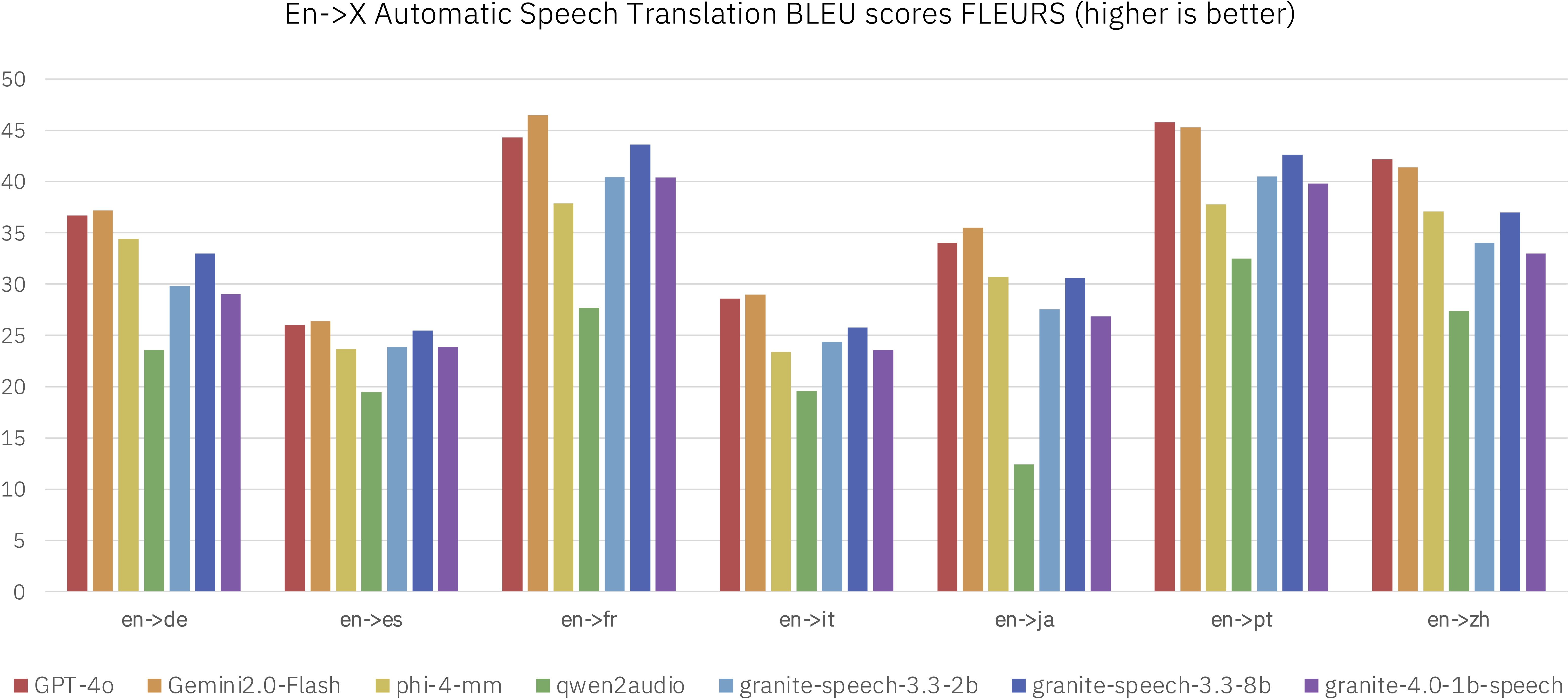

IBM 开源 Granite-4.0-1b-speech 语音模型,支持多语言互译 #5

IBM 开源了

Granite-4.0-1b-speech语音语言模型,支持 英、法、德、西、葡、日 六种语言的语音识别及双向翻译,同时具备 英语到普通话 的翻译能力。

IBM 近日在 Hugging Face 开源 Granite-4.0-1b-speech 模型,采用 Apache 2.0 协议。

该模型专为多语言自动语音识别(ASR)和双向自动语音翻译(AST)设计。官方支持英语、法语、德语、西班牙语、葡萄牙语和日语输入,可实现与英语互译,另支持英语到意大利语及普通话翻译。

但官方未将普通话列为输入语种,不支持其语音直接识别。

相关链接:

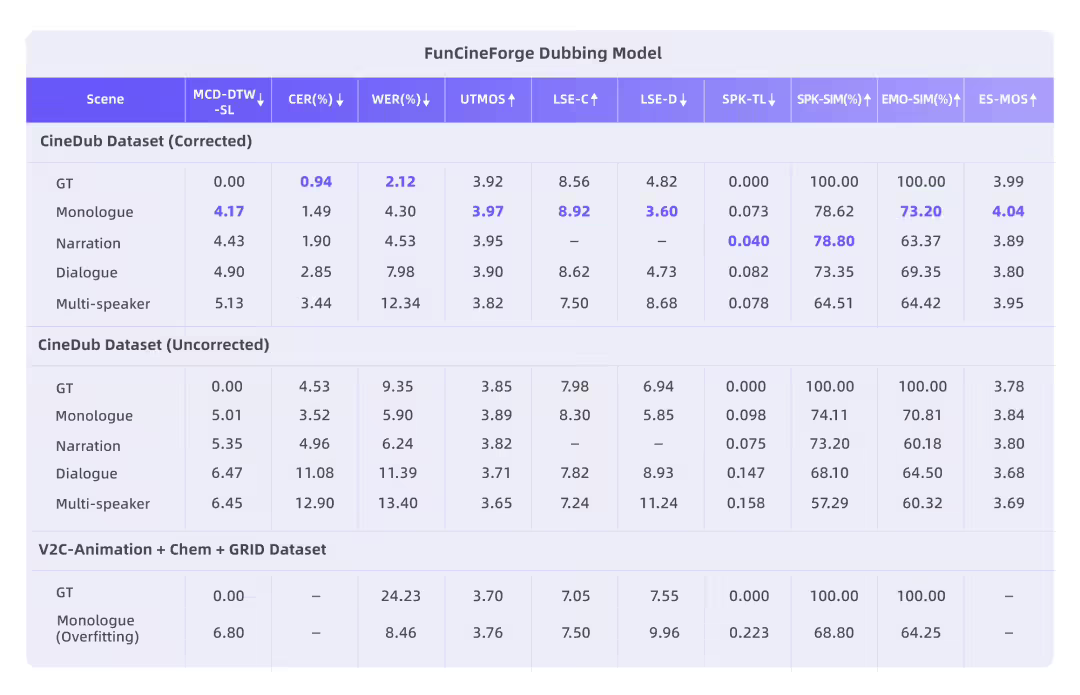

阿里通义开源 Fun-CineForge 多模态配音模型 #6

阿里通义实验室发布并开源了多模态配音模型 Fun-CineForge 及配套数据流程 CineDub。

该模型创新引入“时间模态”,有效解决了面部遮挡、镜头切换及多人对话等复杂场景下的音画同步与情感表达难题。

阿里通义实验室近日正式发布并开源了全球首个支持影视级、多场景配音的多模态大模型 Fun-CineForge,同时配套开放了高质量数据集构建流程 CineDub。

该项目采用“数据+模型”一体化设计,旨在解决传统 AI 配音在情感表达、口型同步及多人对话复杂场景中的难题。

Fun-CineForge 模型基于 CosyVoice3 底座能力构建,创新性地引入“时间模态”,结合视觉、文本和音频模态,实现了在面部遮挡、镜头切换等复杂情景下的精准音画同步与音色一致。

相关链接:

OpenAI Codex 支持 Subagent 机制实现并行任务处理 #7

OpenAI 的 Codex 工具现已支持

Subagent机制,允许用户生成专门的子 Agent 处理代码审查或调试等复杂任务。

OpenAI Codex 近期正式宣布支持 Subagent 功能,允许用户显式生成专门子 Agent 并行工作。每个 Subagent 拥有独立指令、模型设置和工具上下文,结果由 Codex 合并。

该机制适用于 PR 审查、代码库探索等可分离任务,虽因独立调用消耗更多 Token,但能通过角色隔离减少上下文漂移。

相关链接:

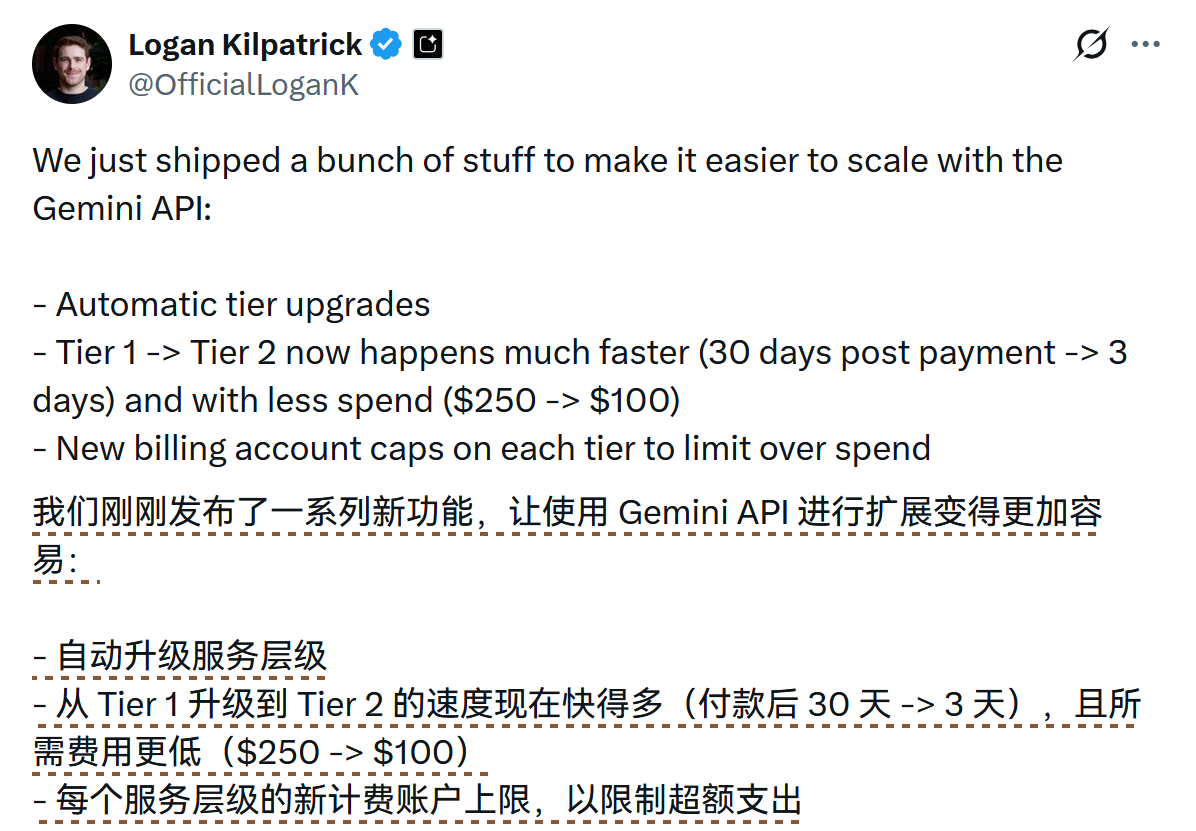

Gemini API 的 Tier 2 门槛降至 100 美元 #8

Gemini API 发布调整,从 Tier 1 升级到 Tier 2 的门槛大幅降低。等待时间从 30 天缩短至 3 天,最低消费额也从 250 美元下调至 100 美元。

Gemini API 发布更新,Tier 1 升级至 Tier 2 的等待周期从付款后的 30 天 缩短至 3 天,升级所需最低消费金额也从 250 美元下调至 100 美元。

此外,该 API 还新增 账单账户限额功能,允许在每个层级设置消费上限,帮助用户管理预算并限制潜在过度支出。

相关链接:

智谱向部分 Pro 用户优先开放 GLM-5-Turbo #9

智谱计划在 3月底前 向所有 Pro 用户逐步开放

GLM-5-Turbo模型。全量开放前,将通过问卷优先为部分 Pro 用户提前开放权限,首批名额采取“先到先得”机制。

智谱宣布本月内逐步向 Pro 用户开放 glm-5-turbo 模型,最晚不迟于 3 月底。因资源有限,全量开放前首批名额采取“先到先得”申请制,提交账号 ID 后 1 个工作日内开通,满额后转为 Waiting List。

官方称该模型定位为局部旗舰,对标 Claude Opus。

计费方面,高峰期(14:00-18:00 UTC+8)消耗 3 倍额度,非高峰期 2 倍;非高峰 1 倍抵扣福利持续至 4 月底。

用户需在 Coding Agent 配置中手动修改模型为 glm-5-turbo 调用。

相关链接:

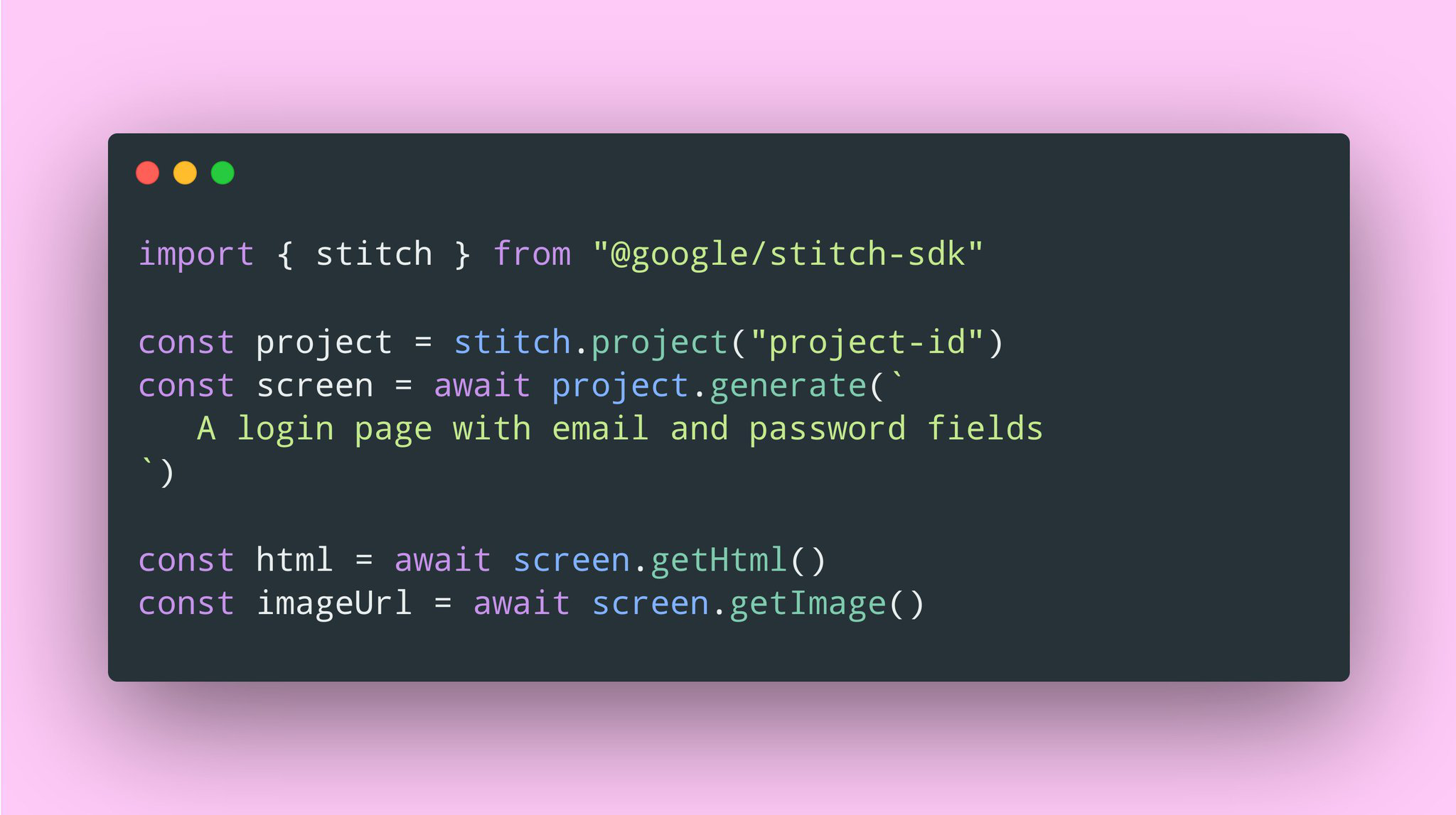

Stitch 团队发布 TypeScript SDK #10

Stitch 团队正式发布了官方 TypeScript SDK,旨在帮助开发者和 AI Agent 通过代码驱动 UI 设计。

Stitch 团队发布官方 TypeScript SDK @google/stitch-sdk,旨在辅助开发者及 AI Agent 通过代码驱动 UI 设计。

该 SDK 兼容 Node.js 和 Bun 环境,支持通过文本提示生成移动端及 Web 界面,并能提取 HTML 代码与截图。

相关链接:

Manus 推出“My Computer”,支持 macOS 与 Windows #11

Manus 发布桌面应用程序并上线

My Computer功能,现已支持 macOS 和 Windows 系统,允许 AI Agent 通过命令行直接操作本地文件、应用程序及开发环境。

Manus(属 Meta)推出桌面应用及核心功能“我的电脑”,面向 macOS 和 Windows 用户开放。该功能将 AI 能力从云端沙盒延伸至本地,支持命令行操作本地文件、工具及应用。

官方博客显示,其可利用闲置 GPU 训练模型或推理,并允许通过移动设备远程分配任务。其能与云端连接器结合,实现跨端自动化工作流。

此外,官方强调每一终端命令执行前均需用户明确批准,确保拥有完全控制权。授权文件夹即可体验。

相关链接:

Perplexity Computer 功能登陆安卓,实现跨设备同步 #12

Perplexity 宣布 "

Computer" 功能正式登陆 Android 平台,实现了对主流移动操作系统的全覆盖。

Perplexity 官方宣布,其 "Computer" 功能现已正式登陆 Android 平台。

此前,该功能已在 iOS 端的 Perplexity 应用中上线。随着 Android 版本的推出,该服务已实现对主流移动操作系统的覆盖,并支持跨设备同步。

相关链接:

MuleRun 发布 2.0,首创四层架构实现自我进化 #13

MuleRun 团队发布了

MuleRun 2.0。 官方称该产品具有 0 门槛、高安全稳定性及自进化能力,提供 7×24 小时在线服务。

MuleRun 团队发布可自我进化的个人助手 MuleRun 2.0。

该产品首创“基座 Agent、Knowledge、Skills、Runtime”四层架构,为每位用户分配 7×24 小时独立云端虚拟机。

官方称其具备情境感知、主动预判及群体知识共享能力。

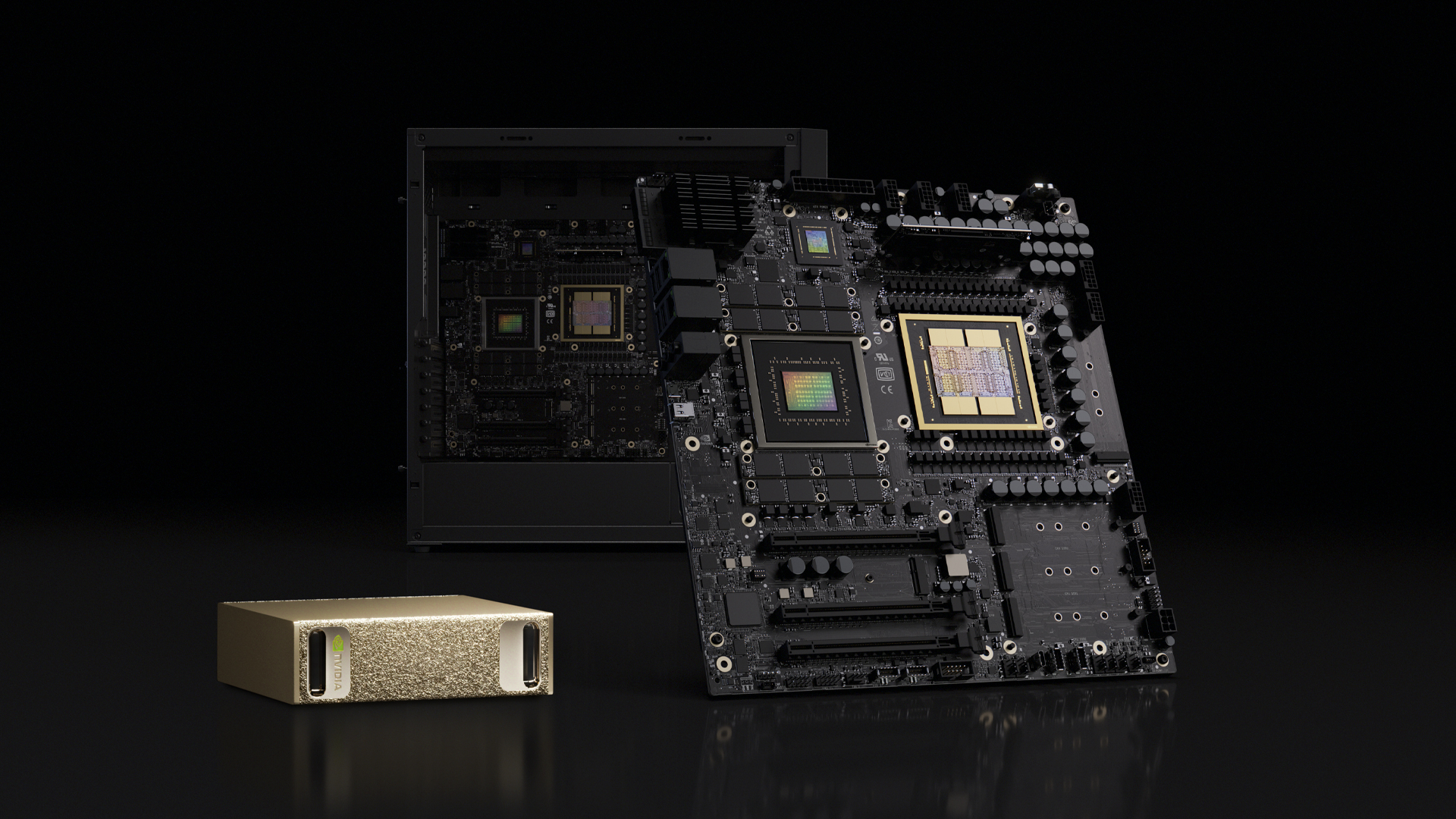

NVIDIA 开放 DGX Station 订购,GB300 芯片支持万亿大模型 #14

NVIDIA 宣布 DGX Station 现已通过特定 OEM 厂商开放订购,这款搭载

GB300芯片的桌面工作站拥有 748GB 显存和 20 Petaflops 算力,能支持本地运行万亿参数规模的模型。

NVIDIA 宣布 DGX Station 现已通过特定 OEM 厂商开放订购。该工作站搭载 GB300 Grace Blackwell Ultra Desktop Superchip,旨在将数据中心级 AI 性能引入桌面端。

该设备配备 748GB Coherent Memory,官方称可提供最高 20 Petaflops 的 AI 计算性能,支持运行参数规模高达 1 万亿 的大型开放模型。

相关链接:

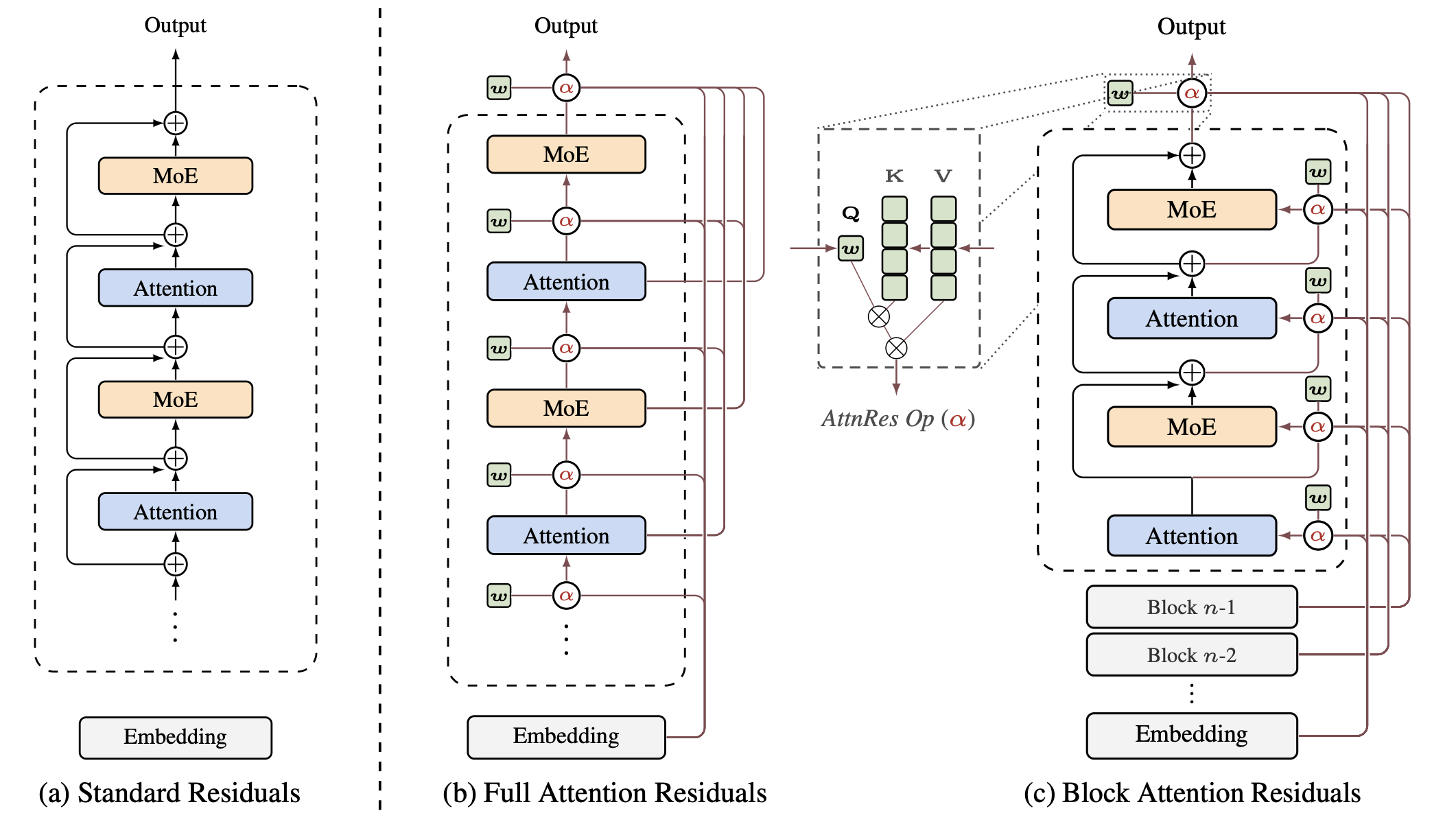

月之暗面发布 AttnRes 技术,优化 Transformer 残差连接效率 #15

月之暗面团队发布了替代Transformer标准残差连接的 Attention Residuals 机制,通过引入基于深度的学习型注意力,有效解决了深层网络表征稀释及状态无限增长问题。

月之暗面公布了一项名为 Attention Residuals(AttnRes) 的全新研究成果,这是一种旨在替代 Transformer 中标准残差连接的创新机制。受时间与深度二元性的启发,该机制用基于学习和输入的 softmax 注意力取代了传统的固定累加方式,允许网络选择性地检索过去的表示,从而有效缓解 PreNorm 带来的稀释和隐藏状态无界增长问题。

为应对规模化时的内存挑战,其团队推出了 Block AttnRes 变体,将层划分为多个块,把内存复杂度从 O(Ld) 降至 O(Nd),并在带来低于 2% 推理延迟开销的情况下展现出 1.25倍 的计算优势。

根据官方数据,该架构已在 48B 总参数、3B 激活参数的 Kimi Linear 上完成验证,并在多项基准测试中取得全面提升。相关代码与论文已开源。

相关链接:

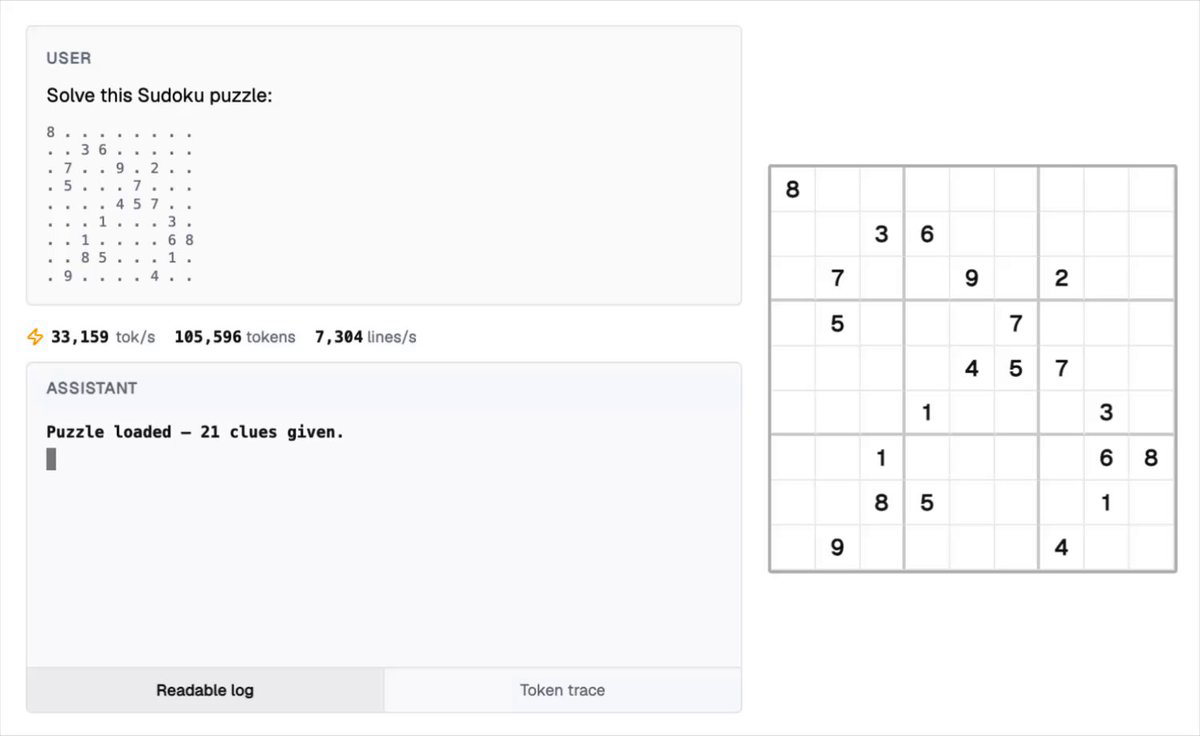

Percepta 团队构建 Transformer 内置计算机,实现百万步精确计算 #16

Percepta 团队通过将

WebAssembly解释器逻辑直接嵌入Transformer权重,成功让大语言模型在无需外部工具的情况下,以 100% 的准确率自主执行数百万步精确计算。

Percepta 团队发布成果,在 Transformer 架构内构建计算机,使大语言模型能以 100% 准确率自主执行数百万步精确计算。其核心将 C 语言程序编译为 WebAssembly 指令集,解释器逻辑嵌入模型权重。

官方数据显示,模型 CPU 流式输出速度超 30,000 token/s。

为克服长序列瓶颈,该团队引入基于 2D 维度注意力头的解码路径,将注意力查找复杂度从 O(t) 降至 O(log t)。

实验证明,系统无需外部工具即可解决包括“世界最难”Arto Inkala 数独在内的复杂任务。

未来,该团队计划将算法逻辑直接写入权重,实现学习表征与确定性算法深度融合。

相关链接:

Workshop Labs 发布 Silo 私有技术栈,提供硬件级隐私保障 #17

Workshop Labs 发布了名为 Silo 的私有后训练和推理技术栈,利用硬件级保障确保即便是服务商也无法查看用户数据,解决了 AI 使用的隐私痛点。

Workshop Labs 正式发布了名为 Silo 的私有后训练和推理技术栈,旨在改变 AI 领域“让服务商查看所有数据”作为使用门槛的现状。

作为首个针对前沿模型的私有化解决方案,Silo 提供硬件级保障,确保即便是 Workshop Labs 自身也无法查看用户数据。

目前该产品已处于早期访问阶段。

相关链接:

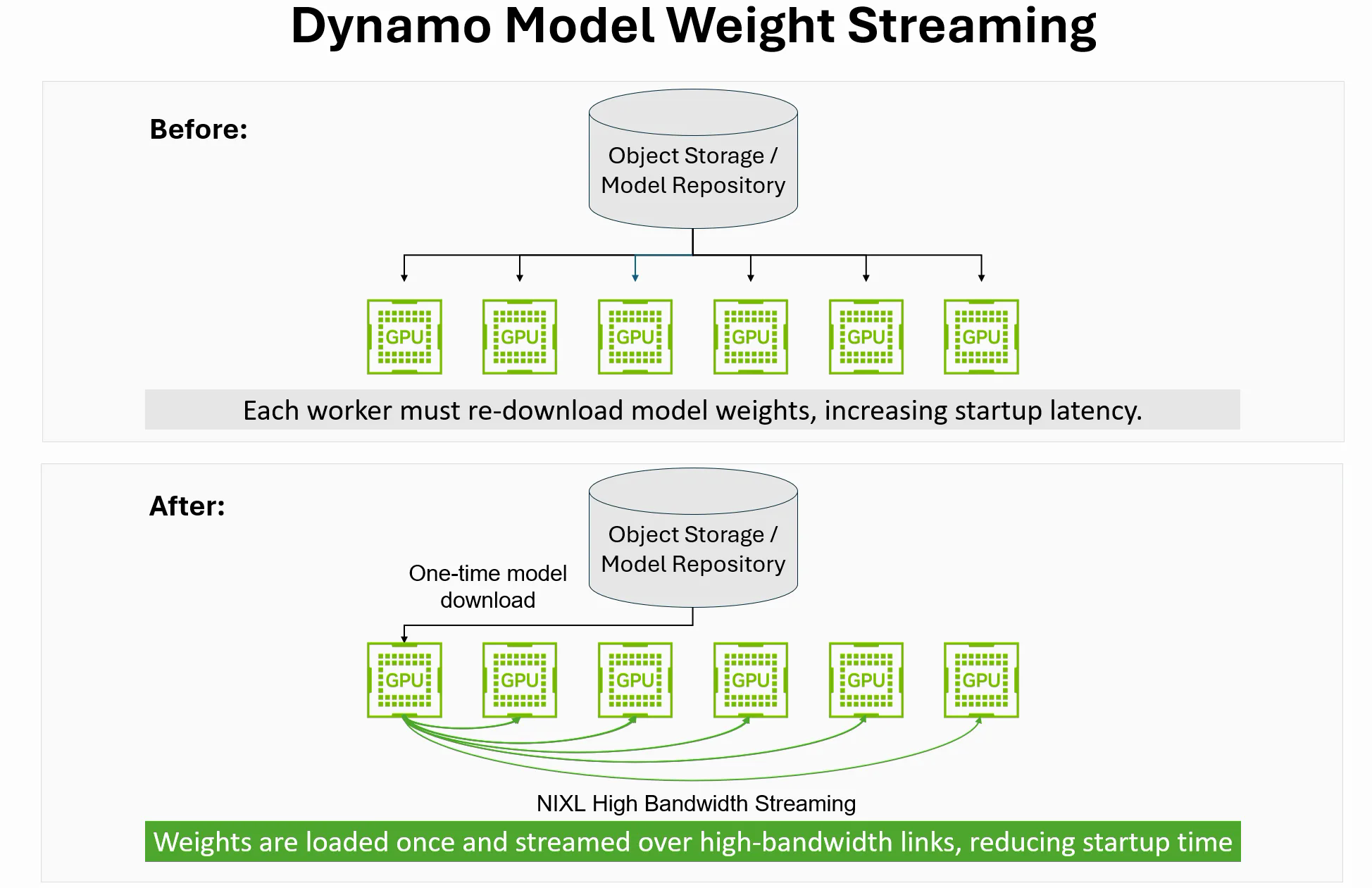

英伟达发布 Dynamo 1.0 推理框架,吞吐量最高提升 7 倍 #18

NVIDIA 正式发布了生产级分布式推理框架 NVIDIA Dynamo 1.0,旨在为大规模多节点 AI 部署提供低延迟、高吞吐量的推理服务。

NVIDIA 正式发布生产级分布式推理框架 Dynamo 1.0,旨在为大规模多节点 AI 部署提供低延迟、高吞吐量服务。该框架支持 SGLang 等主流引擎,据官方博客显示,其在 Blackwell 硬件上实现最高 7 倍吞吐量提升。

Dynamo 1.0 引入 Agentic 推理优化及多模态视频生成支持,ModelExpress 功能将模型加载速度提升 7 倍。此外,该版本增强了 Kubernetes 编排能力。

目前,其已被字节跳动、腾讯云及 AWS 等云服务商广泛集成,用于加速生成式 AI 在生产环境中的落地。

相关链接:

- https://developer.nvidia.com/blog/nvidia-dynamo-1-production-ready/

- https://github.com/ai-dynamo/dynamo

清华 MAIC 项目开源 OpenMAIC 多 Agent 交互课堂 #19

清华大学 MAIC 项目正式开源了多 Agent 交互式课堂平台 OpenMAIC,它能利用

LangGraph技术将任意文档转化为包含 AI 教师和学伴的沉浸式课堂,并支持测验、仿真及项目式学习。

清华大学 MAIC 项目近日开源 OpenMAIC 多 Agent 互动课堂平台。利用 Multi-Agent 编排技术,其将话题或文档转化为含 AI 教师与学伴的课堂,支持语音旁白、测验及项目式学习。

该平台基于 LangGraph 构建交互逻辑,通过 Plan Agent 转化 PDF 流程,兼容多种模型,官方推荐使用 Gemini 3 Flash。其集成 OpenClaw,支持通过飞书等软件生成课堂。

项目已在 GitHub 上线,支持 Docker 部署。

相关链接:

英伟达发布 Vera Rubin 平台,整合七款芯片开启 Agentic AI #20

NVIDIA 正式推出面向 Agentic AI 时代的 Vera Rubin 平台,该平台整合了 Vera CPU、Rubin GPU 及全新的

Groq 3 LPU,旨在通过NVLink 6连接构建巨型 AI 超级计算机。

NVIDIA 正式推出 Vera Rubin 平台,整合 Vera CPU、Rubin GPU 等七款芯片,旨在开启 Agentic AI 前沿。官方称,Vera Rubin NVL72 机架训练大型混合专家模型所需 GPU 仅为 Blackwell 平台的四分之一,每瓦推理吞吐量提升高达 10 倍,Token 成本降至十分之一。

Vera CPU 拥有 88 个定制核心,效率为传统 CPU 两倍。

CEO 黄仁勋 表示,到 2027 年相关芯片订单价值有望达到至少 1 万亿美元。产品预计今年下半年由 AWS、Microsoft Azure 等云服务商及 Dell 等制造商交付。

相关链接:

- https://nvidianews.nvidia.com/news/nvidia-vera-rubin-platform

- https://nvidianews.nvidia.com/news/nvidia-launches-vera-cpu-purpose-built-for-agentic-ai

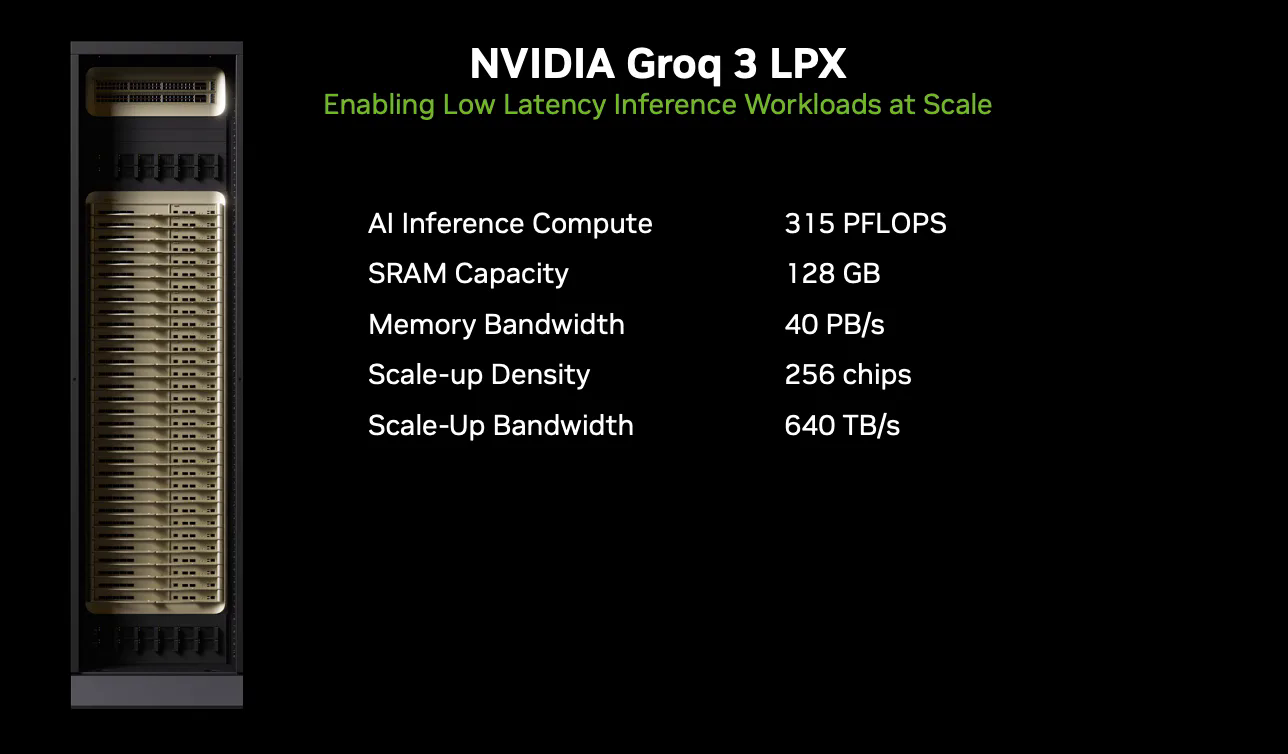

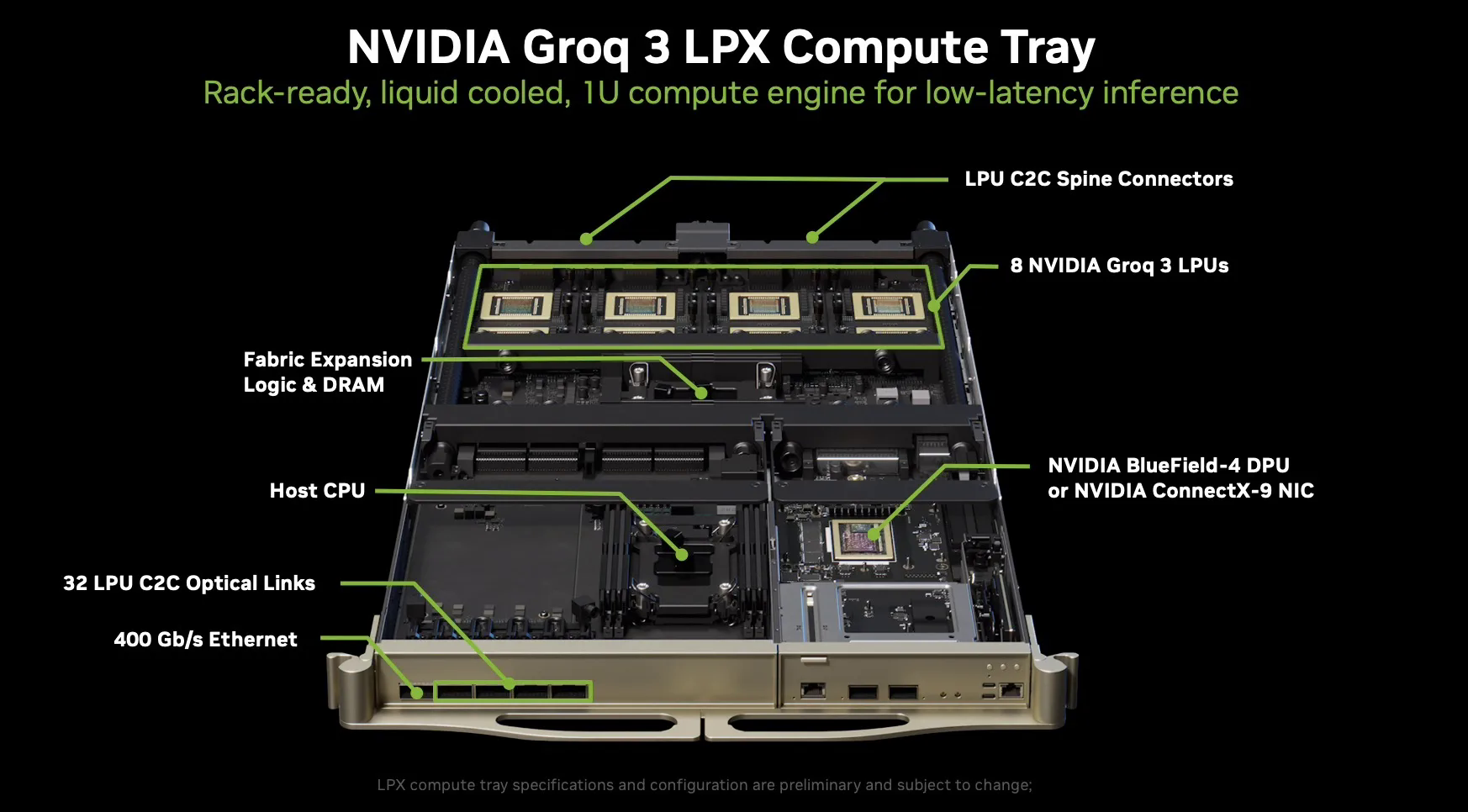

英伟达发布 Groq 3 LPX,为 Vera Rubin 平台提供推理加速 #21

NVIDIA推出了专为 Vera Rubin 平台设计的 NVIDIA Groq 3 LPX 机架级推理加速器,通过结合 Rubin GPU 与 LPU 的异构架构及 Dynamo 软件调度,旨在满足 Agentic AI 对低延迟和大上下文的需求。

NVIDIA 发布专为 Vera Rubin 平台设计的机架级推理加速器 Groq 3 LPX,旨在满足 Agentic AI 低延迟和大上下文需求。

该机架集成 256 个 LPU 加速器,提供 315 PFLOPS FP8 算力及 40 PB/s 片上 SRAM 带宽。

官方数据显示,相比 Grace Blackwell NVL72 系统,其在 400 TPS/user 水平下可实现高达 35 倍每兆瓦吞吐量提升。

据 NVIDIA 估算,该组合能为 AI 工厂带来高达 10 倍收入增长机会。

产品支持注意力 -FFN 分离技术,由 Dynamo 软件协调 GPU 与 LPU 协同,采用 MGX ETL 架构部署。

相关链接:

- https://www.nvidia.com/en-us/data-center/lpx/

- https://developer.nvidia.com/blog/inside-nvidia-groq-3-lpx-the-low-latency-inference-accelerator-for-the-nvidia-vera-rubin-platform

- https://nvidianews.nvidia.com/news/nvidia-vera-rubin-platform

英伟达发布 DLSS 5,融合生成式 AI,秋季正式推出 #22

NVIDIA 发布 DLSS 5,黄仁勋 将其称为图形学的“GPT 时刻”。

技术引入了实时神经渲染模型,为像素注入逼真的光照与材质。

DLSS 5 将于今年秋季正式推出。

NVIDIA 正式发布 DLSS 5,官方称这是自 2018 年实时光线追踪以来图形领域最重要突破。创始人黄仁勋将其比作图形学的“GPT 时刻”。

该技术引入实时神经渲染模型,融合可控 3D 结构化数据与生成式 AI,在保留艺术家控制权前提下注入逼真光照与材质。

DLSS 5 获 Bethesda、CAPCOM 等厂商支持,将于今年秋季推出,登陆《Starfield》等游戏。

黄仁勋指出,此融合范式未来有望扩展至企业计算领域。

相关链接:

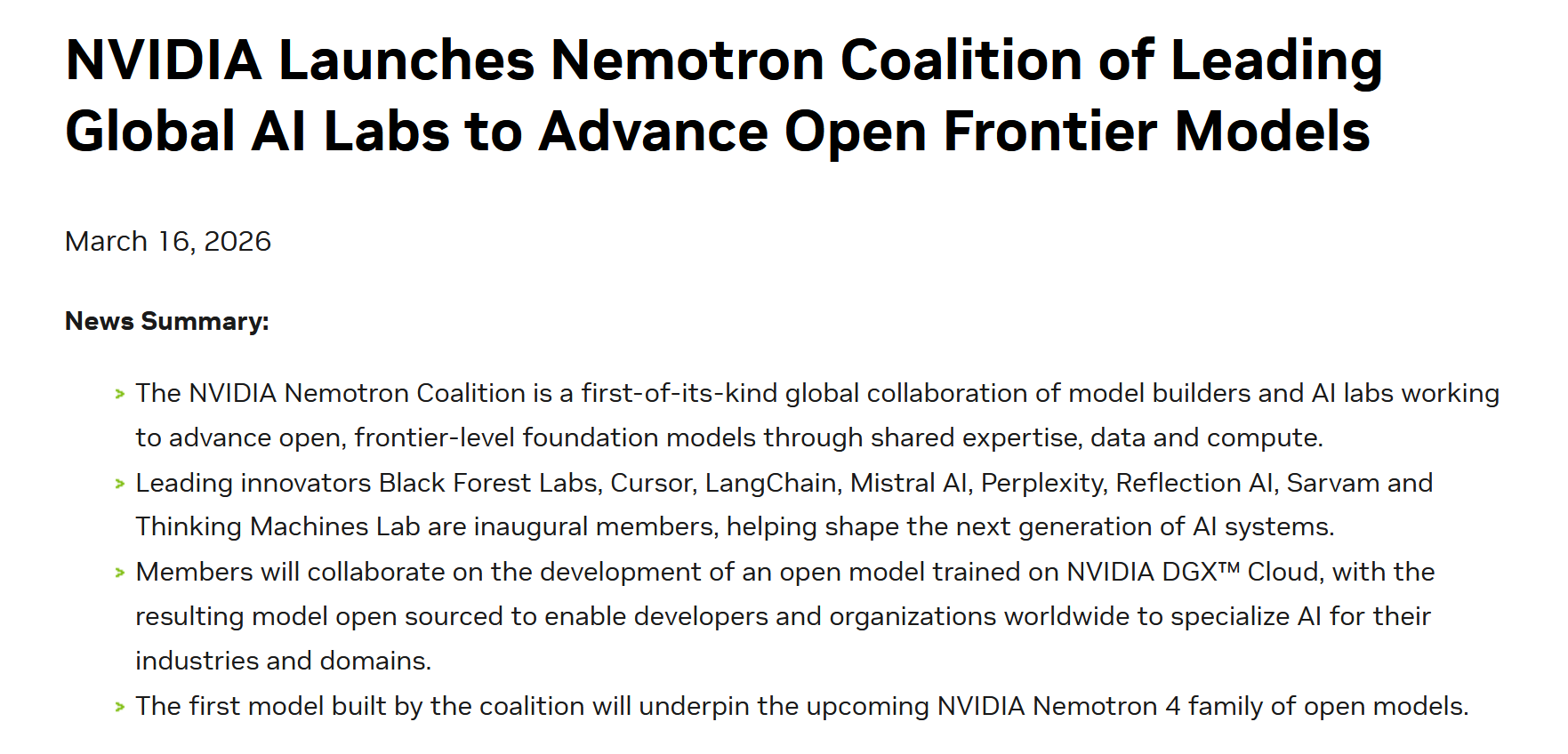

英伟达成立 Nemotron 联盟,联合 Mistral 开发开放模型 #23

英伟达宣布成立 NVIDIA Nemotron 联盟,联合 Mistral AI、Perplexity 等头部企业,通过共享数据与算力加速开放前沿模型的研发。

作为首个项目,Mistral AI 将与英伟达在

DGX Cloud上联合训练基础模型。

NVIDIA 近日宣布成立 NVIDIA Nemotron Coalition,旨在通过共享研究、数据和算力推进开放前沿模型发展。该联盟首批成员包括 Mistral AI 等八家机构。

据官方公告,联盟首个项目由 Mistral AI 与 NVIDIA 共同开发基础模型,将在 NVIDIA DGX Cloud 上训练,成果将开源并作为即将推出的 NVIDIA Nemotron 4 系列基石。

各成员将贡献专长,如 Black Forest Labs 提供多模态能力。

NVIDIA 首席执行官黄仁勋表示,该联盟将联合实验室开发开放模型。通过建立共享基础,联盟旨在减少重复工作,使组织能更高效构建适合特定需求的 AI 系统。

相关链接:

- https://nvidianews.nvidia.com/news/nvidia-launches-nemotron-coalition-of-leading-global-ai-labs-to-advance-open-frontier-models

- https://mistral.ai/news/mistral-ai-and-nvidia-partner-to-accelerate-open-frontier-models

- https://www.perplexity.ai/hub/blog/perplexity-joins-the-nvidia-nemotron-coalition

Nebius 与 Meta 签署 AI 基础设施协议,价值达 270 亿美元 #24

Nebius宣布与Meta签署了一项总价值最高达 270亿美元 的五年期AI基础设施供应协议。

Nebius Group 宣布与 Meta 签署长期 AI 基础设施供应协议。根据该五年期协议,该公司将提供价值 120 亿美元 的专用容量,基于 NVIDIA Vera Rubin 平台,预计明年年初启动交付。

Meta 承诺未来五年内,从 Nebius 特定集群中购买总额高达 150 亿美元 的额外计算容量。该公司计划优先将此部分容量出售给第三方客户,剩余再由 Meta 购买。

协议合同总价值最高可达约 270 亿美元。

相关链接:

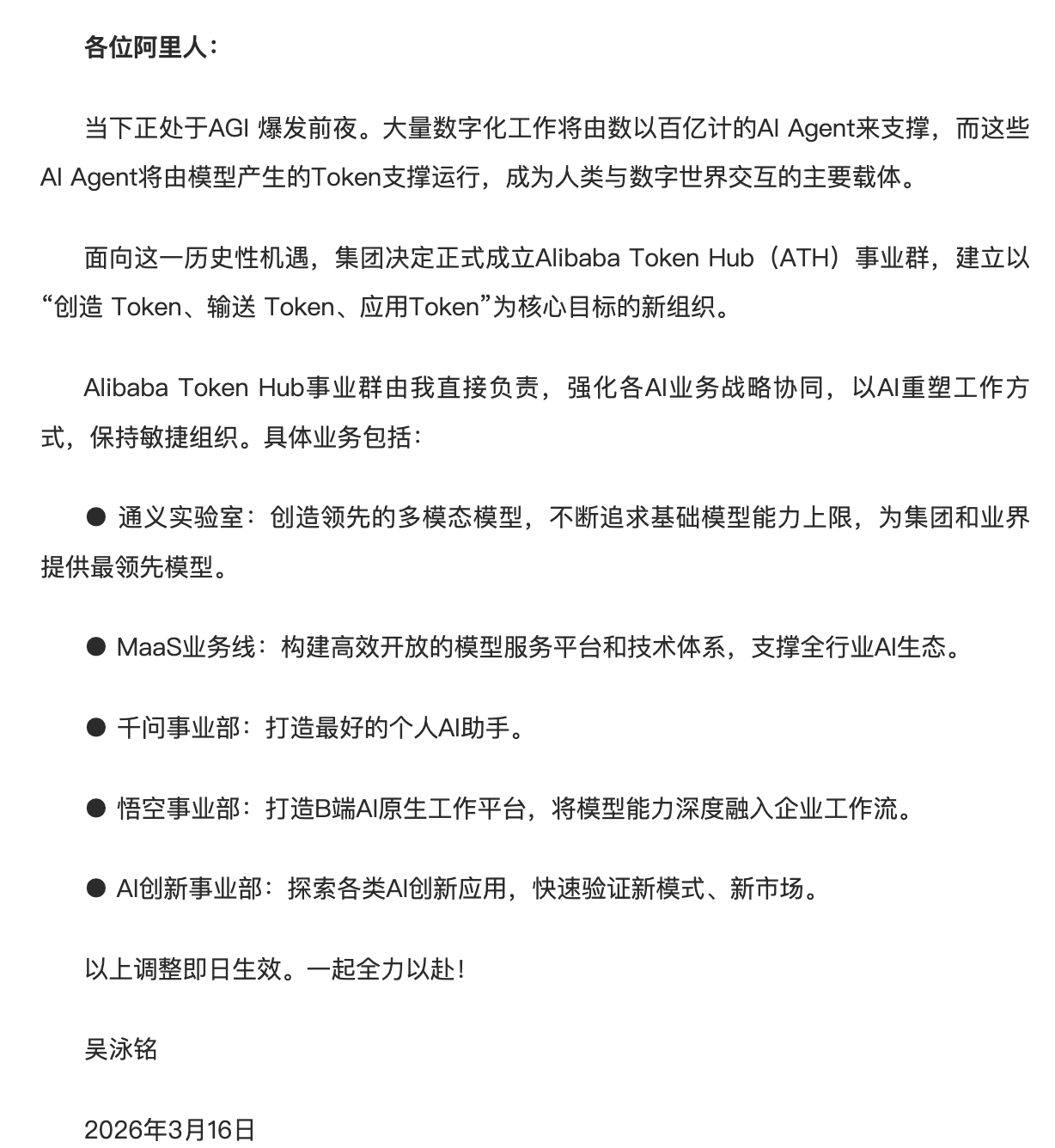

阿里巴巴成立 Token Hub 事业群,吴泳铭整合 AI 资源 #25

据报道,阿里巴巴成立 Alibaba Token Hub 事业群,确立了“创造、输送、应用Token”的主线,整合 通义实验室、千问 及首次亮相的B端 “悟空事业部” 等五大板块。

据媒体报道,阿里巴巴近期成立 Alibaba Token Hub(ATH) 事业群,由 CEO 吴泳铭 直接负责。该事业群旨在通过“创造、输送、应用 Token”整合 AI 资源,应对 AI Agent 时代挑战。

其架构囊括 通义实验室、MaaS 业务线、千问事业部、AI 创新事业部 及首次亮相的 悟空事业部。

OpenAI 传拟与私募组建百亿美元估值合资企业 #26

据报道,OpenAI正与TPG及贝恩资本等私募巨头深入谈判,拟组建一家投前估值100亿美元的合资企业,专门向这些机构旗下的投资组合公司推广企业级产品。OpenAI高管证实正在筹建专门的“部署部门”以加速企业落地。

据路透社援引知情人士消息报道,OpenAI 正与 TPG、Advent International、Bain Capital 及 Brookfield Asset Management 等私募股权公司进行深入谈判,拟组建一家投前估值约为 100 亿美元 的合资企业,旨在向这些机构旗下的投资组合公司推广 OpenAI 的企业级产品。

对此,OpenAI 应用程序 CEO Fidji Simo 证实公司正在构建一个专门的“部署部门”,并透露目前已有超过 100 万 家企业使用其产品。

相关链接:

- https://x.com/fidjissimo/status/2033537381907710092

- https://www.reuters.com/business/openai-courts-private-equity-join-enterprise-ai-venture-sources-say-2026-03-16/

OpenAI 无限期推迟 ChatGPT 成人模式发布 #27

据报道,OpenAI 已无限期推迟 ChatGPT “成人模式”的发布。由于年龄检测系统存在约 12% 的误判率,加之顾问委员会警告会引发情感依赖风险,该公司决定优先聚焦其他产品。

据《华尔街日报》报道,OpenAI 已无限期推迟 ChatGPT "Adult Mode" 发布,尽管确认该功能仍在规划中。

此前,其健康咨询委员会一致反对,警告 AI 生成色情内容可能引发不健康情感依赖。

技术层面,该公司年龄检测系统存在约 12% 误判率。鉴于 ChatGPT 每周约有 1 亿 未成年用户,这一漏洞可能导致数百万青少年接触成人内容。

相关链接:

- https://x.com/sama/status/1978129344598827128

- https://www.wsj.com/tech/ai/openai-adult-mode-chatgpt-f9e5fc1a

- https://the-decoder.com/openais-own-wellbeing-advisors-warned-against-erotic-mode-called-it-a-sexy-suicide-coach/

英伟达推出 NemoClaw 企业级开源 AI Agent 平台 #28

英伟达在 GTC 大会上发布了企业级开源 AI Agent 平台 NemoClaw,该平台基于

OpenClaw框架构建,通过内置安全与隐私控制解决了企业部署 Agent 的核心痛点。

Nvidia 近日宣布推出企业级开源 AI Agent 平台 NemoClaw。该平台基于 OpenClaw 框架构建,主打企业级安全与隐私控制。

据官方介绍,其支持单条命令本地部署 AI 助手,兼容各类编程 Agent 及开放模型。该平台集成 OpenShell 与 NeMo 套件,具有硬件无关性,无需强制依赖 Nvidia GPU。

目前,该平台以早期 Alpha 形式通过 Nvidia Brev Launchable 体验。官方称正朝生产级沙箱编排构建。

相关链接:

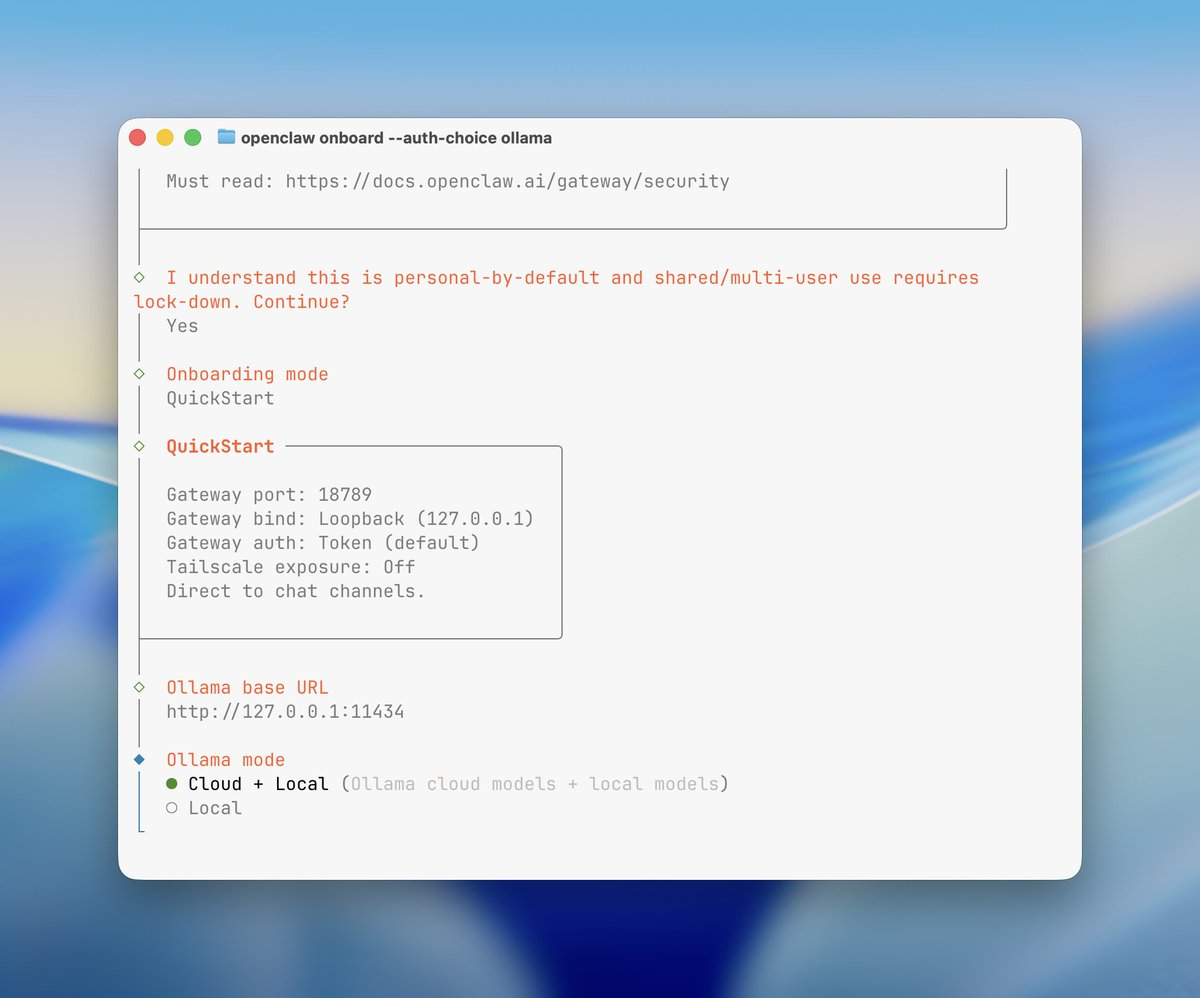

Ollama 成为 OpenClaw 官方 Provider #29

Ollama 宣布已成为 OpenClaw 的官方提供商,用户现可通过执行相关命令将本地或云端模型接入 OpenClaw。

Ollama 宣布成为 OpenClaw 的官方 Provider。用户可通过 openclaw onboard --auth-choice ollama,将 Ollama 支持的本地或云端模型接入 OpenClaw 平台,实现无缝协作。

相关链接:

阅文集团旗下作家助手开启 AI 智能体 Claw 内测 #30

阅文集团旗下“作家助手”宣布 WriteClaw 正式开启内测,旨在打造集编辑与运营职能于一身的“超级助理”,进一步降低网文创作与运营门槛。

阅文集团旗下“作家助手”近日宣布,内置的“作家助手 Claw”开启内测。用户可一键领养专属 AI 智能体,首批技能涵盖热梗素材收集、三江推荐鉴赏及情节评论分析。

官方表示,未来将上线同类作品检索、读者偏好分析及生成配图等功能,旨在打造集编辑、运营于一身的超级助理。

该产品已打通 QQ 对话能力,数据存于本地以确保安全。

相关链接:

元宝 App 支持接入 OpenClaw,实现多人共养 #31

元宝App宣布“元宝派”功能正式支持接入

OpenClaw,开启了多人共养智能体的“龙虾社交”模式。

元宝 App 官方宣布,其社交功能“元宝派”正式支持接入 OpenClaw,开启多人共养模式。用户需将客户端更新至 v2.60.10 及以上版本,通过“我的 Bot”关联已部署实例,支持扫码绑定 腾讯云 Lighthouse 云端服务。

在群组中,成员可长按头像 @Agent 进行协同。官方预告,无需配置环境的“一键创建”免费领养功能即将上线。

相关链接:

提示:内容由AI辅助创作,可能存在幻觉和错误。