2026-04-10

AI 早报 2026-04-10

概览

要闻

- OpenAI 推出 ChatGPT 100 美元 Pro 档 ↗

#1

模型发布

- 字节跳动发布原生全双工语音模型 Seeduplex,豆包可用 ↗

#2 - Overworld 发布实时扩散世界模型 Waypoint-1.5 ↗

#3 - LG AI Research 发布 EXAONE 4.5 开源视觉语言模型 ↗

#4 - 阿里AIDC-AI开源两款 Marco-MoE 稀疏大模型 ↗

#5

开发生态

- Claude API 上线 Advisor 策略,平衡智能成本性能提升 ↗

#6 - Claude Code 升级配置向导,引入监控工具 ↗

#7 - Codex 官方上线 Build macOS Apps 插件 ↗

#8 - Codex 宣布将再次重置使用额度 ↗

#9 - OpenClaw 发布 2026.4.9,重构记忆系统与安全机制 ↗

#10 - MiniMax 发布 MMX-CLI 命令行工具 ↗

#11

产品应用

- Google 宣布 Gemini 支持生成交互式可视化及 3D 模型 ↗

#12 - Gemini 为免费用户开放使用 Lyria 3 生成完整歌曲功能 ↗

#13 - Claude Cowork 结束预览,全面开放并上线企业管控功能 ↗

#14

技术与洞察

- 通义实验室开源 VimRAG,支持图文视频混合知识库检索 ↗

#15

行业动态

- 腾讯云上调 AI 算力等产品刊例价 5% 下月起生效 ↗

#16 - Intel 与 Google 达成合作推进 AI 云基础设施与 IPU 开发 ↗

#17 - Meta 与 CoreWeave 签 210 亿美元协议强化 AI 算力部署 ↗

#18

前瞻与传闻

- Nebius 传正在洽谈收购 AI21 Labs

#19

OpenAI 推出 ChatGPT 100 美元 Pro 档 #1

OpenAI 宣布推出每月 100美元 的全新 Pro 档位。该层级提供 5倍 Plus 的

Codex使用量,并在 6月 前开展促销,提供 10倍 用量。同时,重新平衡 Plus 订阅的

Codex使用量,旨在支持用户在整周内分布任务而非单日集中使用。

OpenAI 官方宣布正式推出全新的每月 100 美元 的 Pro 档位。该新层级提供相较 Plus 高达 5 倍 的 Codex 使用量。

同时,这一全新的 Pro 档位保留了所有现有的 Pro 功能,包括独享的 Pro 模型以及对 Instant 和 Thinking 模型的无限访问权限。

为庆祝发布,官方将在 6 月前 提升 Codex 使用量,使 100 美元 Pro 订阅用户能够获得最高达 ChatGPT Plus 10 倍 的使用额度。

与此同时,作为调整的一部分,OpenAI 重新平衡了 Plus 计划中的 Codex 使用量,旨在支持用户在整周内进行更多任务,而非在单日内进行长时间任务。

相关链接:

字节跳动发布原生全双工语音模型 Seeduplex,豆包可用 #2

字节跳动 Seed 团队正式发布了原生全双工语音大模型 Seeduplex。该模型基于自研大语言模型底座实现原生端到端建模,在复杂声学场景下将误回复率和误打断率减少一半。

更新 豆包 App 至最新版本,选择“打电话”功能即可体验该模型。

字节跳动 Seed 团队正式发布了原生全双工语音大模型 Seeduplex。该模型基于“边听边说”的全新框架设计,通过自研大语言模型底座实现原生端到端建模。

相比上一代半双工方案,Seeduplex 重点实现了精准抗干扰与动态判停两大突破,在复杂声学干扰场景下将其误回复率和误打断率减少了一半,抢话比例相对下降了 40%。

根据官方公布的评测数据,该模型在判停延迟降低约 250ms 的同时,判停 MOS 分提高了 8%,对话流畅度 MOS 分提升了 12%,并在大规模 A/B 测试中使整体通话满意度绝对值提升了 8.34%。

用户只需将 豆包 App 更新至最新版本,在对话框内选择“打电话”功能即可体验该产品带来的高自然度实时语音交互。

相关链接:

- https://seed.bytedance.com/zh/seeduplex

- https://seed.bytedance.com/zh/blog/introducing-seed-full-duplex-speech-llm-attentive-listening-robust-interference-suppression-enabling-more-natural-interaction

- https://mp.weixin.qq.com/s/ymyF-nBO-VT7ehnGO255qg

Overworld 发布实时扩散世界模型 Waypoint-1.5 #3

Overworld 发布了其新版 Waypoint 实时扩散世界模型。官方称该版本训练数据量增至前代近 100 倍,采用双层级架构,能在最低 NVIDIA RTX 3070 显卡上实现最高 720p 分辨率与 60 帧每秒的实时环境生成。

Overworld 近日正式发布了其实时扩散世界模型的最新版本 Waypoint-1.5。该版本旨在解决初代系统在视觉保真度和硬件兼容性方面的局限,通过引入近 100 倍于前代的训练数据以及更高效的视频建模技术,实现了最高 720p 分辨率与 60 帧每秒的实时环境生成。

为适应广泛的消费级硬件,该模型推出了 720p 与 360p 双层级架构,本地运行的最低显卡要求设定为 NVIDIA RTX 3070,并计划在未来支持 Apple Silicon Mac 平台。

目前,用户可通过其开源的桌面客户端 Biome 在本地进行快速部署体验,或通过 Overworld.stream 网页端实现免配置的即时游玩。

相关链接:

LG AI Research 发布 EXAONE 4.5 开源视觉语言模型 #4

LG AI Research 发布开源视觉语言模型

EXAONE 4.5,该模型共 330 亿 参数,在文档理解与韩语推理方面超越了同级别的模型。

LG AI Research 发布了其首个开源视觉语言模型 EXAONE 4.5。该模型在现有的 EXAONE 4.0 框架中集成了专用的视觉编码器,总参数量为 330 亿(其中视觉编码器约 12.9 亿,语言模型 317 亿)。

官方称,EXAONE 4.5 在通用基准测试中表现强劲,并在文档理解和韩语上下文推理方面超越了同等规模的 SOTA 模型。

该模型支持最大 262,144 tokens 的上下文长度,知识截止至 2024 年 12 月。

相关链接:

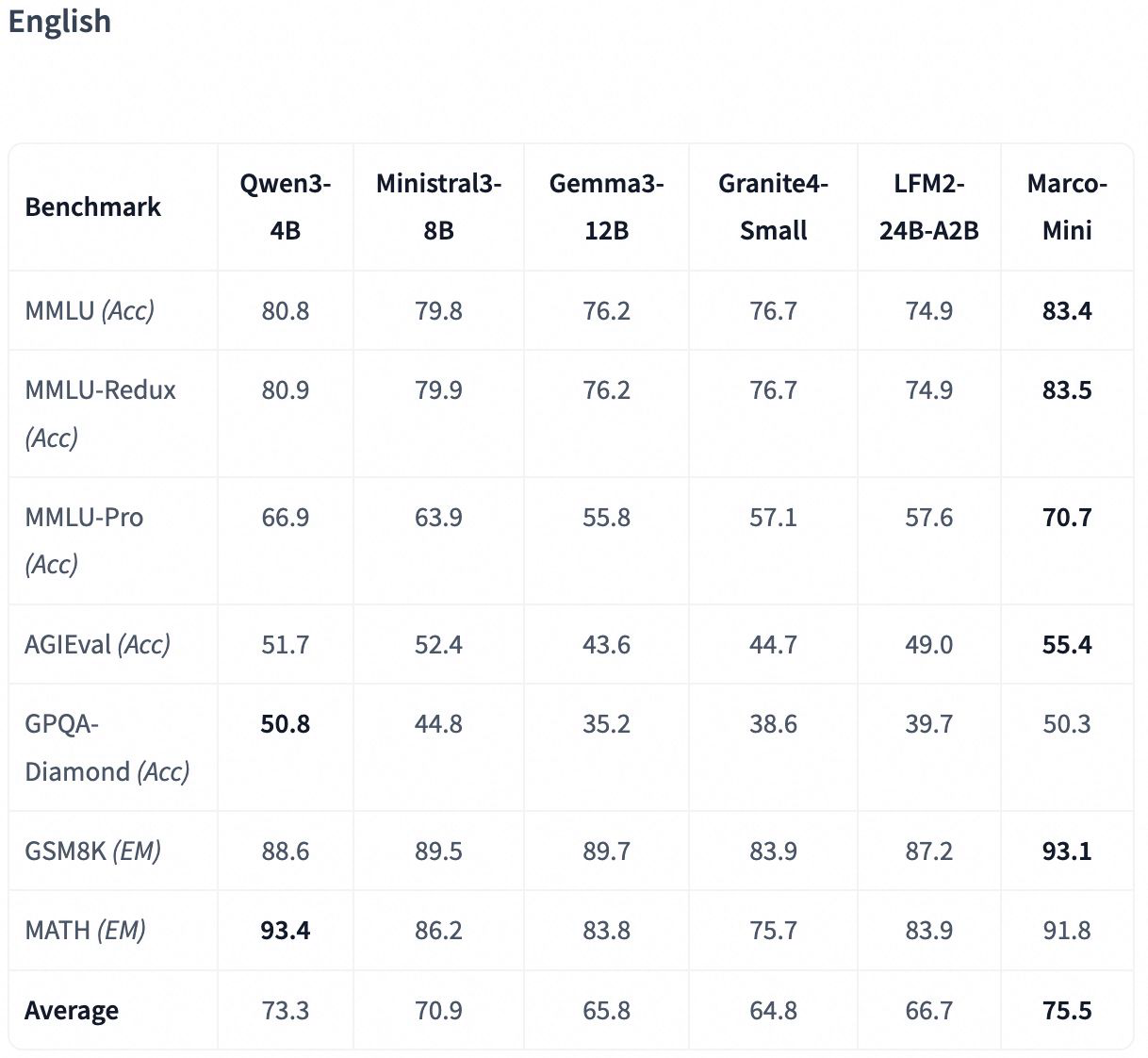

阿里AIDC-AI开源两款 Marco-MoE 稀疏大模型 #5

阿里 AIDC-AI 团队开源了 Marco 系列两款稀疏多语言大模型,分别是总参数 173 亿、激活参数 8.6 亿的

Marco-Mini-Instruct和总参数 80 亿、激活参数 6 亿的Marco-Nano-Instruct。

Alibaba International Digital Commerce 近日推出了两款属于 Marco-MoE 家族的新型高度稀疏多语言大语言模型:Marco-Mini-Instruct 与 Marco-Nano-Instruct。

这两款模型均采用 Decoder-only Transformer 架构,并利用 Drop-Upcycling 技术从 Qwen3-0.6B-Base 升级改造而来,以极低的激活参数量实现了高效的推理能力。

其中,Marco-Mini-Instruct 拥有 17.3B 总参数,每个 token 仅激活 0.86B 参数;而 Marco-Nano-Instruct 拥有 8B 总参数,每个 token 仅激活 0.6B 参数。

相关链接:

- https://huggingface.co/AIDC-AI/Marco-Mini-Instruct

- https://huggingface.co/AIDC-AI/Marco-Nano-Instruct

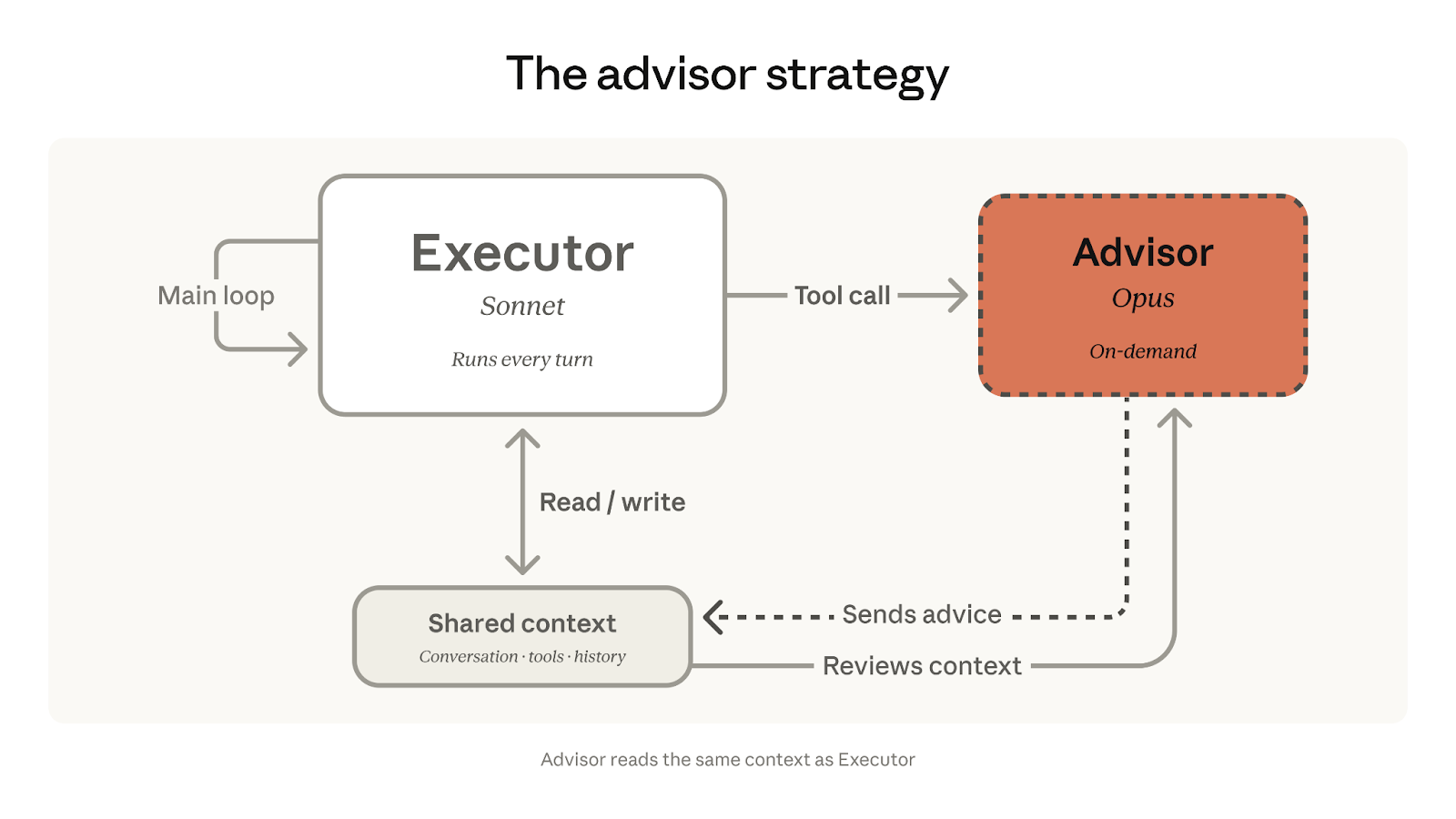

Claude API 上线 Advisor 策略,平衡智能成本性能提升 #6

Claude API 上线了 Beta 版的

advisor tool,让低成本的Sonnet或Haiku模型作为执行者处理主要任务,仅在遇到复杂决策时才向顶级Opus模型寻求顾问指导。官方数据显示,这种组合完美兼顾了业务性能与开发成本。

Anthropic 在 Claude Platform 的 API 中上线了全新的 advisor 策略及其对应的 advisor tool。该策略旨在平衡 Agent 的智能与成本,通过将 Claude Opus 作为 Advisor(顾问),与作为 Executor(执行者)的 Sonnet 或 Haiku 配对,使 Agent 在保持低成本的同时获得接近 Opus 级别的智能。

在该模式下,Executor 负责端到端执行任务、调用工具并迭代方案。当其遇到无法合理解决的复杂决策时,会通过单次 API 请求咨询 Advisor 以获取改进建议、计划或停止信号。

官方数据显示,Sonnet 配搭 Opus Advisor 在 SWE-bench Multilingual 评测中比 Sonnet 独立运行时表现提升了 2.7 个百分点。同时,由于减少了处理复杂任务时的无效 Token 消耗,单次任务成本降低了 11.9%。

目前该功能已在 Claude Platform 开启 Beta 测试,支持通过 Messages API 进行一键部署。

相关链接:

- https://claude.com/blog/the-advisor-strategy

- https://platform.claude.com/docs/en/agents-and-tools/tool-use/advisor-tool

- https://x.com/claudeai/status/2042308622181339453

Claude Code 升级配置向导,引入监控工具 #7

Claude Code 推出了 Setup Wizard 和 Monitor Tool 两项更新。

全新的

Setup Wizard实现了第三方云服务的自动化配置。同时,开发者现在可以通过调用

Monitor Tool来创建后台脚本并唤醒 Agent,从而在执行日志监控等高级任务时告别低效轮询,节省 Token 消耗。

Claude Code 推出了全新的 Setup Wizard 以及 Monitor Tool。

针对过去需手动编写配置文件和环境变量才能将 Claude Code 与 Amazon Bedrock 或 Google Vertex 搭配使用的痛点,新推出的安装向导可自动代为处理这些流程。该向导还能主动建议用户升级至其有权限访问的较新模型。

与此同时,Claude Code 还引入了 Monitor Tool。这项工具允许 Claude 创建后台脚本并在必要时唤醒 Agent,不仅避免了在 Agent 循环中进行低效轮询,还能极大节省 Token 消耗。

在实际操作中,开发者需要显式地对 Claude Code 进行提示才能调用该工具,例如指示其“启动开发服务器并使用 MonitorTool 观察错误”。

相关链接:

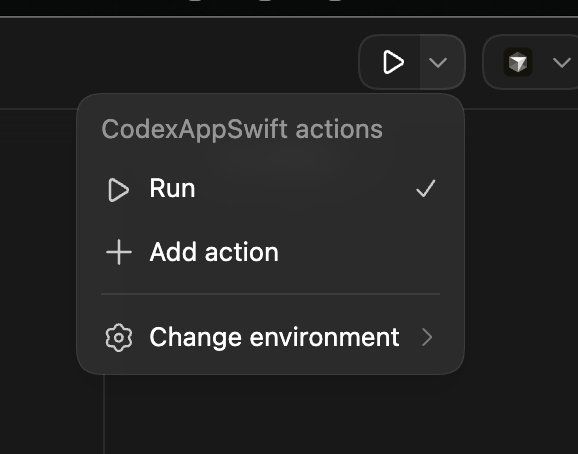

Codex 官方上线 Build macOS Apps 插件 #8

Codex官方正式上线了 Build macOS Apps 插件,为开发者提供基于

SwiftUI和AppKit的原生应用构建支持。该插件将本地构建脚本与UI运行按钮打通,让开发者无需离开界面即可一键完成应用的构建、打包与快速迭代。

Codex 官方近日上线 "Build macOS Apps" 插件,支持构建基于 SwiftUI 和 AppKit 的原生 macOS 应用。该插件赋予 Codex 对窗口行为、工具栏惯例等桌面端细节的深度理解。

其将本地构建脚本与 UI 运行按钮连接,实现构建、打包和启动闭环。

此外,插件增强 Agentic Debugging 支持,引导添加遥测与结构化日志,使 Agent 能基于实时信号修复运行期 Bug。

内置技能集涵盖 Liquid Glass 设计规范、应用签名和测试流程,确保代码符合 Apple 人机交互指南。

相关链接:

Codex 宣布将再次重置使用额度 #9

Codex 负责人于 4月9日 上午十点半发文表示,由于意识到近期的 Codex 重置与上一次重置的时间间隔刚好是一周,因此将于次日再次重置 Codex 的使用额度。

Codex 负责人 @thsottiaux 北京时间 4月9日 上午十点半表示,鉴于近期 Codex 重置与上一次(约一周前)间隔较短,时机显得不太凑巧,该用户宣布将于次日再次重置 Codex。此举旨在真正庆祝 Codex 活跃用户达到 3M 节点。

相关链接:

OpenClaw 发布 2026.4.9,重构记忆系统与安全机制 #10

OpenClaw 发布了 2026.4.9 版本。

本次更新深度重构了记忆与梦境系统,引入支持历史路径的

REM回填通道与结构化日记视图。并新增支持并行运行的评估报告,以加速开发者测试时的模型行为比对。

OpenClaw 官方正式发布了 2026.4.9 版本,这是一项涵盖多项重大功能新增、安全强化及平台体验修复的全面更新。

在核心功能方面,该版本为其记忆与梦境系统引入了带有历史路径支持的 REM 回填通道及日记提交重置流程,使旧的每日笔记能够直接重放至 Dreams 和持久记忆中。同时,同步推出了带有时间线导航和提升提示的结构化日记视图 UI。

新增了支持并行运行的 character-vibes 评估报告,以加速模型行为比对。并允许 iOS 版本显式固定 CalVer,以优化 TestFlight 发布列车工作流。

在安全性上,官方重点封堵了浏览器交互中可能绕过 SSRF 隔离的漏洞,净化了远程节点的执行事件以防止受信内容注入,并严格限制了不受信任工作区环境变量及插件对核心授权选项的非法覆盖。

相关链接:

- https://github.com/openclaw/openclaw/releases/tag/v2026.4.9

- https://x.com/openclaw/status/2042072722902077938

MiniMax 发布 MMX-CLI 命令行工具 #11

MiniMax 发布面向 AI Agent 的命令行工具 MMX-CLI,支持在任意 Agent 中原生调用 MiniMax 旗下不同模型,生成文字、图像、视频、语音和音乐。

MiniMax 发布了名为 MMX-CLI 的命令行工具,该产品专为 AI Agent 设计,旨在让 Agent 能够原生调用 MiniMax 的所有模态的模型。

MMX-CLI 集成了涵盖多回合文本对话、批量图像生成与理解、异步视频生成、多音色语音合成以及带歌词的音乐创作等七项核心能力。

针对 Agent 在非交互式环境下的运行痛点,该工具实现了纯数据输出隔离、语义化状态码返回、非阻塞与异步任务控制等底层优化。

且生成消耗可直接无缝计入用户现有的 Token Plan 配额。

目前该工具已在 GitHub 开源。

相关链接:

Google 宣布 Gemini 支持生成交互式可视化及 3D 模型 #12

Gemini 应用现已向全球用户逐步推出全新交互式可视化功能,允许直接在聊天界面生成可调整的 3D 模型与功能性模拟。

用户需选择 Pro 模型并输入特定指令或点击可视化按钮即可体验。

Google 官方宣布其 Gemini 应用推出全新功能,现已开始向全球所有用户逐步推出,允许用户直接在聊天界面中生成包含交互式图表、3D 模型和功能性模拟的可视化内容。

此项技术打破了以往仅依赖文本和静态图表的回复模式,使用户能够通过拖动滑块、输入具体数值来调整系统变量,或旋转 3D 模型,以更沉浸的方式直观探索诸如月球运行轨道等复杂概念。

用户只需在提示词栏中选择 Pro 模型并输入 show me 或 help me visualize 等指令,或在部分特定问题下方点击 Show me the visualization 按钮即可体验该功能。

相关链接:

Gemini 为免费用户开放使用 Lyria 3 生成完整歌曲功能 #13

Gemini 宣布,免费用户每天可通过工具菜单的 Create music 功能生成最多 5 首长约 3 分钟的完整歌曲。若达到每日限额,仍可继续生成 30 秒的短片。

Gemini 应用正式向免费用户开放其音乐模型 Lyria 3,免费用户每天可以生成最多五首时长约为三分钟的完整歌曲;若达到每日限额,上述用户仍可继续生成 30 秒的短片,或通过升级获取更多配额。

据官方数据显示,Gemini 音乐生成功能上线不足 50 天,其平台已累计产出超过 1 亿 首歌曲。

相关链接:

- https://x.com/Google/status/2042324699955237233

- https://x.com/GeminiApp/status/2042316630253076945

- https://x.com/joshwoodward/status/2042318148851188151

Claude Cowork 结束预览,全面开放并上线企业管控功能 #14

Anthropic 宣布 Claude Cowork 结束预览,正式向所有付费计划开放桌面端应用。针对企业版用户,该产品同步推出一系列管控功能。

Anthropic 宣布 Claude Cowork 现已在所有付费计划中全面上线,结束了为期 12 周 的研究预览阶段。该产品目前支持 macOS 和 Windows 桌面端,主要被应用于团队运营、处理任务、起草项目交付物以及保持团队信息同步。

为了满足企业级部署的治理和可见性需求,官方同步推出了针对企业版的一整套管控功能,包括基于角色的访问控制(RBAC)、团队支出限制、使用情况分析以及扩展的 OpenTelemetry 监控支持。

相关链接:

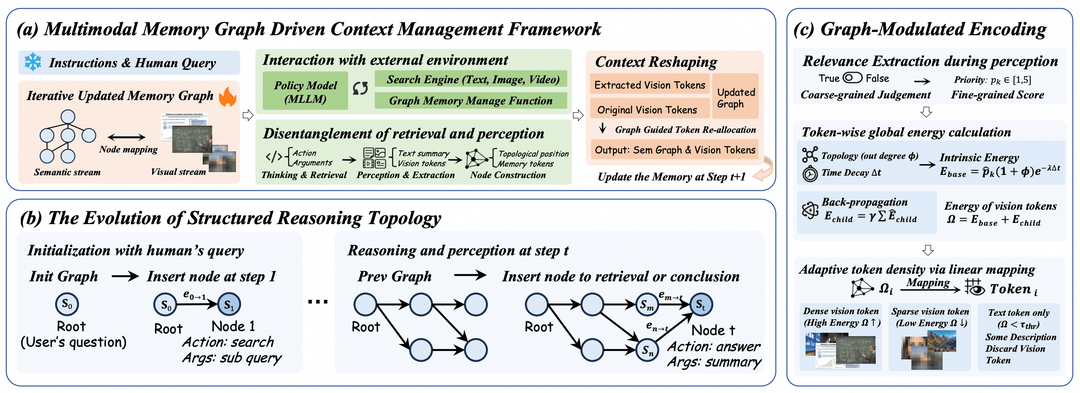

通义实验室开源 VimRAG,支持图文视频混合知识库检索 #15

通义实验室正式开源了面向文本、图像和视频混合知识库的统一RAG框架 VimRAG,该框架利用动态有向无环图替代线性拼接,配合

视觉能量分配与图引导策略优化,有效解决了多模态检索中的状态盲区与重复循环问题。

通义实验室正式开源了面向“文本+图像+视频”混合知识库的统一 RAG 框架 VimRAG。该框架通过引入动态有向无环图替代传统的线性拼接,旨在解决多模态长上下文场景下的状态盲区和重复检索问题。

其核心机制包括支持分支试错的动态记忆图、动态分配视觉 Token 的视觉能量机制,以及降低梯度方差的图引导策略优化(GGPO)。

根据官方提供的数据,在 Qwen3-VL-8B 模型上的端到端评测中,VimRAG 达到 50.1% 的平均准确率,官方称其显著优于 Mem1 和 ReAct 等基线,并在整体上提升了推理效率。

目前该框架的核心机制正逐步集成到阿里云百炼知识库中,相关项目已开源。

相关链接:

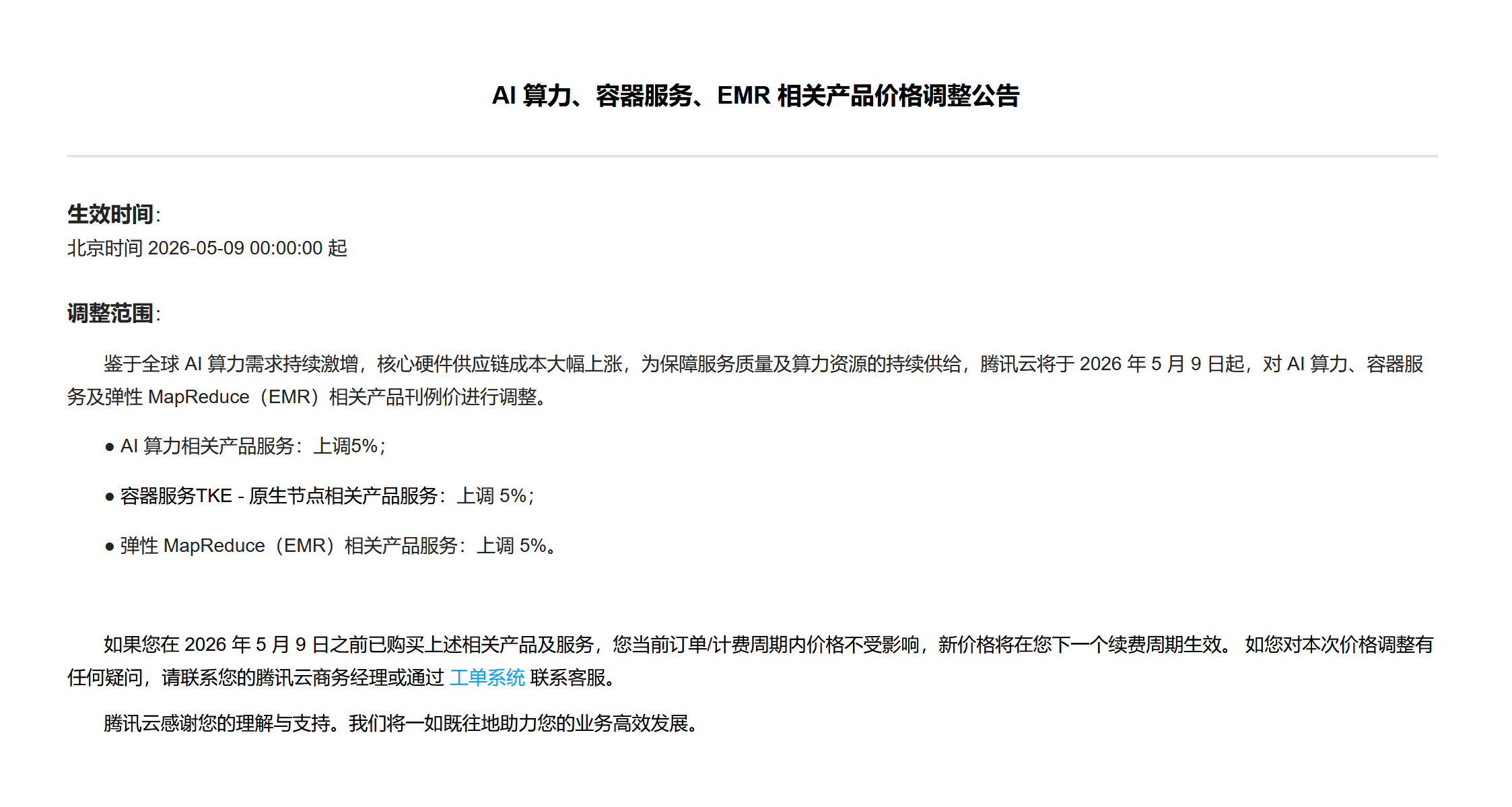

腾讯云上调 AI 算力等产品刊例价 5% 下月起生效 #16

受全球AI算力需求激增及硬件成本上涨影响,腾讯云宣布自下月起将上调AI算力以及弹性MapReduce等核心产品的刊例价,涨幅统一为 5%。

腾讯云发布公告宣布,受全球AI算力需求持续激增及核心硬件供应链成本大幅上涨的影响,为保障服务质量与算力资源的持续供给,其将对AI算力、容器服务TKE-原生节点以及弹性MapReduce (EMR) 等相关产品的刊例价统一上调5%。这项价格调整计划将于下个月起正式生效,涉及上述多项核心云服务产品。

相关链接:

Intel 与 Google 达成合作推进 AI 云基础设施与 IPU 开发 #17

Intel 与 Google 宣布达成多年期合作,Google Cloud 将继续部署 Intel Xeon 处理器,以满足 AI 训练及推理需求。双方还将扩大基于定制 ASIC 的基础设施处理单元联合开发。

Intel与Google近期宣布达成一项多年期合作。根据官方公告,双方将跨越多代Intel Xeon处理器进行技术对齐,并在基于定制ASIC的基础设施处理单元(IPU)联合开发上扩大合作。

Google Cloud将继续在其工作负载优化的实例中部署Intel Xeon处理器,包括搭载最新Intel Xeon 6处理器的C4和N4实例,以满足从大规模AI训练协调到延迟敏感型推理及通用计算等多种需求。

同时,新扩大的联合开发项目将利用IPU卸载网络、存储和安全任务,从而释放主机CPU的有效计算能力,提升超大规模环境的效率与性能可预测性。

相关链接:

Meta 与 CoreWeave 签 210 亿美元协议强化 AI 算力部署 #18

Meta与CoreWeave宣布达成一项价值210亿美元的云计算新协议,将合作期限延长至2032年底。根据协议,Meta获得了英伟达下一代

Vera Rubin芯片的初始部署权,为其超级智能团队扩充大模型研发算力。

Meta与CoreWeave近日宣布达成一项价值210亿美元的新协议,旨在为前者提供额外的云计算能力,以支持其快速增长的人工智能工作负载。该协议的有效期将延长至2032年12月,是在双方去年9月签署的142亿美元类似协议基础上的进一步深化合作。

根据协议内容,Meta将获得Nvidia下一代Vera Rubin芯片的初始部署权。

受此合作消息影响,两家公司的股价均出现了上涨。

相关链接:

Nebius 传正在洽谈收购 AI21 Labs #19

AI云服务商 Nebius 正在洽谈收购以色列大模型及Agent开发商 AI21 Labs,旨在整合其

Jamba模型与企业级AI平台,从算力租赁向算力加软件的全栈AI云转型。

据 The Information 报道,AI 云服务商 Nebius 正洽谈收购以色列初创公司 AI21 Labs,谈判仍在进行,价格未披露。Nebius 回应称不对传闻评论,但正构建全栈 AI 云。

此前据 Calcalist 报道,英伟达曾考虑约 30 亿美元 收购 AI21 Labs 未果。

AI21 Labs 专注大模型及企业级 Agent。

提示:内容由AI辅助创作,可能存在幻觉和错误。