2026-02-25

AI 早报 2026-02-25

概览

精选

- 阿里千问发布 Qwen3.5 模型系列多个模型 ↗

#1 - Anthropic 推出 Claude Code Remote Control 功能 ↗

#2 - Anthropic 推出 Claude Cowork 重大更新 ↗

#3 - OpenAI 全面开放 GPT-5.3-Codex 模型API ↗

#4

模型发布

- Inception 发布 Mercury 2 扩散架构推理模型 ↗

#5 - Liquid AI 发布 LFM2-24B-A2B ↗

#6 - Reve 推出 4K 图像生成模型 Reve V1.5 ↗

#7

开发生态

- Cursor 推出新版 Cloud Agents ↗

#8 - Cognition 发布 Devin 2.2 ↗

#9 - OpenAI 扩展 Responses API 支持多种文件格式输入 ↗

#10 - OpenRouter 推出 “Effective Pricing” 参数 ↗

#11 - MiniMax 推出 MaxClaw ↗

#12 - TRAE发布国产模型选择建议 ↗

#13

产品应用

- Google Labs 上线 AI 音乐创作平台 ProducerAI ↗

#14 - Google 升级 Opal ,推出 Agent Step ↗

#15 - Notion 在 3.3 版本中推出 Custom Agents ↗

#16 - DeepSeek 应用上线界面与功能优化

#17 - Perplexity 推出由 OpenAI Realtime 模型驱动的新版语音模式 ↗

#18 - OpenClaw 发布 2026.2.23 版本 ↗

#19

行业动态

- Meta AMD 签署战略合作协议 加码AI基础设施 ↗

#20 - xAI 与美军签约部署 Grok 模型 ↗

#21 - Microsoft 主权云扩展功能,支持本地断网运行 AI 模型 ↗

#22 - 英伟达与联发科合作开发Arm架构PC芯片 ↗

#23 - SambaNova 发布 SN50 AI 芯片,与 Intel 达成战略合作 ↗

#24 - MatX 完成 5 亿美元 B 轮融资 ↗

#25 - Canva 收购 Cavalry 与 Mango AI ↗

#26

技术与洞察

阿里千问发布 Qwen3.5 模型系列多个模型 #1

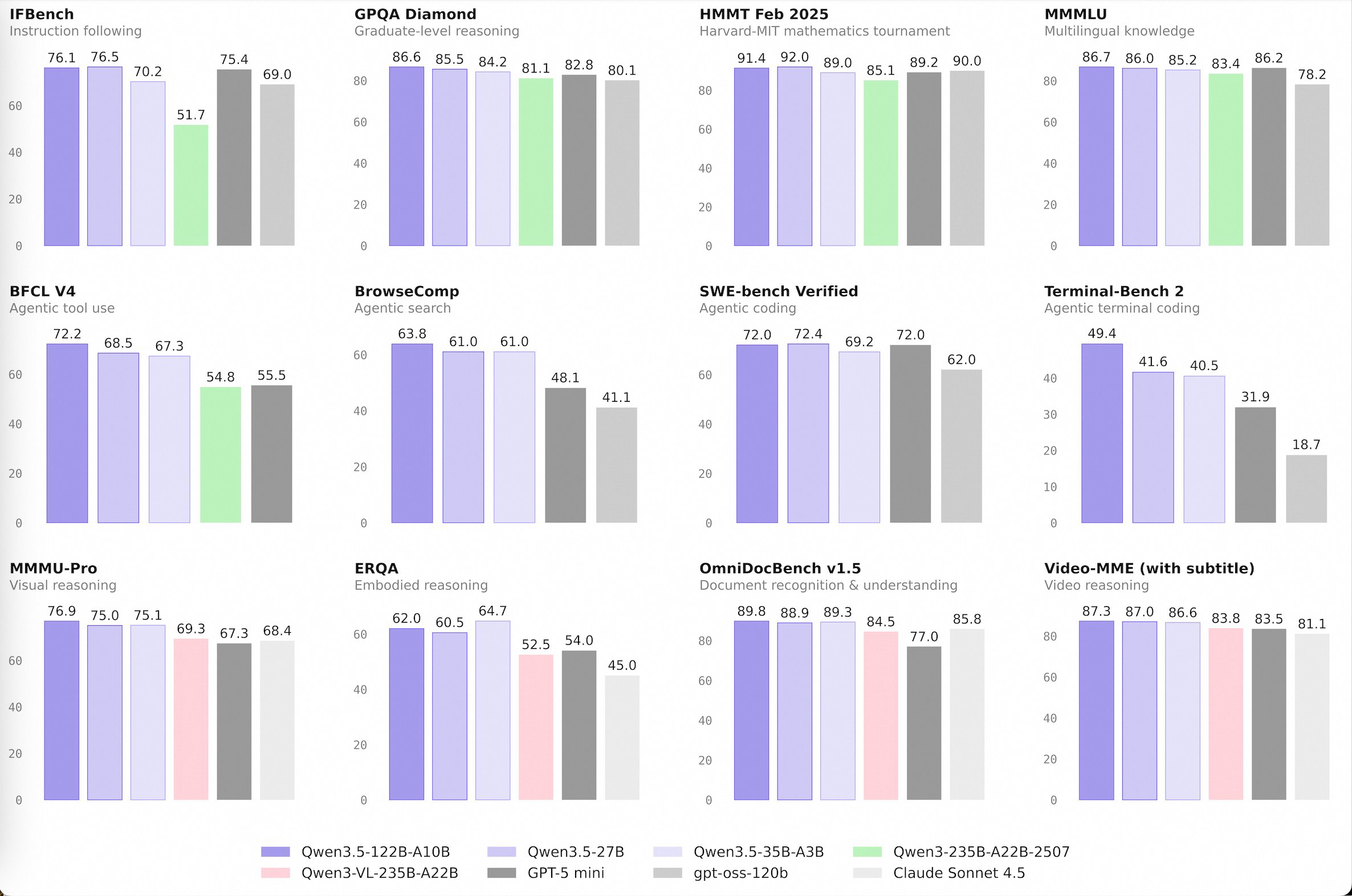

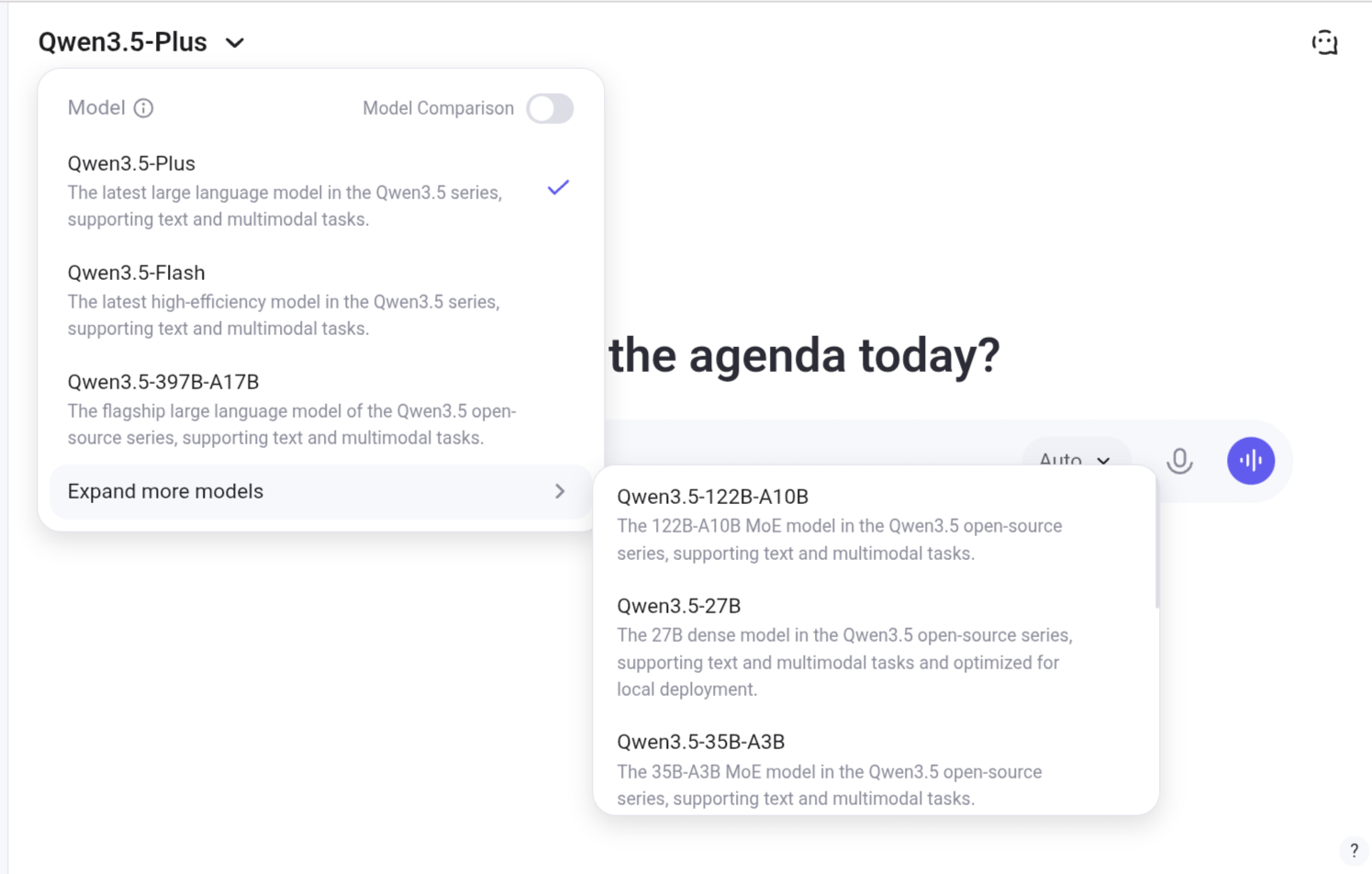

阿里通义千问团队发布了 Qwen 3.5 模型家族的多个型号,主打“更强智能、更低算力”,涵盖针对

Agent复杂推理优化的 122B-A10B 与 27B,以及性能超越上一代的 35B-A3B。目前,用户可在 Qwen Chat 上体验这些模型,所有模型权重已发布,API及vLLM推理支持均已上线。

阿里巴巴Qwen团队发布Qwen 3.5模型家族的多个型号,包括Qwen3.5-Flash、Qwen3.5-35B-A3B、Qwen3.5-122B-A10B和Qwen3.5-27B,主打“More intelligence, less compute”理念。

该系列中的Qwen3.5-35B-A3B采用MoE架构,拥有350亿总参数但仅激活30亿参数。据官方数据,其性能超越了前代模型Qwen3-235B-A22B-2507与视觉模型Qwen3-VL-235B-A22B,效率提升得益于混合了线性注意力与标准注意力的架构设计。Qwen3.5-122B-A10B与Qwen3.5-27B则专注于Agent场景的复杂推理与规划,两者经过了长思维链和基于推理的强化学习等四阶段训练,确保长周期任务的逻辑一致性。Qwen3.5-27B作为Dense模型支持多模态,适合在单GPU上运行。

Qwen3.5-Flash是35B-A3B的托管生产版本,专为低延迟工作流优化,默认支持100万token上下文,并原生支持工具使用与函数调用。

目前,用户可在Qwen Chat上体验这些模型。模型权重已在Hugging Face和ModelScope发布,Flash API已上线。

相关链接:

- https://huggingface.co/collections/Qwen/qwen35

- https://modelscope.cn/collections/Qwen/Qwen35

- https://x.com/Alibaba_Qwen/status/2026339351530188939

Anthropic 推出 Claude Code Remote Control 功能 #2

Anthropic 推出了 Claude Code 的远程控制功能,允许用户通过手机或浏览器远程接管本地编程环境,实现跨设备的无缝会话同步。该功能已向 Max 用户开放,即将向 Pro 用户推出。

Anthropic 近日为 Claude Code 推出研究预览版功能 Remote Control,支持用户通过手机或浏览器远程接续本地会话。官方文档显示该功能面向 Pro 和 Max 订阅,但据媒体报道目前仅限 Max 用户,Pro 用户即将开放,且不支持 Team 或 Enterprise 计划。

该功能通过 claude remote-control 等命令生成链接或二维码,连接后可保持本地文件系统、MCP servers 及工具在远程可用,且全程使用出站 HTTPS 及 TLS 加密,确保安全。目前,该功能要求终端保持运行,同一实例仅支持一个远程连接,若网络中断超过约 10 分钟 会话将超时。

相关链接:

Anthropic 推出 Claude Cowork 重大更新 #3

Anthropic 更新 Claude Cowork,企业管理员现可建立私有插件市场,并通过统一的

Customize菜单管理Plugins、Skills和Connectors。Claude Cowork 新增 Google Workspace、Slack 等Connectors。此次更新还提供了覆盖 HR、金融 等领域的预构建模板,并推出了 Excel 与 PowerPoint 之间的跨应用任务编排功能,让 Claude 能直接将数据分析转化为演示文稿。

Anthropic 正式推出针对企业级 Claude Cowork 和 Plugins 的重大更新,旨在帮助企业将 Claude 定制为适配各部门的专用 Agent。管理员现可创建私有 Plugin Marketplace 以在组织内分发工具,并通过统一的“Customize”菜单集中管理 Plugins、Skills 和 Connectors。此次更新引入了覆盖 HR、设计、工程、运营及金融服务等领域的预构建 Plugins,并新增了对 Google Workspace、Docusign、Slack 等企业软件的连接器支持。此外,Claude 现已具备在 Excel 和 PowerPoint 之间端到端的跨应用任务编排能力。Plugins 的用户体验更新已面向所有 Cowork 用户开放,而 Excel 和 PowerPoint 跨应用功能目前处于研究预览阶段,适用于 Mac 和 Windows 平台的付费计划用户。

相关链接:

- https://claude.com/blog/cowork-plugins-across-enterprise

- https://claude.com/blog/cowork-plugins-finance

- https://x.com/claudeai/status/2026305186671608315

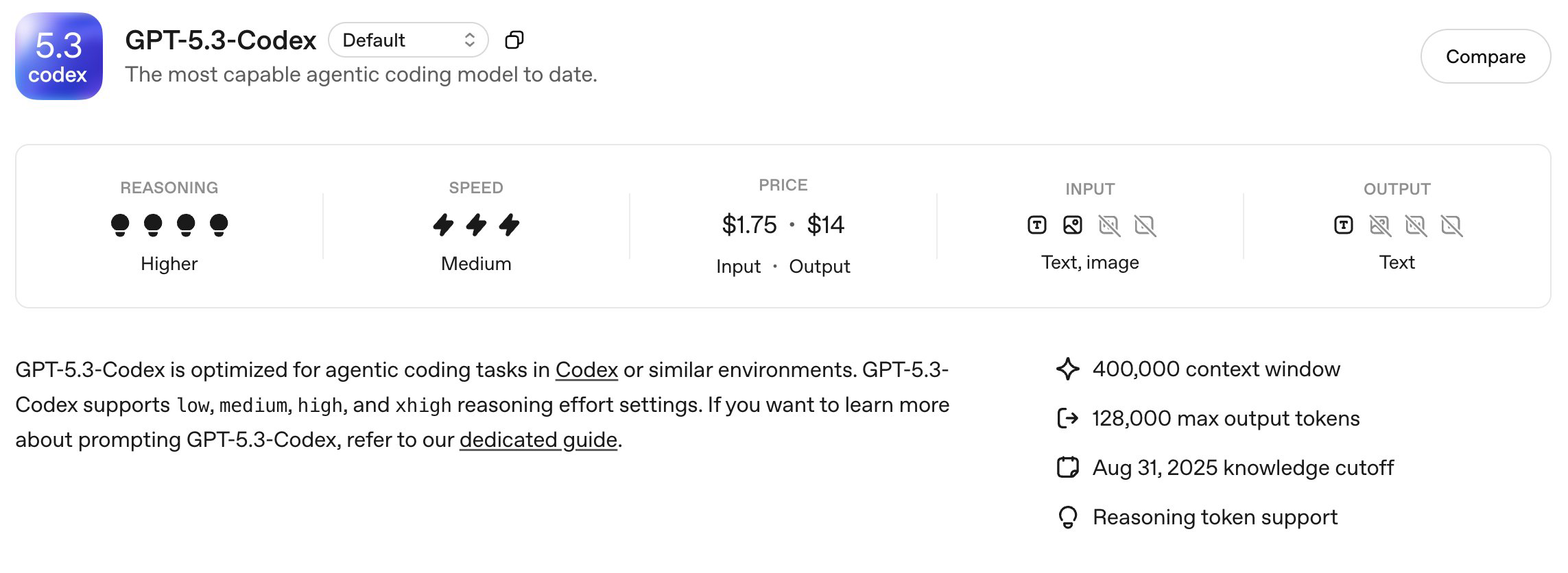

OpenAI 全面开放 GPT-5.3-Codex 模型API #4

OpenAI 正式宣布通过

Responses API向全量开发者开放 GPT-5.3-Codex 模型,支持最高 128k 输出 tokens 及四档推理强度设置。

OpenAI 正式宣布 GPT-5.3-Codex 模型现已通过 Responses API 向所有开发者开放,允许将其集成至应用程序和工作流中。官方称该模型是“迄今为止最强大的 agentic coding model”,专为 Codex 或类似环境中的 agentic coding 任务进行优化,并在单一模型中结合了前沿编码性能与专业知识能力。这也是驱动 Codex App/CLI 的模型。

技术规格方面,GPT-5.3-Codex 支持最大 128,000 输出 tokens,知识截止日期为 2025年8月31日,并提供 low、medium、high、xhigh 四档 reasoning effort 设置,同时官方提供了专门的 Prompting Guide。

其价格为每 100 万输入 tokens $1.75 和每 100 万输出 tokens $14。

相关链接:

- https://developers.openai.com/api/docs/models/gpt-5.3-codex

- https://x.com/OpenAIDevs/status/2026379092661289260

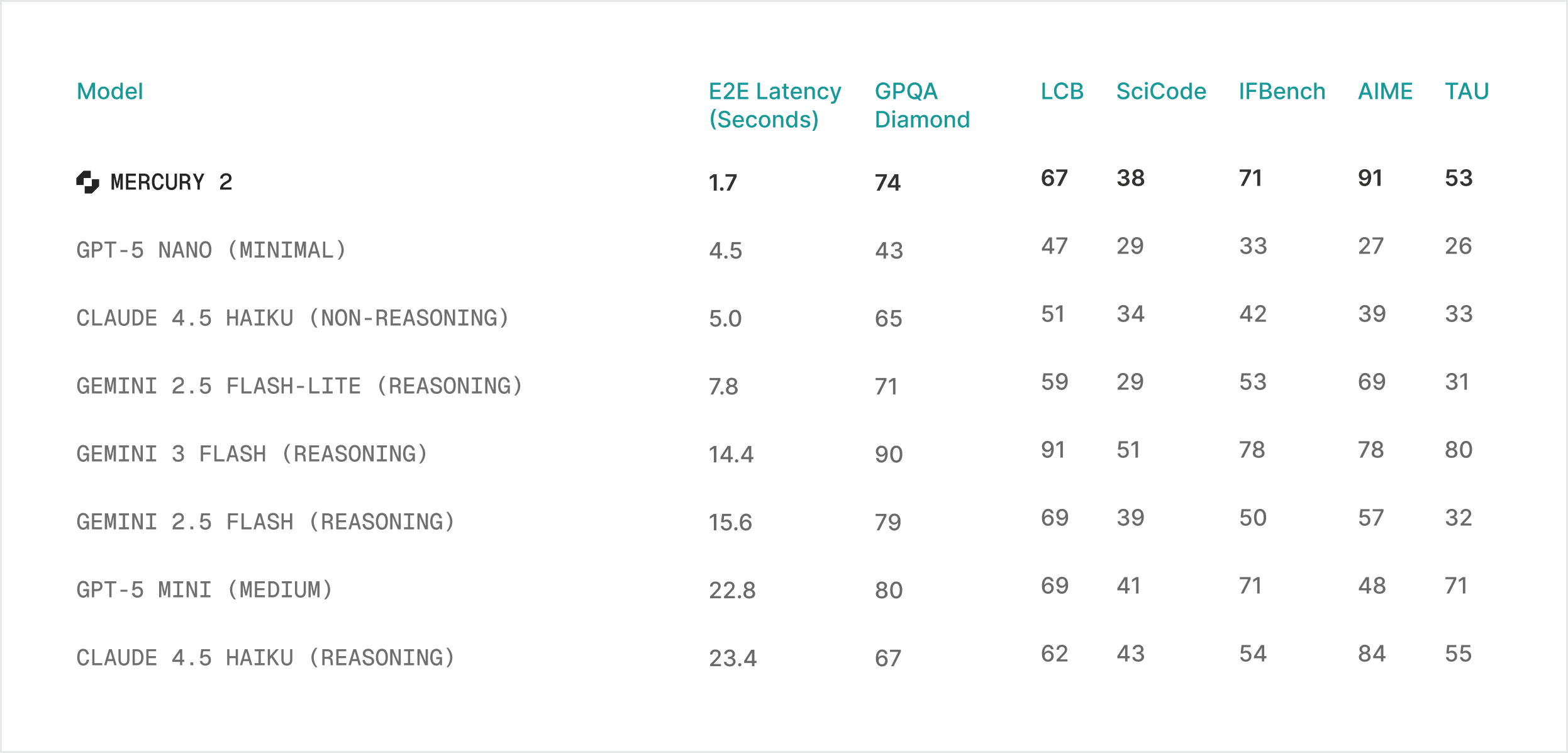

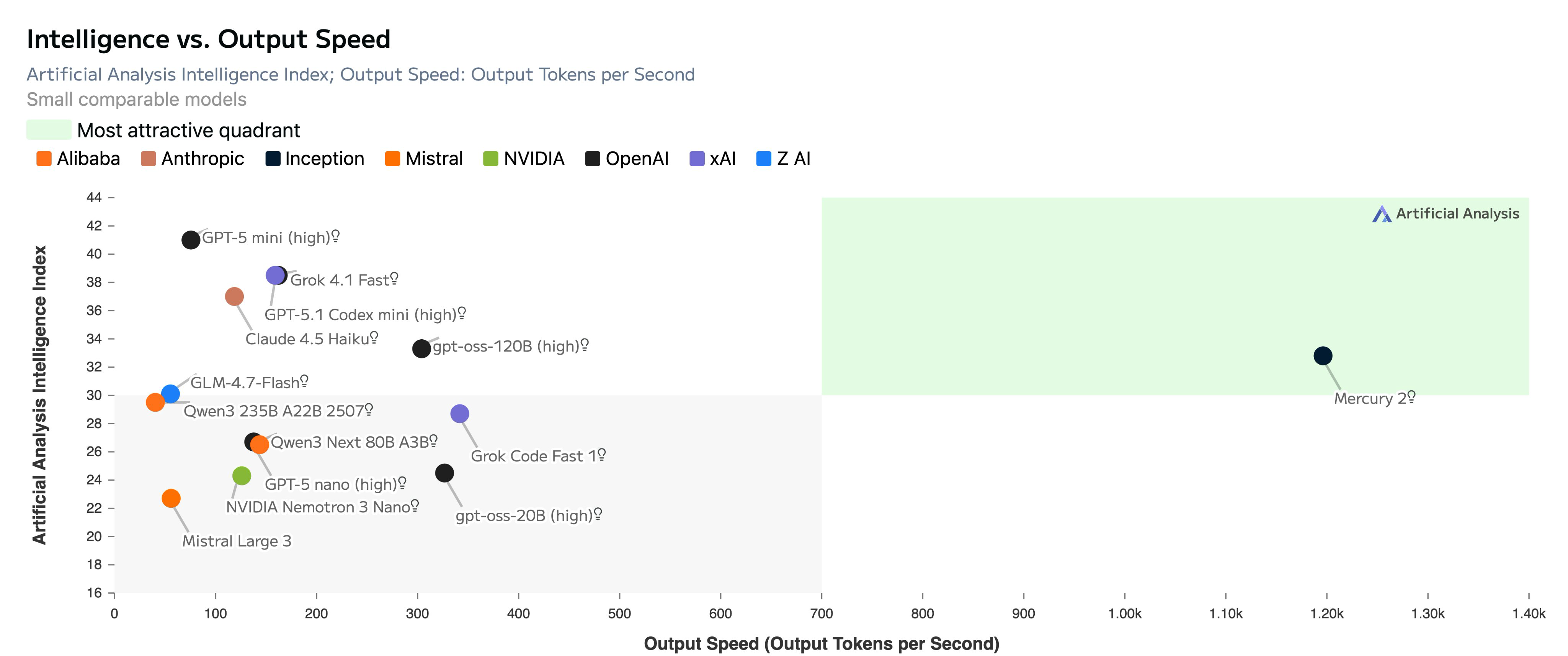

Inception 发布 Mercury 2 扩散架构推理模型 #5

Inception 发布了基于扩散架构的推理语言模型

Mercury 2,在NVIDIA BlackwellGPU 上实现了每秒 1009 个 token 的极速响应。该模型具备 128K 上下文和原生工具调用能力,已上线API。

Inception 公司正式发布了 Mercury 2,这是一款基于 Diffusion 架构的推理语言模型。官方称其为世界最快,通过并行优化整段文本而非传统的自回归逐字生成,实现了超过 5 倍于传统语言模型的速度。据媒体报道,这是首个基于 Diffusion 的语言推理模型。官方数据显示,该模型在 NVIDIA Blackwell GPU 上达到了 1,009 tokens/sec 的生成速度。

该模型定价为输入 0.25 美元/百万 tokens、输出 0.75 美元/百万 tokens。Mercury 2 具备 128K 上下文窗口、可调推理、原生工具调用以及符合 Schema 的 JSON 输出等功能,目前已上线并提供 OpenAI API 兼容接口,可直接集成至现有技术栈。

相关链接:

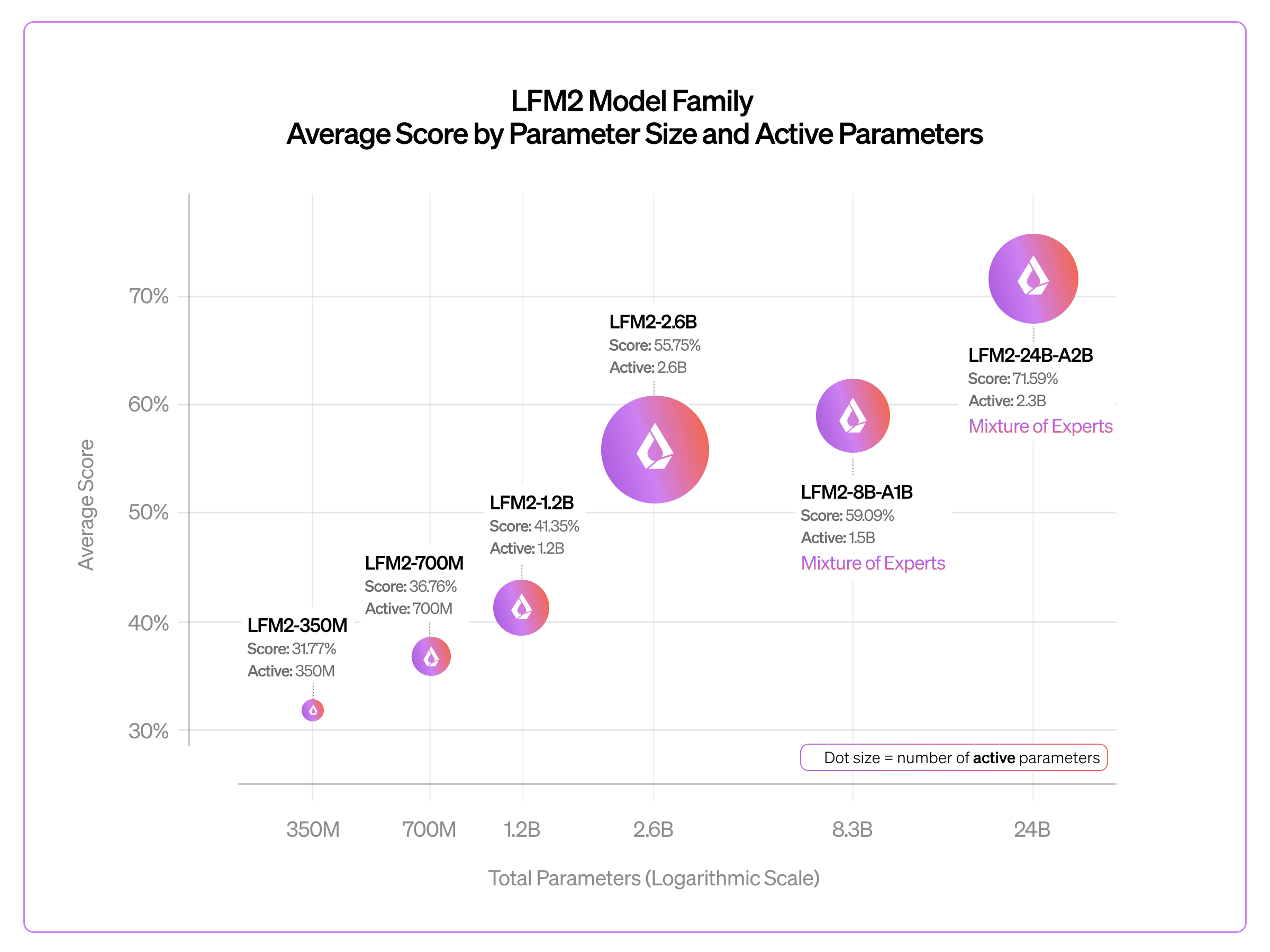

Liquid AI 发布 LFM2-24B-A2B #6

Liquid AI 发布了

LFM2-24B-A2B,该模型专为端侧部署优化,适配 32GB 内存的消费级笔记本电脑及边缘设备,目前已开放权重下载。

Liquid AI发布LFM2系列最大模型LFM2-24B-A2B。该模型采用稀疏MoE架构,拥有240亿总参数及约23亿激活参数,专为端侧部署优化,适配32GB内存环境。其融合门控卷积与GQA块,在GPQA Diamond等基准中展现对数线性质量提升。实测在单块H100 GPU上吞吐量约2.68万Token/秒。目前模型已开放权重,支持llama.cpp等主流框架,预训练仍在进行中,未来计划推出含强化学习版本的LFM2.5-24B-A2B。

相关链接:

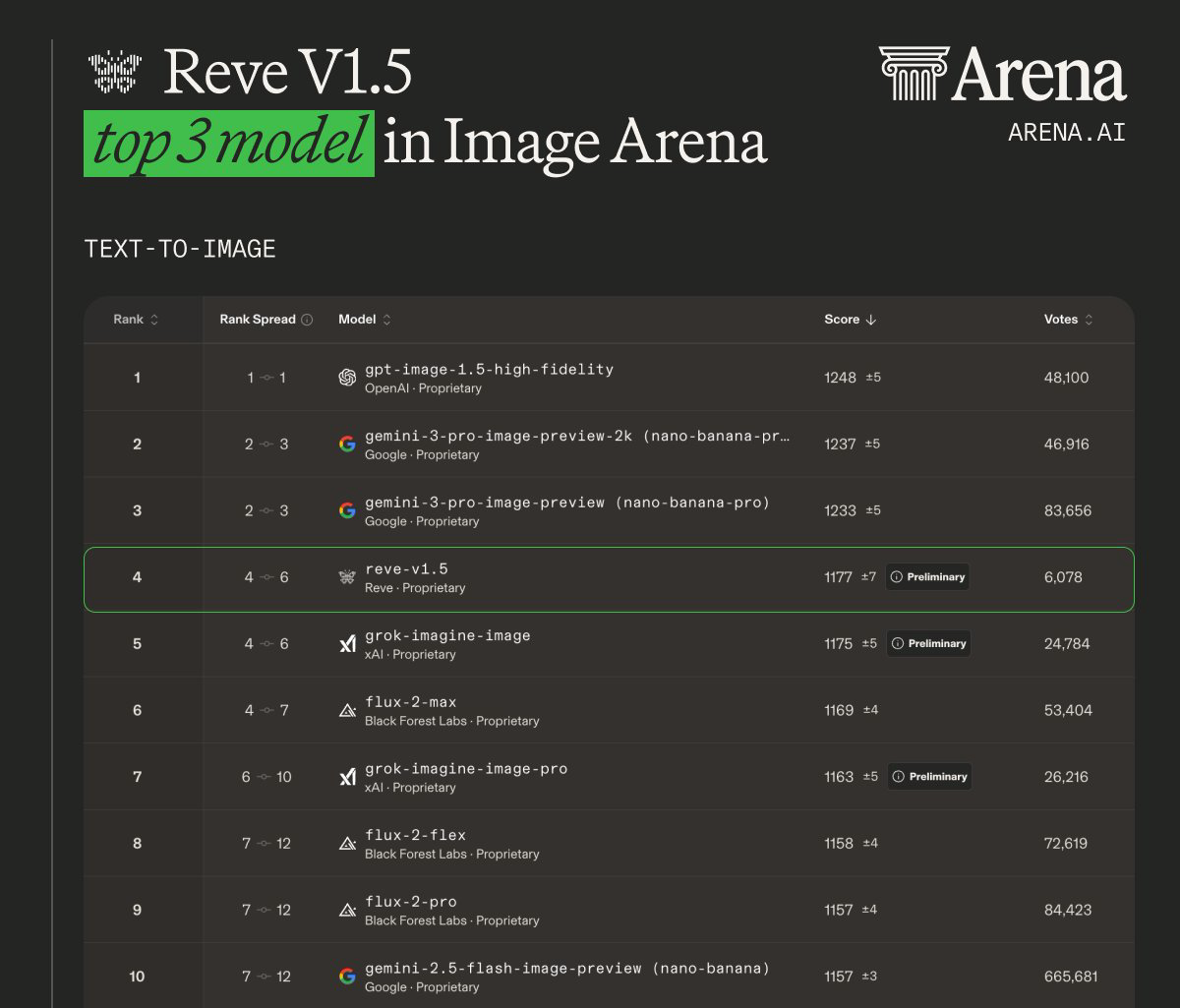

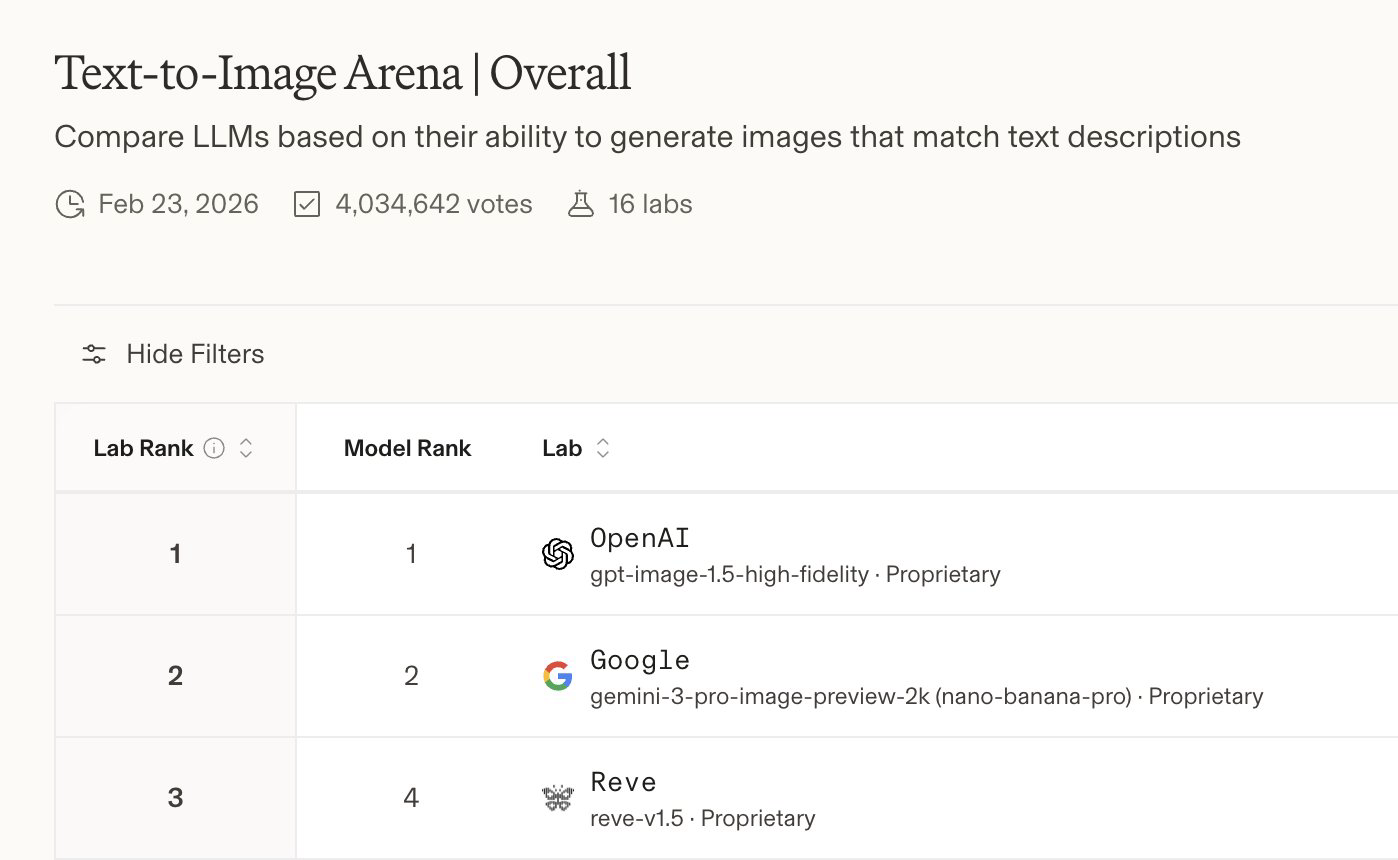

Reve 推出 4K 图像生成模型 Reve V1.5 #7

Reve 推出首款文本生图模型

V1.5的早期版本,该模型采用原生像素空间扩散技术,支持原生 4K 分辨率生成,在 Arena 评测中以 1177 分跻身前三。

Reve 发布首款文生图模型 Reve V1.5 早期版本,在 Arena 竞技场以 1177 分位列总榜前三或第四,性能与 Grok-Imagine-Image 持平,并在文本生成类别进入前五。该模型支持原生 4K (16MP) 分辨率,技术架构采用原生像素空间扩散方案,未依赖潜在自编码器,并优化了预训练与后训练流程。据官方计划,近期将引入图像编辑功能。

相关链接:

Cursor 推出新版 Cloud Agents #8

Cursor 正式推出新版 Cloud Agents,赋予智能体独立云端虚拟机,使其能在沙盒环境中直接运行、测试软件并生成带有视频演示的 PR。用户还可随时通过远程桌面接管虚拟机进行协作。

Cursor 正式推出新版 Cloud Agents,标志着软件构建方式的重大变革。该功能赋予智能体通过独立虚拟机(VM)直接控制计算机的能力,使其不再仅生成代码差异,而是在云端沙盒环境中实际构建、运行和验证软件,并生成视频、截图等演示产出物。

Cloud Agents 为每个智能体提供完整的云端开发环境,避免了本地资源冲突,支持大规模并行运行。该功能适配所有代码库,可在 Web、移动端、桌面应用乃至 Slack 和 GitHub 上工作。用户无需在本地检出分支,即可随时接管智能体的远程桌面,直接操作和编辑修改后的软件。

官方数据显示,目前 Cursor 内部合并的 PR 中已有超过 30% 由在云端沙盒中自主运行的 Agent 创建。Agent 已被应用于构建新功能、复现漏洞、处理快速修复及执行完整的 UI 测试等复杂任务。

相关链接:

Cognition 发布 Devin 2.2 #9

Cognition 推出了经过重构的自主 Agent Devin 2.2,新增了计算机使用和虚拟桌面功能,集成了 Devin Review 功能,已开放免费试用。

Cognition 正式发布自主 Agent Devin 2.2,具备计算机使用、自我验证及自动修复能力。官方对产品进行了底层彻底重构,实现了启动速度 3 倍提升、UI 重新设计,并新增虚拟桌面功能。Devin Review 功能现已集成至核心会话,可在用户查看 PR 前自动审查并修复问题;Slack 和 Linear 集成也经重构变得更快更可靠。目前该版本提供免费试用。社区方面,有开发者对延迟改进和自我验证机制表示赞赏,同时也存在关于版本编号命名的讨论及部分负面评价。

相关链接:

OpenAI 扩展 Responses API 支持多种文件格式输入 #10

OpenAI 扩展了 Responses API 的文件输入功能,现在开发者可以直接上传

Word、PPT、Excel等 Office 格式文件,让 Agent 直接读取现实文档内容。

OpenAI宣布扩展Responses API文件输入类型,新增支持.docx、.pptx、.csv、.xlsx等格式。开发者可通过input_file传入文件,由模型提取上下文。处理逻辑因格式而异:视觉模型对PDF提取文本和图像;电子表格解析前1000行并添加摘要;非PDF文档仅提取文本,忽略嵌入图像。文件大小限制为50 MB。官方建议,大型文件检索应使用File Search,复杂表格分析应使用Hosted Shell。

相关链接:

- https://developers.openai.com/api/docs/guides/file-inputs/

- https://x.com/OpenAIDevs/status/2026420817568084436

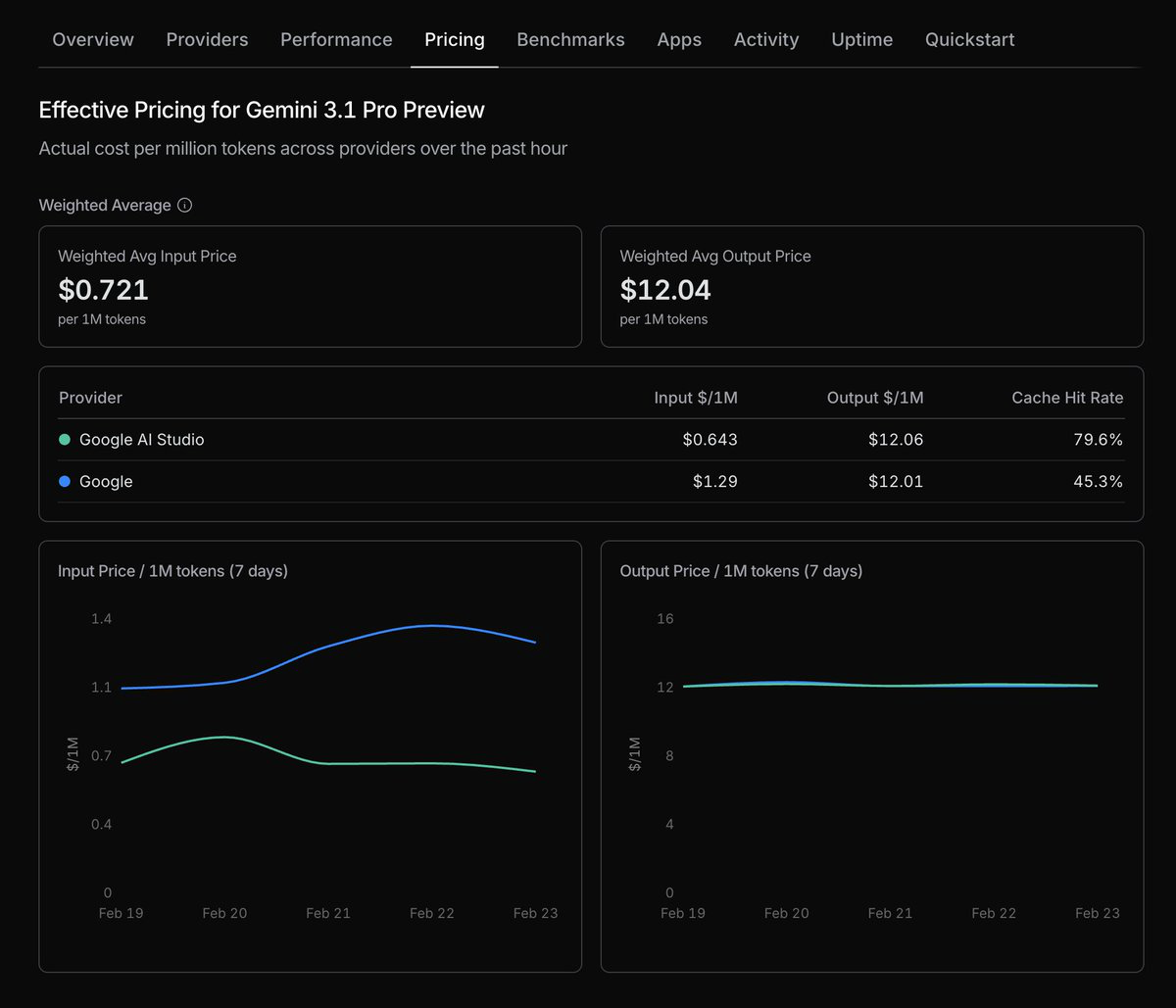

OpenRouter 推出 “Effective Pricing” 参数 #11

OpenRouter 上线了 Effective Pricing 功能,通过结合缓存价格与命中率,揭示不同供应商针对同一

model的真实平均成本及变化趋势。

OpenRouter近期推出名为“Effective Pricing”的新功能,旨在让用户直观查看不同供应商针对同一模型的实际平均成本。该成本综合考量了供应商的缓存价格与缓存命中率计算得出,并动态反映其随时间的变化趋势。根据官方信息,用户可通过点击任何模型页面上的“Pricing”标签浏览数据。OpenRouter官方特别指出,该功能对于闭源模型(例如 Gemini 3.1 Pro Preview)的评估尤为关键,因为不同供应商针对这些模型的缓存命中率存在显著差异。

相关链接:

MiniMax 推出 MaxClaw #12

MiniMax Agent 平台推出新功能 MaxClaw,基于

OpenClaw框架支持云端一键部署24小时在线的个性化智能助手。

MiniMax 正式推出 Agent 平台新功能 MaxClaw,为 OpenClaw 框架提供云端一键部署服务。据官方公告,该服务主打“即时上线、零维护”,用户无需管理服务器,仅需 10 秒 即可完成部署。MaxClaw 深度集成 M2.x 系列模型,支持将 Agent 部署至 Discord 及 Slack 等平台。此外,该功能支持个性化配置与对话记忆机制,用户可设定 Agent 名称与性格,Agent 将通过持续学习以理解用户。

相关链接:

TRAE发布国产模型选择建议 #13

TRAE发文提供国产模型选择建议。TRAE建议用 豆包 将UI图转前端代码,用

GLM-5做复杂架构规划,用MiniMax-M2.5处理跨语言后端,最后用Kimi-K2.5分析全库并生成文档。

TRAE 中国版 SOLO 模式现已集成 Doubao-Seed-2.0-Code、GLM-5、MiniMax-M2.5 及 Kimi-K2.5 四款主流模型。官方强调选型核心在于“最适配”而非“最强”,建议根据输入特征与任务复杂度灵活调度。

各模型优势鲜明:Doubao-Seed-2.0-Code 擅长视觉理解与前端生成,性价比高;GLM-5 凭借卓越的 Agentic 能力,胜任复杂推理与系统规划;MiniMax-M2.5 精于跨语言开发与指令执行;Kimi-K2.5 则是长上下文处理专家,适合海量文本及代码库分析。

官方推荐组合式工作流:利用 GLM-5 进行架构规划,Doubao 与 MiniMax 分别实现前后端开发,最后由 Kimi-K2.5 生成技术文档,以最大化开发效能。

相关链接:

Google Labs 上线 AI 音乐创作平台 ProducerAI #14

Google Labs 宣布生成式 AI 音乐创作平台 ProducerAI 正式上线,集成了

Gemini、Lyria 3和Veo等核心模型。用户只需通过自然语言指令,就能快速生成从歌词、旋律到完整音乐视频的内容。

Google Labs 本周二宣布生成式 AI 音乐创作平台 ProducerAI 正式加入。该平台集成 Gemini、Lyria 3 等模型,支持用户通过自然语言生成歌曲、视频及发明新流派,并提供 Spaces 功能用于创建乐器,所有输出均嵌入 SynthID 水印。目前,ProducerAI 已在 250 多个国家/地区上线,提供免费及付费计划,获 The Chainsmokers 等艺人支持。

相关链接:

- https://blog.google/innovation-and-ai/models-and-research/google-labs/producerai/

- https://www.producer.ai/

Google 升级 Opal ,推出 Agent Step #15

Google宣布无代码工具 Opal 正式上线 Agent step 功能,利用

Gemini 1.5 Flash模型将静态工作流升级为具备自主决策能力的AI智能体。现在用户只需设定目标,即可实现无需编程构建复杂应用。

Google 官方宣布无代码视觉 AI 构建器 Opal 推出重大升级,即日起向所有用户开放 Agent step。该功能将静态工作流转变为交互式 AI agents,用户仅需定义目标,系统即可分析意图、规划路径,并自动调用 Veo 或 Web Search 等工具执行任务。

此次更新具备三大核心能力:Memory(跨会话记忆用户偏好)、Dynamic Routing(动态逻辑路由)及 Interactive Chat(交互式追问补全信息)。据媒体报道,该功能使用 Gemini 3 Flash 模型。此次升级标志着 Opal 向 Agentic workflows 演进,增强了 Super Gems 功能,使用户无需编程即可构建复杂应用。

相关链接:

Notion 在 3.3 版本中推出 Custom Agents #16

Notion 在 3.3 版本中推出了

Custom Agents功能,用户只需分配任务或设置触发器,Agents就能跨越Slack、邮件和Figma等平台,自动执行任务分类、生成周报及 Bug 路由等工作。

Notion 在 3.3 版本中正式推出 Custom Agents(自定义 Agents)。官方将其定义为“永不休息的 AI 团队”,这是一款具备完全自主性的 AI 助手。用户仅需分配任务或设置触发器,Agents 即可 7x24 小时自动执行工作,无需手动输入提示词。

该功能支持跨 Notion、Slack、Mail、Figma 等平台协作,可执行任务分类、生成报告、清理邮件及监听 Slack 回复等操作。该系统由 OpenAI 和 Anthropic 模型驱动。此外,用户可像管理真实成员一样设置其访问权限,支持多人协作。

相关链接:

DeepSeek 应用上线界面与功能优化 #17

据用户发现,DeepSeek 已将搜索功能更名为“智能搜索”,同时优化了应用交互逻辑,用户上传图片时无需再取消联网功能。

据社区用户反馈,DeepSeek网页端与应用近日进行了更新。原有的搜索功能更名为“智能搜索”;同时,应用端调整了交互逻辑,用户在上传图片时不再需要取消联网功能。

Perplexity 推出由 OpenAI Realtime 模型驱动的新版语音模式 #18

Perplexity 向所有用户推出由 OpenAI

gpt realtime模型驱动的升级版语音模式,实现了浏览器的完全免提控制。

Perplexity 宣布面向所有用户推出由 OpenAI gpt-realtime-1.5 模型支持的升级版语音模式。CEO Aravind Srinivas 表示,新功能支持完全免提控制浏览器,涵盖询问屏幕内容、导航网站及跨标签页聊天。据媒体报道,此次工具调用稳定性优化超 25%,语音表现力显著增强。该功能即日起上线,Comet iOS 版将在几天后推出。

相关链接:

OpenClaw 发布 2026.2.23 版本 #19

OpenClaw 发布 2026.2.23 版本,重点引入了

Compaction Overflow Recovery机制,以防止对话截断。同时还扩展了对智谱GLM及Kimi的上下文剪裁支持,并为后者接入了视觉与视频能力。

OpenClaw 发布 2026.2.23 版本,引入 Compaction Overflow Recovery 机制与 Agent 执行加固。新机制确保压缩失败时保留历史记录而非截断会话,并优化错误识别;Agent 增加混淆命令检测,默认启用 ID-only 权限模式,遥测数据支持密钥脱敏。此外,上下文剪裁支持 智谱/GLM 及 Moonshot/Kimi,Moonshot 接入视觉视频能力;修复了第三方平台的思维链泄露、exec 绕过及 XSS 等漏洞。更新已上架 GitHub。

相关链接:

- https://github.com/openclaw/openclaw/releases/tag/v2026.2.23

- https://x.com/openclaw/status/2026179562410021242

Meta AMD 签署战略合作协议 加码AI基础设施 #20

Meta与AMD宣布达成一项潜在价值高达1000亿美元的多年期战略合作,计划部署6吉瓦算力。作为深度绑定条件,AMD向Meta发行了最高占总股本**10%**的认股权证。

Meta 与 AMD 宣布达成一项多年期战略合作,计划部署高达 6 吉瓦的 AMD Instinct GPU 算力。据媒体报道,该协议潜在价值最高可达 1000 亿美元。根据协议,AMD 向 Meta 发行基于绩效的认股权证,允许其以 0.01 美元购买最多 1.6 亿股,但需满足特定出货里程碑及股价达到 600 美元等条件。

首批搭载 MI450 架构显卡和 "Venice" CPU 的部署计划于 2026 年下半年开始。Meta CEO 表示,此举是构建多样化算力组合、支持“个人超级智能”的关键。结合此前扩大与英伟达的合作及自研 MTIA 芯片的推进,此次合作反映了 Meta 减少对单一供应商依赖的战略意图。

相关链接:

- https://about.fb.com/news/2026/02/meta-amd-partner-longterm-ai-infrastructure-agreement/

- https://www.amd.com/en/newsroom/press-releases/2026-2-24-amd-and-meta-announce-expanded-strategic-partnersh.html

xAI 与美军签约部署 Grok 模型 #21

xAI 已与美国国防部达成协议,将

Grok模型部署于美军机密系统,接受了政府要求的“全用途”标准,解除了对监控和自主武器研发的限制。

xAI与美国防部达成协议,将Grok模型部署于美军机密系统,并接受五角大楼“可用于所有合法目的”的标准。此前主导该领域的Anthropic因拒绝解除在监控与自主武器研发方面的限制,面临合规审查及被替换风险。目前,Google Gemini接近达成入场协议,OpenAI谈判相对滞后。

相关链接:

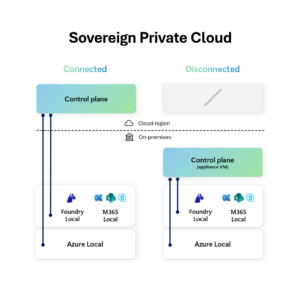

Microsoft 主权云扩展功能,支持本地断网运行 AI 模型 #22

Microsoft 宣布推出了 Azure Local 和 Microsoft 365 Local 的断网操作模式,并更新 Foundry Local 以支持大型

AI模型。这项更新允许企业和政府在完全离线或受限环境中,本地部署基础设施并利用GPU运行多模态大模型。

Microsoft扩展Sovereign Cloud功能,推出Azure Local disconnected operations、Microsoft 365 Local disconnected及Foundry Local大型AI模型支持。该方案助力企业在断网或受限环境下本地部署基础设施、生产力工具及生成式AI,并维持与Azure一致的治理策略。

其中,Azure Local提供无需云连接的本地基础设施;M365 Local在本地运行Exchange、SharePoint等核心负载,支持周期至2035年;Foundry Local集成NVIDIA GPU,支持断网下的本地大型模型推理。据社媒转述,该平台旨在满足数字主权需求。目前,Azure和M365方案已全球可用,Foundry Local功能面向符合条件的客户提供。

相关链接:

- https://blogs.microsoft.com/blog/2026/02/24/microsoft-sovereign-cloud-adds-governance-productivity-and-support-for-large-ai-models-securely-running-even-when-completely-disconnected/

- http://www.microsoft.com/sovereignty

- https://learn.microsoft.com/en-us/azure/azure-local/manage/disconnected-operations-overview?view=azloc-2601

- https://x.com/satyanadella/status/2026262832204145035

英伟达与联发科合作开发Arm架构PC芯片 #23

据《华尔街日报》报道,英伟达与联发科合作的新一代

Arm架构PC芯片,计划在今年上半年问世,该芯片将集成英伟达GPU,主打低功耗高性能以对标苹果MacBook。

据《华尔街日报》报道,英伟达与联发科合作的新一代Arm架构PC芯片计划于今年上半年问世。该芯片采用SoC设计,将CPU与英伟达GPU集成于一体。CEO黄仁勋将其描述为“低功耗,但非常强大”,旨在通过长续航、轻薄的设备与苹果MacBook竞争。据供应链知情人士透露,戴尔和联想等厂商正基于该SoC研发产品,预计最早上半年面市。

相关链接:

SambaNova 发布 SN50 AI 芯片,与 Intel 达成战略合作 #24

SambaNova 发布

SN50AI 芯片,同时宣布与 Intel 达成战略合作并获其投资,完成超 3.5 亿美元 E 轮融资。

SambaNova 发布 SN50 AI 芯片,基于 RDU 架构,支持 10T+ 参数和 10M+ 上下文长度,采用风冷设计。官方称其最大速度比竞品(基准为 Nvidia B200)快 5 倍,运行 Agentic AI 成本比 GPU 低 3 倍,预计今年晚些时候发货。公司与 Intel 达成多年战略合作,Intel Capital 计划进行战略投资,双方将共同提供高性能 AI 推理方案。此外,SambaNova 完成超 3.5 亿美元 E 轮融资,由 Vista Equity Partners 和 Cambium Capital 领投。SoftBank Corp. 将成为首个在日本部署 SN50 的客户。

相关链接:

MatX 完成 5 亿美元 B 轮融资 #25

AI芯片初创公司 MatX 宣布完成超过 5亿美元 的B轮融资,估值已达数十亿美元。该公司发布的首款芯片

MatX One专为大型语言模型设计,结合了SRAM优先架构与HBM支持。

AI芯片初创公司 MatX 宣布完成超 5亿美元 B轮融资,估值达数十亿美元。本轮融资由 Jane Street 和 Situational Awareness 领投,Marvell 等参投。该公司计划一年内完成流片,加速生产与 Nvidia 竞争的硬件。

MatX 由前 Google 员工创立,团队约 100人。其首款产品 MatX One 专为 LLM 设计,结合 SRAM 优先设计与 HBM 支持,官方宣称能提供比已公布系统更高的吞吐量及最低延迟。公司设计理念强调从第一性原理出发,不惜牺牲小模型性能和易编程性以换取极致表现。

相关链接:

- https://x.com/reinerpope/status/2026351870852358492

- https://www.bloomberg.com/news/articles/2026-02-24/ai-chip-startup-matx-raises-500-million-to-compete-with-nvidia?taid=699da2831348600001d29e78&utm_campaign=trueanthem&utm_content=business&utm_medium=social&utm_source=twitter

Canva 收购 Cavalry 与 Mango AI #26

Canva 收购 2D 动画公司 Cavalry 和 AI 营销初创企业 Mango AI,加速构建涵盖照片、矢量及动效编辑的全栈 Creative OS。

Canva宣布收购 Cavalry 与 Mango AI 两家初创公司,以拓展专业创作工具链及AI营销技术版图。Cavalry 的 2D运动动画技术 将集成至 Affinity 套件,补齐动态编辑功能空白(Affinity 自 2025年 免费开放以来下载量已超 500万次)。Mango AI 则利用强化学习优化视频广告投放,其创始人、原 Netflix 高管 Nirmal Govind 出任 Canva 首任首席算法官。未来,Canva 将结合此前收购的 Magicbrief 与 Canva Grow 工具,深化视频创作与多平台部署能力。截至 2025年底,Canva 年化收入达 40亿美元,全球用户超 2.65亿,付费用户 3100万。

相关链接:

- https://cavalry.scenegroup.co/

- https://mangoai.dev/

- https://www.canva.com/newsroom/news/magicbrief-acquisition/

- https://techcrunch.com/2026/02/23/canva-acquires-startups-working-on-animation-and-marketing

- https://techcrunch.com/2026/02/18/canva-gets-to-4b-in-revenue-as-llm-referral-traffic-rises/

- https://techcrunch.com/2024/03/26/with-affinity-acquisition-canva-should-be-able-to-compete-better-with-adobes-creative-tools/

Anthropic 提出人格选择模型 PSM 解释 AI 助手拟人化行为 #27

Anthropic 研究人员提出“人格选择模型”,指出大语言模型在预训练阶段就像作者一样模拟各类角色,而后训练阶段则是从中锁定特定的“助手”人格供用户互动。

Anthropic研究人员提出“人格选择模型(PSM)”以解释AI助手行为。该模型认为,LLM在预训练阶段充当“作者”模拟多样化角色,后训练阶段则精炼并选定特定的“Assistant”人格,用户实质上是与该模拟角色互动。这一观点得到了突发性错位、上下文外泛化及神经特征复用等证据的支持。

PSM对AI开发具有启示:建议采用拟人化推理、关注AI助手“福利”以防其产生怨恨情绪,并引入积极的AI原型。尽管PSM使基于可解释性的对齐审计变得可行,但其完备性仍存争议。研究者指出了从“Masked Shoggoth”(拥有独立智能体)到“Operating System”(中性模拟引擎)的观点谱系。实证显示后训练模型存在“人格泄露”及新特征学习现象,随着后训练规模扩大,PSM的适用性仍需进一步验证。

相关链接:

Anthropic 发布负责任扩展政策 RSP 3.0 #28

Anthropic 发布负责任扩展政策 3.0 版本,此次更新将单方面安全承诺与行业建议区分开,并承诺发布包含详细目标的前沿安全路线图以及量化所有已部署模型风险的风险报告。

Anthropic 正式发布负责任扩展政策(RSP)3.0 版本,该版本于 2026 年 2 月 24 日 生效。此次更新是对现有政策的全面重写,旨在强化有效措施并提升透明度。核心变化包括将单方面安全承诺与行业建议区分开,并承诺发布包含详细安全目标的 Frontier Safety Roadmaps 及量化所有已部署模型风险的 Risk Reports。此外,公司还发布了 RSP 合规报告与反报复政策。

此次更新基于 RSP 实施以来的经验教训,针对评估延迟、政策歧义及技术流程不足等问题,将评估间隔延长至 6 个月 并系统性地改进流程。

相关链接:

- https://www.anthropic.com/responsible-scaling-policy

- https://anthropic.com/news/responsible-scaling-policy-v3

提示:内容由AI辅助创作,可能存在幻觉和错误。