2026-04-19

AI 早报 2026-04-19

概览

开发生态

- Cloudflare 推出检测工具,帮助评估网站 AI Agent 适配程度 ↗

#1 - Cloudflare 推出 Agent Memory 托管服务 ↗

#2 - xAI 推出 Grok 语音转写与合成两款音频 API ↗

#3

技术与洞察

- 月之暗面联合清华提出 Prefill-as-a-Service 架构 ↗

#4

行业动态

- OpenAI 人事动荡,三名核心高管同日宣布离职 ↗

#5

前瞻与传闻

- xAI 澄清 Grok 4.3 非 1T,1T 版 Grok 4.4 预计五月初发布 ↗

#6

Cloudflare 推出检测工具,帮助评估网站 AI Agent 适配程度 #1

Cloudflare官方宣布推出检测工具

isitagentready.com,帮助站长评估网站对 AI Agent 的适配程度。该工具不仅提供多维度评分,还会直接生成提示词供编码 Agent 进行自动优化。

Cloudflare 宣布推出检测工具 isitagentready.com 及 Cloudflare Radar 相关数据集,旨在帮助站长评估其网站对 AI Agent 的就绪程度。

根据官方对全网 20 万 顶级域名的扫描数据,当前互联网的 Agent 就绪度普遍极低。传统 SEO 基础设施普及率较高,但面向 Agent 的语义层、授权层及支付层等新兴标准几乎处于空白状态。

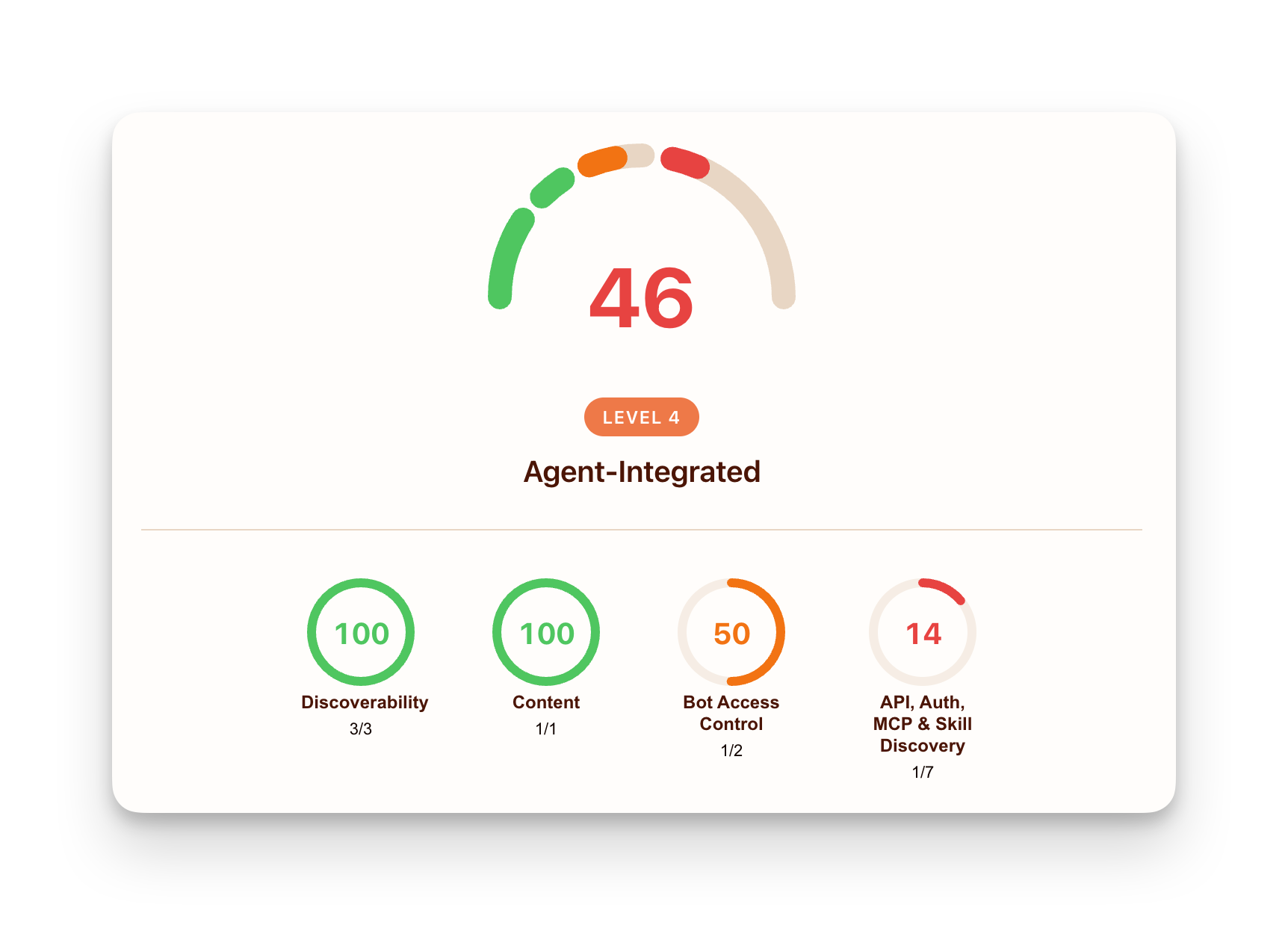

该工具基于可发现性、内容可访问性、Bot 访问控制和协议发现四个维度对网站进行评分,并单独检查 Agentic Commerce 支付协议兼容性。

对于未通过检查的项,该平台会直接生成提示词,供开发者交给编码 Agent 进行自动修复。

同时,Cloudflare 以身作则,通过构建分形结构的 llms.txt、实现 Markdown 内容协商回退、引入 AI 训练爬虫重定向以及隐藏 Agent 指令等方式重构了其开发者文档。

相关链接:

Cloudflare 推出 Agent Memory 托管服务 #2

Cloudflare 推出了名为 Agent Memory 的托管服务私有测试版。

这项服务能够提取并按需提供关键信息,赋予智能体持久化记忆能力。

它不仅能记住重要内容,还能自动遗忘无用信息。

根据 Cloudflare 官方博客公布的信息,该公司正式推出了名为"Agent Memory"的托管服务私有测试版。

该服务旨在解决 AI Agent 在长期运行中面临的“上下文污染”问题。通过从对话中提取关键信息并在需要时提供,从而避免无用地填满上下文窗口。

"Agent Memory"赋予了 Agent 持久化记忆能力,使其能够记住重要信息、遗忘无用内容,并随时间推移不断优化。

这项技术主要通过固定的 API 和基于检索的架构运作,支持单个 Agent 记忆、自定义 Agent 框架以及跨人员与工具的共享记忆。

目前该服务已接入 Cloudflare Workers 并提供 REST API,用户可通过官方渠道申请加入候补名单以获取早期访问权限。

相关链接:

- https://blog.cloudflare.com/introducing-agent-memory/

- https://developers.cloudflare.com/agents/concepts/memory/

xAI 推出 Grok 语音转写与合成两款音频 API #3

xAI宣布推出

Grok语音转文本和文本转语音两款独立音频API,帮助开发者轻松集成高质量的语音功能。官方数据显示,这两项服务不仅具备高精度、低延迟和细粒度情感控制等特性,其词错率和收费标准也均低于多家同业竞品。

xAI 近日正式宣布推出音频 API:Grok Speech to Text (STT) 和 Grok Text to Speech (TTS)。

上述两款 API 基于驱动 Grok Voice、Tesla 车载系统以及 Starlink 客户支持的同一底层技术栈构建,旨在帮助开发者将高质量的语音功能轻松集成到包括语音 Agent、实时转录工具、无障碍辅助方案、播客及交互式音频体验在内的各类应用中。

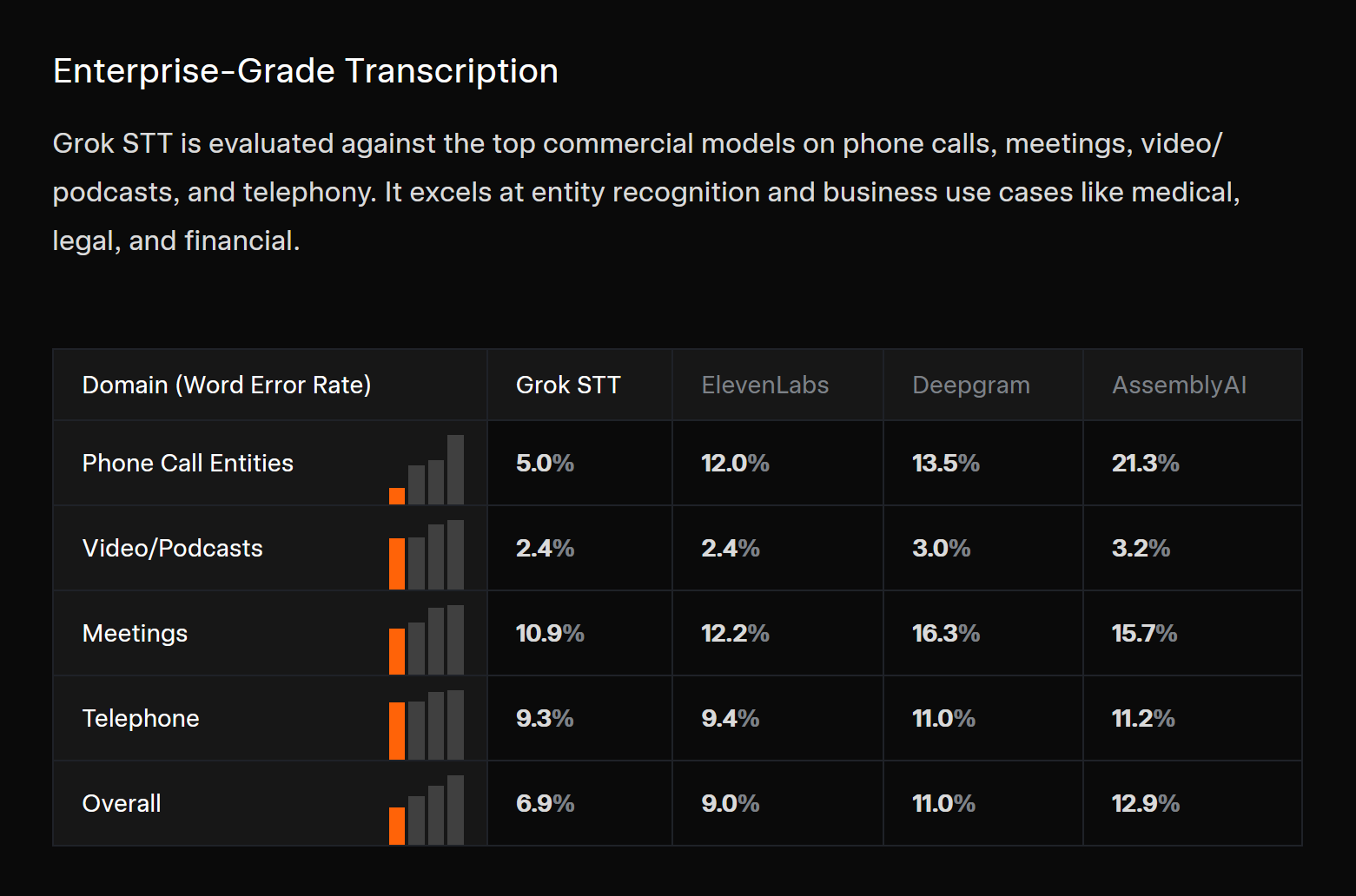

其中,Grok STT API 现已正式上线可用,具备高精度与低延迟特性,支持 25 种以上语言的无缝切换,并提供字级时间戳、说话人分离及多通道支持等高级功能。

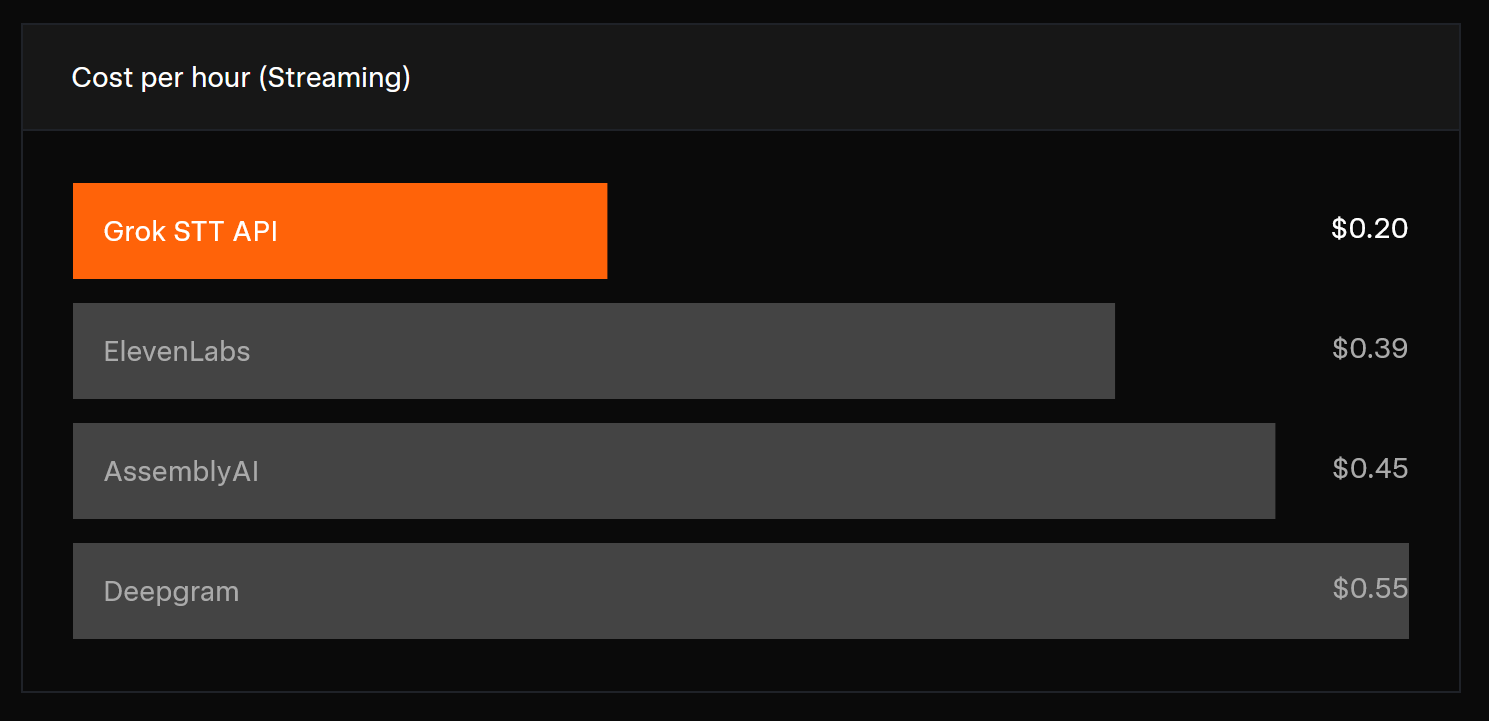

根据官方博客公布的数据,其企业级转录能力在多种场景的词错率表现中优于官方列出的 ElevenLabs、Deepgram 和 AssemblyAI 的相关测试数据。且官方声称该产品在批量与流式转录的每小时定价上均低于上述同业竞品。

与此同时,Grok TTS API 支持通过简单的内联或包裹式语音标签实现对韵律和情感的细粒度控制。

相关链接:

月之暗面联合清华提出 Prefill-as-a-Service 架构 #4

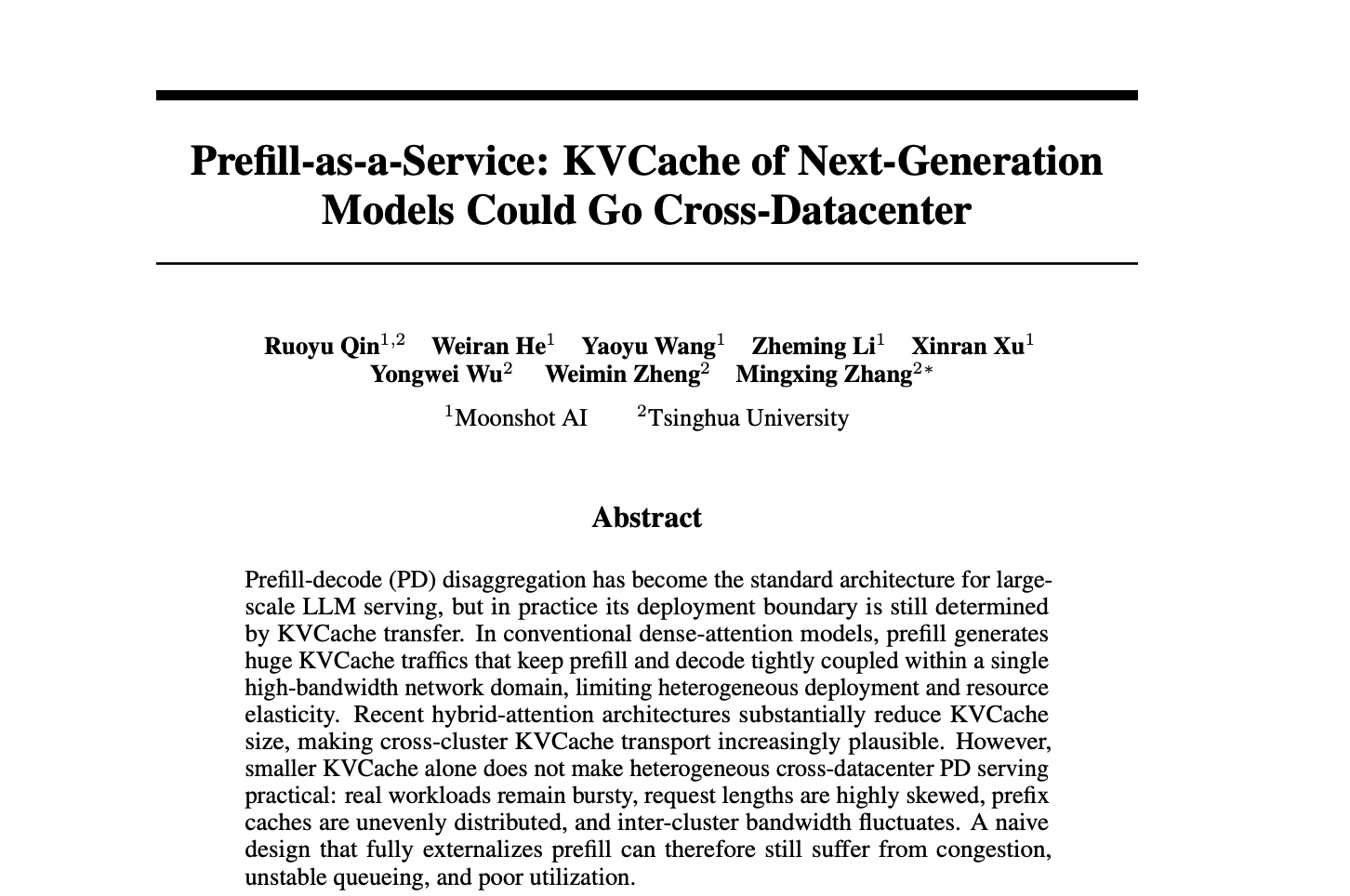

月之暗面与清华大学提出

Prefill-as-a-Service架构。该架构利用 Kimi Linear 等混合注意力模型能大幅减小KVCache的特性,结合选择性路由与带宽和缓存感知调度,打破了异构Prefill/Decode必须同处RDMA网络的限制。它将超过阈值的长

Prefill请求路由至独立的算力密集型集群,再经普通以太网将KVCache传回本地集群进行Decode。该方案相较同构PDbaseline 吞吐更高、TTFT更低。

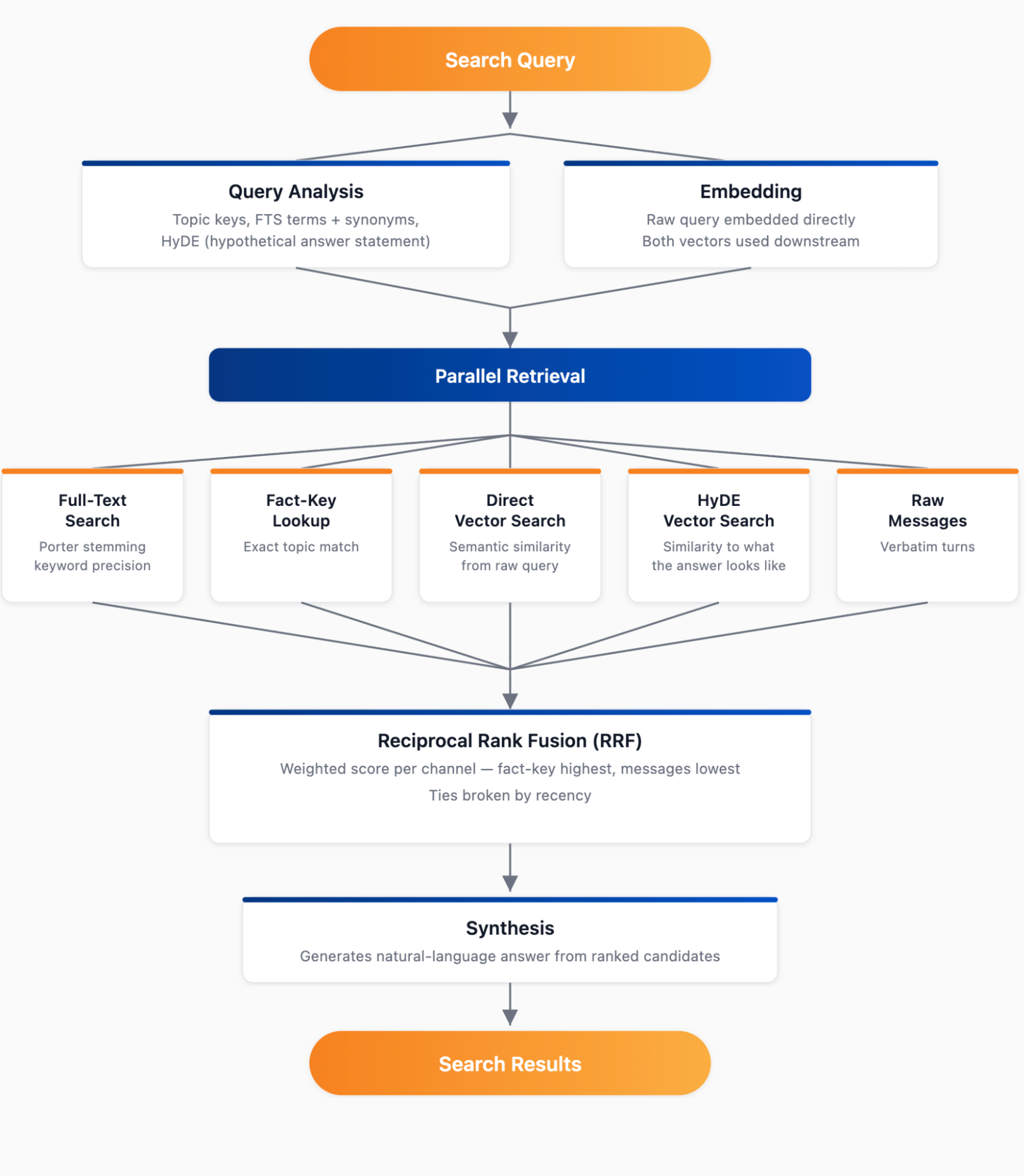

月之暗面与清华大学的发布预印本提出了 Prefill-as-a-Service(PrfaaS),其核心是基于 cross-datacenter KVCache 的异构 Prefill/Decode 解耦 serving 架构。

论文的出发点是,传统 dense-attention 模型在 Prefill 阶段会生成体量很大的 KVCache,跨节点传输成本高,因而现实中的 PD disaggregation 往往仍受限于单个数据中心内的高带宽、低时延 RDMA 网络域。

随着以 Kimi Linear 为代表的混合注意力架构逐步普及,模型在长上下文场景下的 KVCache 规模与 KV throughput 明显下降,跨集群、跨数据中心传输 KVCache 开始进入可行区间。

基于这一前提,PrfaaS 将 模型侧的 KVCache 缩减 与 系统侧的调度和缓存管理 结合起来:对增量未缓存长度超过阈值的长请求,系统会选择性地将 Prefill 路由到独立的、算力密集型 Prefill 集群;对较短请求,则继续保留在本地 PD 路径上执行。

远端 Prefill 完成后,生成的 KVCache 通过 commodity Ethernet 传回本地 PD 集群,由后者继续承担 Decode。

为使这一流程在真实负载下稳定运行,论文进一步引入了 长度阈值路由、带宽感知调度、缓存感知请求放置、全局 KVCache manager、hybrid prefix cache pool,并配合 layer-wise prefill pipelining、multi-connection TCP 与拥塞监控 来平滑跨集群传输流量。

这样一来,异构的 Prefill 与 Decode 资源可以部署在松耦合的不同集群、不同机房甚至不同区域中,部署条件不再要求它们处于同一个 RDMA 高带宽网络域内,同时也便于分别扩展 compute-oriented 的 Prefill 能力与 bandwidth-oriented 的 Decode 能力。

论文中的 case study 使用了一个遵循 Kimi Linear 架构的内部 1T hybrid model,在约 100 Gbps 的跨集群链路、32 张 H200 组成的 PrfaaS 集群和 64 张 H20 组成的本地 PD 集群配置下,得到的最优策略会将约一半的长请求路由到 PrfaaS,平均跨集群带宽占用约 13 Gbps。

相较 homogeneous PD baseline,系统吞吐提升 54%,相较 naive heterogeneous baseline 提升 32%,同时 平均 TTFT 降低 50%,P90 TTFT 降低 64%。

相关链接:

OpenAI 人事动荡,三名核心高管同日宣布离职 #5

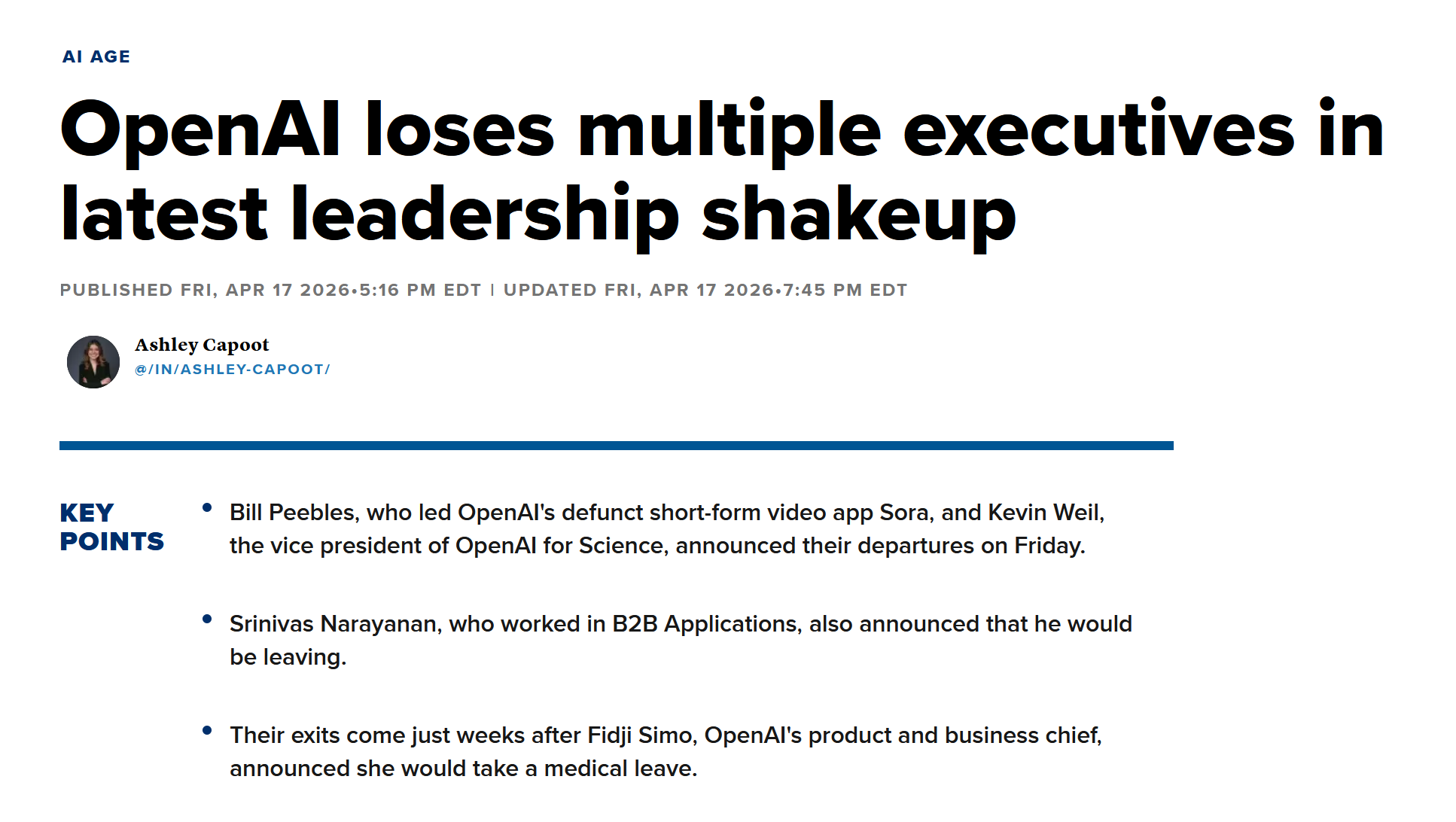

据报道,OpenAI 于当地时间周五发生重大人事震荡。

前首席产品官 Kevin Weil、Sora 负责人 Bill Peebles 以及 B2B Applications 首席技术官 Srinivas Narayanan 三名核心高管同日宣布离职。

据媒体报道,OpenAI 日前发生重大人事震荡,三名核心高管于当地时间周五同日宣布离职。

此次离职的高管包括前首席产品官兼 OpenAI for Science 负责人 Kevin Weil、Sora 负责人 Bill Peebles,以及 B2B Applications 首席技术官 Srinivas Narayanan。

这一系列人事变动发生在该公司整合内部资源、削减边缘项目并将战略重心转向企业级 AI 业务及拟议“超级应用”的大背景下。

根据官方发言人的声明,OpenAI 正在统一其业务和产品战略,其中 Weil 负责的科学项目将被分散并整合至其他研究团队,其旗下的科学家人工智能工作区 Prism 将并入 AI 开发者助手 Codex。

此外,Peebles 离职前负责的 Sora 已于上个月因成本和算力限制被彻底关停。

据知情人士透露,Narayanan 的离职与另外两人无关。

相关链接:

xAI 澄清 Grok 4.3 非 1T,1T 版 Grok 4.4 预计五月初发布 #6

xAI 已经向部分订阅用户开放了 0.5T 参数规模的

Grok 4.3测试版。马斯克澄清,这并非网传的 1T 模型。

他透露,预计 5月 会陆续推出 1T 和 1.5T 版本的升级模型。

未来计划每两周更新一次基础模型。

xAI 日前向 SuperGrok Heavy 订阅用户开放了 Grok 4.3 (beta) 的 Early Access。

尽管有用户推测该版本拥有 1T 参数,但 Elon Musk 随后澄清,当前的 Grok 4.3 仍是 0.5T 模型。

Musk 透露,真正的 1T 旗舰模型距离完成初始训练还需约 5 天。

根据其公布的路线图,基于该 1T 架构的 Grok 4.4 预计于 5 月初发布,而 1.5T 规模的 Grok 4.5 则有望在 5 月底推出。

此外,Musk 表示 SpaceXAI 模型工厂已跑通,未来预计每 两周 下线一版改进后的基础模型。

相关链接:

提示:内容由AI辅助创作,可能存在幻觉和错误。